Note 1: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: I(y+n3Ez0R

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B|A_i] \cdot \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B|A_i] \cdot \Pr[A_i]}}.\]

Satz von der totalen Wahrscheinlichkeit

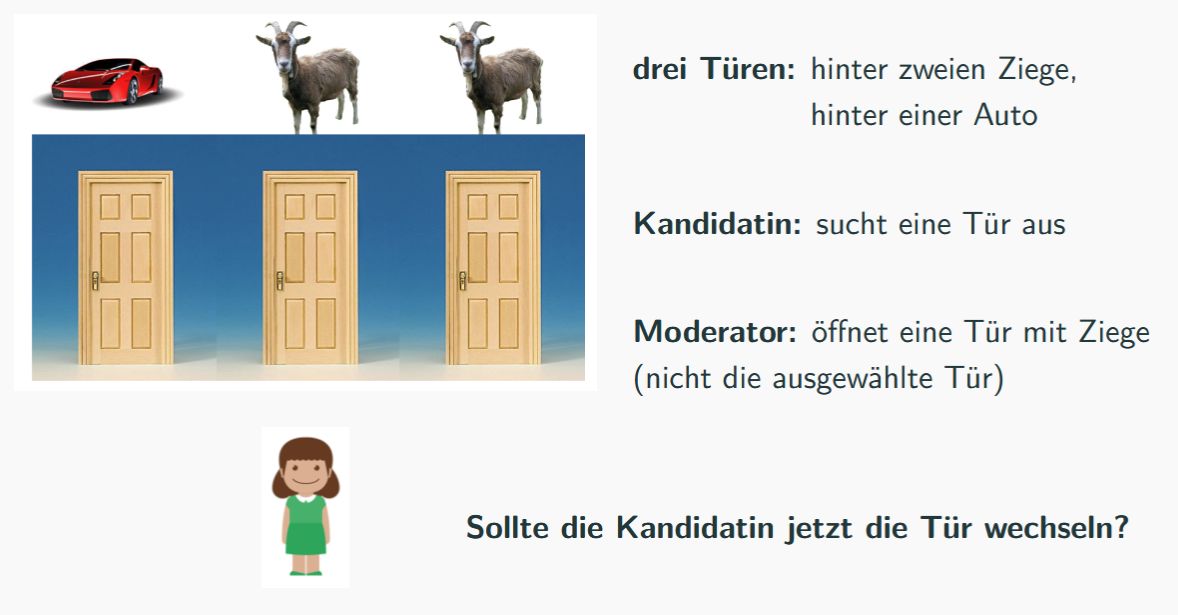

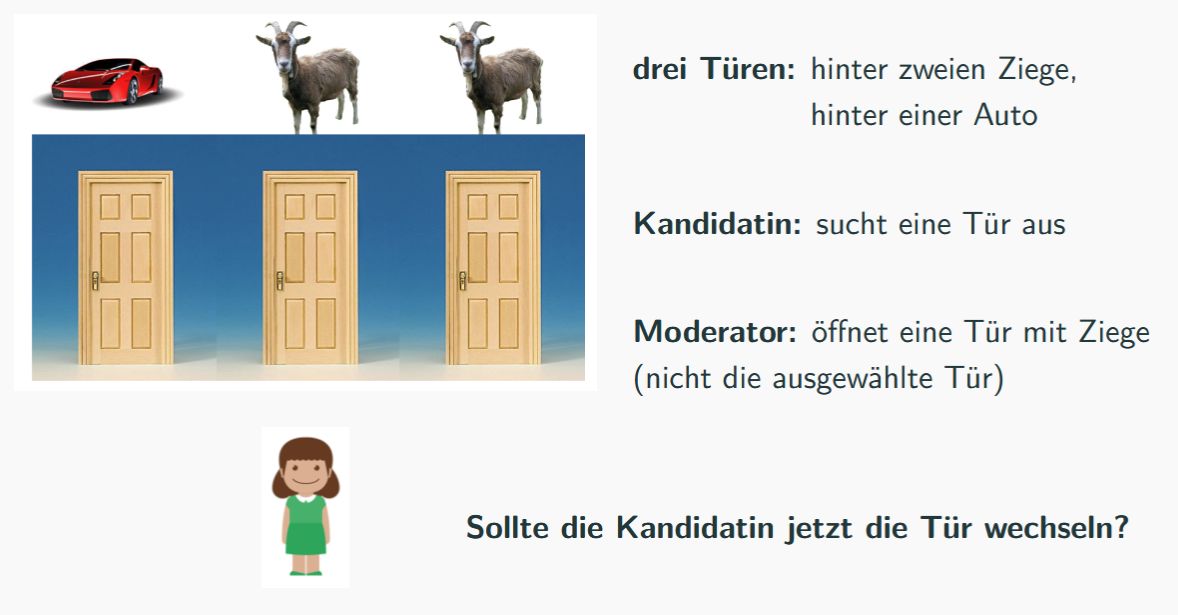

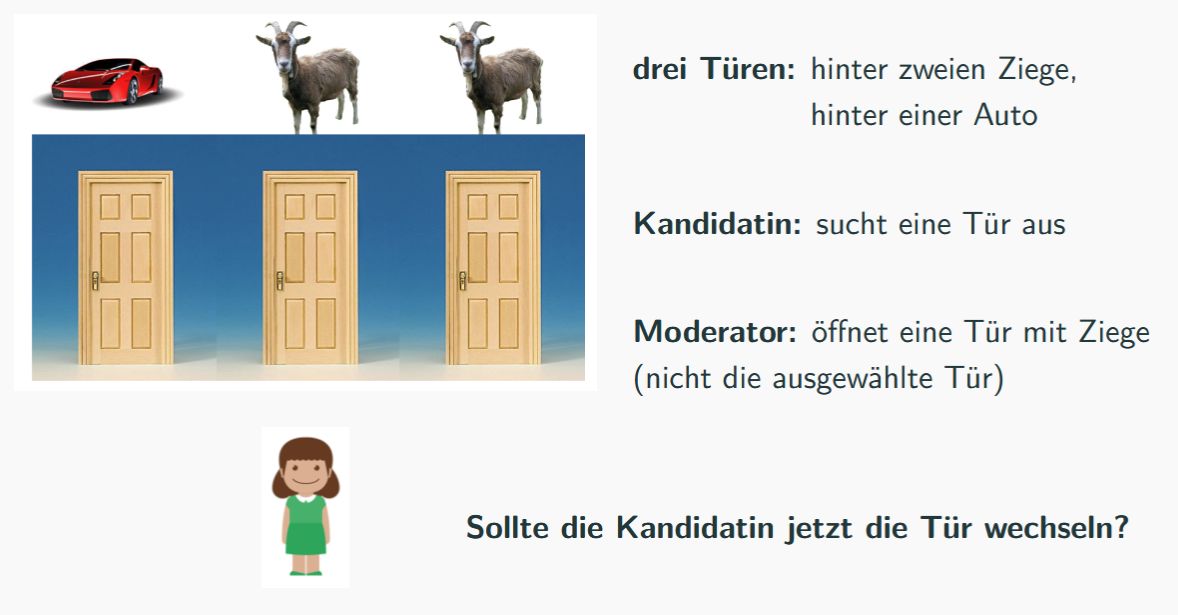

Beispiel: Ziegenproblem

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B\mid A_i] \cdot \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B\mid A_i] \cdot \Pr[A_i]}}.\]

Satz von der totalen Wahrscheinlichkeit

Beispiel: Ziegenproblem

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

<br><br>

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B|A_i] \cdot \Pr[A_i]}}.\] |

Seien \(A_1, \ldots, A_n\) paarweise disjunkte Ereignisse und sei \(B \subseteq A_1 \cup \cdots \cup A_n\).

<br><br>

Dann gilt: \[\Pr[B] = {{c1::\sum_{i=1}^{n} \Pr[B\mid A_i] \cdot \Pr[A_i]}}.\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 2: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_06f8d72e

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

The density function (Dichtefunktion) of a random variable \(X\) is:

\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

The density function (Dichtefunktion) of a random variable \(X\) is:

\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \]

It is zero outside \(W_X\). The density function uniquely determines the random variable's distribution.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Die Dichtefunktion einer Zufallsvariablen \(X\) ist:

\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Die Dichtefunktion einer Zufallsvariablen \(X\) ist:

\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \]

Sie ist null ausserhalb von \(W_X\). Die Dichtefunktion bestimmt die Verteilung der Zufallsvariablen eindeutig.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

The <strong>density function</strong> (Dichtefunktion) of a random variable \(X\) is:<br>\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \] |

Die <strong>Dichtefunktion</strong> einer Zufallsvariablen \(X\) ist:<br>\[ {{c1:: f_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X=x]}}. \] |

| Extra |

It is zero outside \(W_X\). The density function uniquely determines the random variable's distribution. |

Sie ist null ausserhalb von \(W_X\). Die Dichtefunktion bestimmt die Verteilung der Zufallsvariablen eindeutig. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Note 3: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_0aab872f

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Warum muss für Unabhängigkeit die Produktregel für alle Teilmengen gelten, und nicht nur für die paarweisen oder den vollen Schnitt?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Warum muss für Unabhängigkeit die Produktregel für alle Teilmengen gelten, und nicht nur für die paarweisen oder den vollen Schnitt?

Paarweise \(\not \implies\) vollen Schnitt: Zwei faire Münzen, \(A=\)„\(M_1\) Kopf", \(B=\)„\(M_2\) Kopf", \(C=\)„Ergebnisse verschieden": je zwei Ereignisse sind unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\).

Voller Schnitt \(\not \implies\) paarweise: Zufallszahl in \(\{1,\ldots,8\}\), \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\): \(\Pr[A\cap B\cap C]=\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\), aber \(\Pr[A\cap B]=\tfrac{1}{8}\neq\tfrac{1}{4}=\Pr[A]\Pr[B]\).

Beide Bedingungen zusammen sind nötig — daher fordert Unabhängigkeit die Produktregel für alle nichtleeren Teilmengen.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Warum muss für Unabhängigkeit die Produktregel für alle Teilmengen gelten, und nicht nur für die paarweisen oder den vollen Schnitt?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Warum muss für Unabhängigkeit die Produktregel für alle Teilmengen gelten, und nicht nur für die paarweisen oder den vollen Schnitt?

Beide Bedingungen zusammen sind nötig - daher fordert Unabhängigkeit die Produktregel für alle nichtleeren Teilmengen.

Paarweise \(\not \implies\) vollen Schnitt: Zwei faire Münzen, \(A=\)„\(M_1\) Kopf", \(B=\)„\(M_2\) Kopf", \(C=\)„Ergebnisse verschieden": je zwei Ereignisse sind unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\).

Voller Schnitt \(\not \implies\) paarweise: Zufallszahl in \(\{1,\ldots,8\}\), \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\): \(\Pr[A\cap B\cap C]=\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\), aber \(\Pr[A\cap B]=\tfrac{1}{8}\neq\tfrac{1}{4}=\Pr[A]\Pr[B]\).

Field-by-field Comparison

| Field |

Before |

After |

| Back |

<strong>Paarweise \(\not \implies\) vollen Schnitt:</strong> Zwei faire Münzen, \(A=\)„\(M_1\) Kopf", \(B=\)„\(M_2\) Kopf", \(C=\)„Ergebnisse verschieden": je zwei Ereignisse sind unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\).<br><br><strong>Voller Schnitt \(\not \implies\) paarweise:</strong> Zufallszahl in \(\{1,\ldots,8\}\), \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\): \(\Pr[A\cap B\cap C]=\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\), aber \(\Pr[A\cap B]=\tfrac{1}{8}\neq\tfrac{1}{4}=\Pr[A]\Pr[B]\).<br><br>Beide Bedingungen zusammen sind nötig — daher fordert Unabhängigkeit die Produktregel für <strong>alle</strong> nichtleeren Teilmengen. |

Beide Bedingungen <b>zusammen </b>sind nötig - daher fordert Unabhängigkeit die Produktregel für <b>alle</b> nichtleeren Teilmengen.<br><br><b>Paarweise </b>\(\not \implies\)<b> vollen Schnitt:</b> Zwei faire Münzen, \(A=\)„\(M_1\) Kopf", \(B=\)„\(M_2\) Kopf", \(C=\)„Ergebnisse verschieden": je zwei Ereignisse sind unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\).<br><br><b>Voller Schnitt </b>\(\not \implies\)<b> paarweise:</b> Zufallszahl in \(\{1,\ldots,8\}\), \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\): \(\Pr[A\cap B\cap C]=\tfrac{1}{8}=\Pr[A]\Pr[B]\Pr[C]\), aber \(\Pr[A\cap B]=\tfrac{1}{8}\neq\tfrac{1}{4}=\Pr[A]\Pr[B]\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 4: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_1de913c2

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Linearität) For \(X=a_1X_1+\cdots+a_nX_n+b\):

\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Linearität) For \(X=a_1X_1+\cdots+a_nX_n+b\):

\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]

Proof Included

Holds even if \(X_1,\ldots,X_n\) are not independent.

Proof:

Using Lemma 2.29 (\(\mathbb{E}[X]=\sum_\omega X(\omega)\Pr[\omega]\)):

\[ \mathbb{E}[X]=\sum_\omega(a_1X_1(\omega)+\cdots+a_nX_n(\omega)+b)\Pr[\omega] =a_1\underbrace{\sum_\omega X_1(\omega)\Pr[\omega]}_{=\mathbb{E}[X_1]}+\cdots+b\underbrace{\sum_\omega\Pr[\omega]}_{=1}.\quad\square \]

The key is that the outer sum \(\sum_\omega\) distributes over the linear combination.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für \(X=a_1X_1+\cdots+a_nX_n+b\):

\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für \(X=a_1X_1+\cdots+a_nX_n+b\):

\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]Proof Included

(Linearität)

Gilt auch wenn \(X_1,\ldots,X_n\) nicht unabhängig sind.

Proof:

Mit Lemma 2.29 (\(\mathbb{E}[X]=\sum_\omega X(\omega)\Pr[\omega]\)):

\[ \mathbb{E}[X]=\sum_\omega(a_1X_1(\omega)+\cdots+a_nX_n(\omega)+b)\Pr[\omega] =a_1\underbrace{\sum_\omega X_1(\omega)\Pr[\omega]}_{=\mathbb{E}[X_1]}+\cdots+b\underbrace{\sum_\omega\Pr[\omega]}_{=1}.\quad\square \]

Der Schlüssel ist, dass die äussere Summe \(\sum_\omega\) sich über die Linearkombination verteilt.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(<b>Linearität</b>) For \(X=a_1X_1+\cdots+a_nX_n+b\):<br>\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]<br> <em>Proof Included</em> |

Für \(X=a_1X_1+\cdots+a_nX_n+b\):<br>\[ \mathbb{E}[X] = {{c1::a_1\mathbb{E}[X_1]+\cdots+a_n\mathbb{E}[X_n]+b}}\]<em>Proof Included</em> |

| Extra |

Holds even if \(X_1,\ldots,X_n\) are <strong>not independent</strong>.<strong><br><br>Proof:</strong><br>Using Lemma 2.29 (\(\mathbb{E}[X]=\sum_\omega X(\omega)\Pr[\omega]\)):<br>\[ \mathbb{E}[X]=\sum_\omega(a_1X_1(\omega)+\cdots+a_nX_n(\omega)+b)\Pr[\omega] =a_1\underbrace{\sum_\omega X_1(\omega)\Pr[\omega]}_{=\mathbb{E}[X_1]}+\cdots+b\underbrace{\sum_\omega\Pr[\omega]}_{=1}.\quad\square \]<br>The key is that the outer sum \(\sum_\omega\) distributes over the linear combination. |

(Linearität)<br><br>Gilt auch wenn \(X_1,\ldots,X_n\) <b>nicht unabhängig</b> sind.<br><br><b>Proof:</b><br>Mit Lemma 2.29 (\(\mathbb{E}[X]=\sum_\omega X(\omega)\Pr[\omega]\)):<br>\[ \mathbb{E}[X]=\sum_\omega(a_1X_1(\omega)+\cdots+a_nX_n(\omega)+b)\Pr[\omega] =a_1\underbrace{\sum_\omega X_1(\omega)\Pr[\omega]}_{=\mathbb{E}[X_1]}+\cdots+b\underbrace{\sum_\omega\Pr[\omega]}_{=1}.\quad\square \]<br>Der Schlüssel ist, dass die äussere Summe \(\sum_\omega\) sich über die Linearkombination verteilt. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 5: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_1eb62870

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Gesetz der totalen Erwartung, not script) Let \(A_1,\ldots,A_n\) partition \(\Omega\) with all \(\Pr[A_i]>0\). Then:

\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X|A_i]\cdot\Pr[A_i]}}. \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Gesetz der totalen Erwartung, not script) Let \(A_1,\ldots,A_n\) partition \(\Omega\) with all \(\Pr[A_i]>0\). Then:

\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X|A_i]\cdot\Pr[A_i]}}. \]

Proof Included

Proof:

\[\begin{align} \mathbb{E}[X] &=\sum_{x}x\cdot\Pr[X=x] \\ &\overset{\text{total prob}}{=}\sum_x x\sum_i\Pr[X=x|A_i]\Pr[A_i] \\ &=\sum_i\Pr[A_i]\underbrace{\sum_x x\Pr[X=x|A_i]}_{=\mathbb{E}[X|A_i]} \end{align}\]

(Uses the law of total probability to expand \(\Pr[X=x]\), then swaps summation order.)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Sei \(A_1,\ldots,A_n\) eine Partition von \(\Omega\) mit \(\Pr[A_i]>0\) für alle \(i\).

Dann:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X\mid A_i]\cdot\Pr[A_i]}}. \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Sei \(A_1,\ldots,A_n\) eine Partition von \(\Omega\) mit \(\Pr[A_i]>0\) für alle \(i\).

Dann:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X\mid A_i]\cdot\Pr[A_i]}}. \]Proof Included

(Gesetz der totalen Erwartung, nicht im Skript!)

Proof:

\[\begin{align} \mathbb{E}[X] &=\sum_{x}x\cdot\Pr[X=x] \\ &\overset{\text{totale W'keit}}{=}\sum_x x\sum_i\Pr[X=x|A_i]\Pr[A_i] \\ &=\sum_i\Pr[A_i]\underbrace{\sum_x x\Pr[X=x|A_i]}_{=\mathbb{E}[X|A_i]} \end{align}\]

(Verwendet das Gesetz der totalen Wahrscheinlichkeit um \(\Pr[X=x]\) zu expandieren, dann wird die Summationsreihenfolge vertauscht.)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<b>(Gesetz der totalen Erwartung, not script)</b> Let \(A_1,\ldots,A_n\) partition \(\Omega\) with all \(\Pr[A_i]>0\). Then:<br>\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X|A_i]\cdot\Pr[A_i]}}. \]<br><em>Proof Included</em> |

Sei \(A_1,\ldots,A_n\) eine Partition von \(\Omega\) mit \(\Pr[A_i]>0\) für alle \(i\). <br>Dann:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{n}\mathbb{E}[X\mid A_i]\cdot\Pr[A_i]}}. \]<em>Proof Included</em> |

| Extra |

<strong>Proof:</strong><br>\[\begin{align} \mathbb{E}[X] &=\sum_{x}x\cdot\Pr[X=x] \\ &\overset{\text{total prob}}{=}\sum_x x\sum_i\Pr[X=x|A_i]\Pr[A_i] \\ &=\sum_i\Pr[A_i]\underbrace{\sum_x x\Pr[X=x|A_i]}_{=\mathbb{E}[X|A_i]} \end{align}\]<br>(Uses the law of total probability to expand \(\Pr[X=x]\), then swaps summation order.) |

(Gesetz der totalen Erwartung, nicht im Skript!) <br><br><b>Proof:</b><br>\[\begin{align} \mathbb{E}[X] &=\sum_{x}x\cdot\Pr[X=x] \\ &\overset{\text{totale W'keit}}{=}\sum_x x\sum_i\Pr[X=x|A_i]\Pr[A_i] \\ &=\sum_i\Pr[A_i]\underbrace{\sum_x x\Pr[X=x|A_i]}_{=\mathbb{E}[X|A_i]} \end{align}\]<br>(Verwendet das Gesetz der totalen Wahrscheinlichkeit um \(\Pr[X=x]\) zu expandieren, dann wird die Summationsreihenfolge vertauscht.) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 6: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_3121875f

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

(Definition 2.22) Events \(A_1,\ldots,A_n\) are called independent (unabhängig) if {{c1::for all subsets

\(I\subseteq\{1,\ldots,n\}\) with \(I=\{i_1,\ldots,i_k\} \)}}:

\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c1::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

(Definition 2.22) Events \(A_1,\ldots,A_n\) are called independent (unabhängig) if {{c1::for all subsets

\(I\subseteq\{1,\ldots,n\}\) with \(I=\{i_1,\ldots,i_k\} \)}}:

\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c1::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\]

The definition requires the product rule for

every non-empty sub-intersection — not just pairwise intersections, and not just the full \(n\)-fold intersection. Both conditions alone are insufficient:

- Pairwise \(\not \implies\) full intersection: two fair coins, \(A=\)"\(M_1\) heads", \(B=\)"\(M_2\) heads", \(C=\)"results differ" are pairwise independent but \(\Pr[A\cap B\cap C]=0\neq\Pr[A]\Pr[B]\Pr[C]\).

- Full intersection \(\not \implies\) pairwise: \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\) in \(\{1,\ldots,8\}\): \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) but \(A,B\) are not independent.

The total number of conditions to check for \(n\) events is \(2^n-1\) (all non-empty subsets of \(\{1,\ldots,n\}\)).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1,\ldots,A_n\) heissen unabhängig, falls für {{c1::alle Teilmengen \(I\subseteq\{1,\ldots,n\}\) mit \(I=\{i_1,\ldots,i_k\} \)}} gilt:

\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c2::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1,\ldots,A_n\) heissen unabhängig, falls für {{c1::alle Teilmengen \(I\subseteq\{1,\ldots,n\}\) mit \(I=\{i_1,\ldots,i_k\} \)}} gilt:

\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c2::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\]

(Definition 2.22)

Die Definition verlangt die Produktregel für

jede nicht-leere Teil-Durchschnittsmenge - nicht nur paarweise Durchschnitte und nicht nur den vollen \(n\)-fachen Durchschnitt. Beide Bedingungen allein sind unzureichend:

- Paarweise \(\not \implies\) voller Durchschnitt: zwei faire Münzen, \(A=\)"\(M_1\) Kopf", \(B=\)"\(M_2\) Kopf", \(C=\)"Ergebnisse unterscheiden sich" sind paarweise unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\Pr[A]\Pr[B]\Pr[C]\).

- Voller Durchschnitt \(\not \implies\) paarweise: \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\) in \(\{1,\ldots,8\}\): \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\), aber \(A,B\) sind nicht unabhängig.

Die Gesamtzahl der zu prüfenden Bedingungen für \(n\) Ereignisse ist \(2^n-1\) (alle nicht-leeren Teilmengen von \(\{1,\ldots,n\}\)).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(Definition 2.22) Events \(A_1,\ldots,A_n\) are called <strong>independent</strong> (unabhängig) if {{c1::for <strong>all</strong> subsets<br>\(I\subseteq\{1,\ldots,n\}\) with \(I=\{i_1,\ldots,i_k\} \)}}:<br>\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c1::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\] |

Ereignisse \(A_1,\ldots,A_n\) heissen <strong>unabhängig,</strong> falls für {{c1::<strong>alle</strong> Teilmengen \(I\subseteq\{1,\ldots,n\}\) mit \(I=\{i_1,\ldots,i_k\} \)}} gilt:<br>\[ \Pr\!\left[A_{i_1}\cap\cdots\cap A_{i_k}\right] = {{c2::\Pr[A_{i_1}]\cdots\Pr[A_{i_k}]}}\] |

| Extra |

The definition requires the product rule for <strong>every</strong> non-empty sub-intersection — not just pairwise intersections, and not just the full \(n\)-fold intersection. Both conditions alone are insufficient:<br><br><ul><li>Pairwise \(\not \implies\) full intersection: two fair coins, \(A=\)"\(M_1\) heads", \(B=\)"\(M_2\) heads", \(C=\)"results differ" are pairwise independent but \(\Pr[A\cap B\cap C]=0\neq\Pr[A]\Pr[B]\Pr[C]\).</li><li>Full intersection \(\not \implies\) pairwise: \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\) in \(\{1,\ldots,8\}\): \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) but \(A,B\) are not independent.</li></ul><br>The total number of conditions to check for \(n\) events is \(2^n-1\) (all non-empty subsets of \(\{1,\ldots,n\}\)).<br> |

(Definition 2.22) <br><br>Die Definition verlangt die Produktregel für <strong>jede</strong> nicht-leere Teil-Durchschnittsmenge - nicht nur paarweise Durchschnitte und nicht nur den vollen \(n\)-fachen Durchschnitt. Beide Bedingungen allein sind unzureichend:<br><br><ul><li>Paarweise \(\not \implies\) voller Durchschnitt: zwei faire Münzen, \(A=\)"\(M_1\) Kopf", \(B=\)"\(M_2\) Kopf", \(C=\)"Ergebnisse unterscheiden sich" sind paarweise unabhängig, aber \(\Pr[A\cap B\cap C]=0\neq\Pr[A]\Pr[B]\Pr[C]\).</li><li>Voller Durchschnitt \(\not \implies\) paarweise: \(A=\{1,2,3,4\}\), \(B=\{1,5,6,7\}\), \(C=B\) in \(\{1,\ldots,8\}\): \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\), aber \(A,B\) sind nicht unabhängig.</li></ul><br>Die Gesamtzahl der zu prüfenden Bedingungen für \(n\) Ereignisse ist \(2^n-1\) (alle nicht-leeren Teilmengen von \(\{1,\ldots,n\}\)).<br> |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 7: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_32a73428

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

(Satz von Bayes) Let \(A_1,\ldots,A_n\) be pairwise disjoint, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\). Then for any \(i\):

\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

(Satz von Bayes) Let \(A_1,\ldots,A_n\) be pairwise disjoint, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\). Then for any \(i\):

\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]

Proof Included

Proof: By definition \(\Pr[A_i|B]=\Pr[A_i\cap B]/\Pr[B]\). Numerator: \(\Pr[A_i\cap B]=\Pr[B|A_i]\cdot\Pr[A_i]\). Denominator: \(\Pr[B]=\sum_j\Pr[B|A_j]\Pr[A_j]\) (total probability). \(\square\)

Key use: "Invert" the direction of conditioning — from \(\Pr[B|A_i]\) (easy to measure) to \(\Pr[A_i|B]\) (what we want to know).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1,\ldots,A_n\) paarweise disjunkt, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\).

Dann gilt für jedes \(i\):

\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A_1,\ldots,A_n\) paarweise disjunkt, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\).

Dann gilt für jedes \(i\):

\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]

Proof Included

(Satz von Bayes)

Proof:

Nach Definition gilt \(\Pr[A_i|B]=\Pr[A_i\cap B]/\Pr[B]\).

Zähler: \(\Pr[A_i\cap B]=\Pr[B|A_i]\cdot\Pr[A_i]\).

Nenner: \(\Pr[B]=\sum_j\Pr[B|A_j]\Pr[A_j]\) (totale Wahrscheinlichkeit). \(\square\)

Zentrale Anwendung:

Die Konditionierungsrichtung "umkehren" - von \(\Pr[B|A_i]\) (leicht zu messen) zu \(\Pr[A_i|B]\) (was wir wissen wollen).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(Satz von <b>Bayes</b>) Let \(A_1,\ldots,A_n\) be pairwise disjoint, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\). Then for any \(i\):<br>\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]<br><em>Proof Included</em> |

Seien \(A_1,\ldots,A_n\) paarweise disjunkt, \(B\subseteq\bigcup A_i\), \(\Pr[B]>0\). <br>Dann gilt für jedes \(i\):<br>\[ \Pr[A_i|B] = {{c1::\frac{\Pr[B|A_i]\cdot\Pr[A_i]}{\sum_{j=1}^{n}\Pr[B|A_j]\cdot\Pr[A_j]} }}. \]<br><em>Proof Included</em> |

| Extra |

<strong>Proof:</strong> By definition \(\Pr[A_i|B]=\Pr[A_i\cap B]/\Pr[B]\). Numerator: \(\Pr[A_i\cap B]=\Pr[B|A_i]\cdot\Pr[A_i]\). Denominator: \(\Pr[B]=\sum_j\Pr[B|A_j]\Pr[A_j]\) (total probability). \(\square\)<br><br><strong>Key use:</strong> "Invert" the direction of conditioning — from \(\Pr[B|A_i]\) (easy to measure) to \(\Pr[A_i|B]\) (what we want to know). |

(Satz von Bayes)<strong><br><br>Proof:</strong> <br>Nach Definition gilt \(\Pr[A_i|B]=\Pr[A_i\cap B]/\Pr[B]\). <br>Zähler: \(\Pr[A_i\cap B]=\Pr[B|A_i]\cdot\Pr[A_i]\). <br>Nenner: \(\Pr[B]=\sum_j\Pr[B|A_j]\Pr[A_j]\) (totale Wahrscheinlichkeit). \(\square\)<br><br><strong>Zentrale Anwendung:</strong> <br>Die Konditionierungsrichtung "umkehren" - von \(\Pr[B|A_i]\) (leicht zu messen) zu \(\Pr[A_i|B]\) (was wir wissen wollen). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 8: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_35dcd411

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Expected Value as Sum) For any random variable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::weighted sum definition}} \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Expected Value as Sum) For any random variable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::weighted sum definition}} \]

Proof Included

Proof:

\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]

(Switch the order of summation: group by \(\omega\) instead of by value \(x\).)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]Proof Included

(Erwartungswert als Summe)

Proof:

\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]

(Summationsreihenfolge vertauschen: nach \(\omega\) gruppieren statt nach Wert \(x\).)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(<b>Expected Value as Sum</b>) For any random variable \(X\):<br>\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::weighted sum definition}} \]<br><em>Proof Included</em> |

Für jede Zufallsvariable \(X\):<br>\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]<em>Proof Included</em> |

| Extra |

<strong>Proof:</strong><br>\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]<br>(Switch the order of summation: group by \(\omega\) instead of by value \(x\).) |

(Erwartungswert als Summe)<br><br><b>Proof:</b><br>\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]<br>(Summationsreihenfolge vertauschen: nach \(\omega\) gruppieren statt nach Wert \(x\).) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 9: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_38d18cae

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

(Geburtstagsproblem) In a group of \(m\) people (with \(n=365\) days), what is the probability that all birthdays are distinct? Derive the formula. Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

(Geburtstagsproblem) In a group of \(m\) people (with \(n=365\) days), what is the probability that all birthdays are distinct? Derive the formula. Proof Included

Model: throw \(m\) balls into \(n\) bins uniformly. Let \(A_j\) = "ball \(j\) lands in an empty bin."

By the Multiplikationssatz:

\[ \Pr\!\left[\bigcap_{j=1}^m A_j\right] = \prod_{j=2}^{m} \frac{n-(j-1)}{n} = \prod_{j=2}^{m}\!\left(1-\frac{j-1}{n}\right). \]

Upper bound using \(1-x \le e^{-x}\):

\[ \Pr[\text{all distinct}] \le \prod_{j=2}^{m} e^{-(j-1)/n} = e^{-m(m-1)/(2n)}. \]

So the probability of at least one collision is \(\ge 1 - e^{-m(m-1)/(2n)}\). \(\square\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

In einer Gruppe von \(m\) Personen (mit \(n=365\) Tagen), wie gross ist die Wahrscheinlichkeit, dass alle Geburtstage verschieden sind? Leite die Formel her.

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

In einer Gruppe von \(m\) Personen (mit \(n=365\) Tagen), wie gross ist die Wahrscheinlichkeit, dass alle Geburtstage verschieden sind? Leite die Formel her.

Proof Included

(Geburtstagsproblem)

Modell:

Werfe \(m\) Bälle gleichverteilt in \(n\) Urnen.

Sei \(A_j\) = "Ball \(j\) landet in einer leeren Urne."

Mit dem Multiplikationssatz:\[ \Pr\!\left[\bigcap_{j=1}^m A_j\right] = \prod_{j=2}^{m} \frac{n-(j-1)}{n} = \prod_{j=2}^{m}\!\left(1-\frac{j-1}{n}\right). \]Obere Schranke mit \(1-x \le e^{-x}\):\[ \Pr[\text{alle verschieden}] \le \prod_{j=2}^{m} e^{-(j-1)/n} = e^{-m(m-1)/(2n)}. \]Also ist die Wahrscheinlichkeit für mindestens eine Kollision \(\ge 1 - e^{-m(m-1)/(2n)}\). \(\square\)

Field-by-field Comparison

| Field |

Before |

After |

| Front |

(Geburtstagsproblem) In a group of \(m\) people (with \(n=365\) days), what is the probability that <strong>all birthdays are distinct</strong>? Derive the formula. <em>Proof Included</em> |

In einer Gruppe von \(m\) Personen (mit \(n=365\) Tagen), wie gross ist die Wahrscheinlichkeit, dass <strong>alle Geburtstage verschieden</strong> sind? Leite die Formel her.<br><br><em>Proof Included</em> |

| Back |

Model: throw \(m\) balls into \(n\) bins uniformly. Let \(A_j\) = "ball \(j\) lands in an empty bin."<br><br>By the Multiplikationssatz:<br>\[ \Pr\!\left[\bigcap_{j=1}^m A_j\right] = \prod_{j=2}^{m} \frac{n-(j-1)}{n} = \prod_{j=2}^{m}\!\left(1-\frac{j-1}{n}\right). \]<br><br>Upper bound using \(1-x \le e^{-x}\):<br>\[ \Pr[\text{all distinct}] \le \prod_{j=2}^{m} e^{-(j-1)/n} = e^{-m(m-1)/(2n)}. \]<br><br>So the probability of <strong>at least one collision</strong> is \(\ge 1 - e^{-m(m-1)/(2n)}\). \(\square\) |

(Geburtstagsproblem) <br><br><b>Modell:</b> <br>Werfe \(m\) Bälle gleichverteilt in \(n\) Urnen. <br>Sei \(A_j\) = "Ball \(j\) landet in einer leeren Urne."<br><br>Mit dem Multiplikationssatz:\[ \Pr\!\left[\bigcap_{j=1}^m A_j\right] = \prod_{j=2}^{m} \frac{n-(j-1)}{n} = \prod_{j=2}^{m}\!\left(1-\frac{j-1}{n}\right). \]Obere Schranke mit \(1-x \le e^{-x}\):\[ \Pr[\text{alle verschieden}] \le \prod_{j=2}^{m} e^{-(j-1)/n} = e^{-m(m-1)/(2n)}. \]Also ist die Wahrscheinlichkeit für <strong>mindestens eine Kollision</strong> \(\ge 1 - e^{-m(m-1)/(2n)}\). \(\square\) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 10: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_38dbfe49

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Expected Value) For a random variable \(X\) with \(W_X\subseteq\mathbb{N}_0\):

\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: bound form}} \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

(Expected Value) For a random variable \(X\) with \(W_X\subseteq\mathbb{N}_0\):

\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: bound form}} \]

Proof Included

Proof:

\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \]

(The key step is swapping the order of summation: instead of summing over \(i\) and counting 1 for each \(j\le i\), sum over \(j\) and count all \(i\ge j\).)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

(Erwartungswert)

Proof:\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<b>(Expected Value)</b> For a random variable \(X\) with \(W_X\subseteq\mathbb{N}_0\):<br>\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: bound form}} \]<br><em>Proof Included</em> |

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]<em>Proof Included</em> |

| Extra |

<strong>Proof:</strong><br>\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \]<br>(The key step is swapping the order of summation: instead of summing over \(i\) and counting 1 for each \(j\le i\), sum over \(j\) and count all \(i\ge j\).) |

(Erwartungswert)<br><br><b>Proof:</b>\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 11: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_3ed1db5d

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

(Lemma 2.2) Für jedes Ereignis \(A\) gilt:

\[\Pr[\bar{A}] = 1 - \Pr[A].\]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

(Lemma 2.2) Für jedes Ereignis \(A\) gilt:

\[\Pr[\bar{A}] = 1 - \Pr[A].\]

Proof Included

Beweis: \(\Omega = A \cup \bar{A}\) ist eine disjunkte Zerlegung, also \(\Pr[\Omega]=\Pr[A]+\Pr[\bar{A}]\). Mit \(\Pr[\Omega]=1\) folgt \(\Pr[\bar{A}]=1-\Pr[A]\). \(\square\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für jedes Ereignis \(A\) gilt:

\[\Pr[\overline{A}] = 1 - \Pr[A].\]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für jedes Ereignis \(A\) gilt:

\[\Pr[\overline{A}] = 1 - \Pr[A].\]Proof Included

(Lemma 2.2)

Beweis:

\(\Omega = A \cup \bar{A}\) ist eine disjunkte Zerlegung, also \(\Pr[\Omega]=\Pr[A]+\Pr[\bar{A}]\).

Mit \(\Pr[\Omega]=1\) folgt \(\Pr[\bar{A}]=1-\Pr[A]\). \(\square\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(Lemma 2.2) Für jedes Ereignis \(A\) gilt:<br>\[\Pr[\bar{A}] = {{c1::1 - \Pr[A]}}.\]<br><em>Proof Included</em> |

Für jedes Ereignis \(A\) gilt:<br>\[\Pr[\overline{A}] = {{c1::1 - \Pr[A]}}.\]<em>Proof Included</em> |

| Extra |

<strong>Beweis:</strong> \(\Omega = A \cup \bar{A}\) ist eine disjunkte Zerlegung, also \(\Pr[\Omega]=\Pr[A]+\Pr[\bar{A}]\). Mit \(\Pr[\Omega]=1\) folgt \(\Pr[\bar{A}]=1-\Pr[A]\). \(\square\) |

(Lemma 2.2)<strong><br><br>Beweis:</strong> <br>\(\Omega = A \cup \bar{A}\) ist eine disjunkte Zerlegung, also \(\Pr[\Omega]=\Pr[A]+\Pr[\bar{A}]\). <br>Mit \(\Pr[\Omega]=1\) folgt \(\Pr[\bar{A}]=1-\Pr[A]\). \(\square\) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Note 12: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_3fceba79

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Give an example where \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) holds but the three events are not mutually independent.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Give an example where \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) holds but the three events are not mutually independent.

Choose a random number in \(\{1,\ldots,8\}\). Let:

\(A = \{1,2,3,4\}\), so \(\Pr[A]=1/2\)

\(B = \{1,5,6,7\}\), so \(\Pr[B]=1/2\)

\(C = B\) (same event)

Then \(\Pr[A\cap B\cap C]=\Pr[A\cap B]=1/8=\Pr[A]\Pr[B]\Pr[C]\) ✓

But \(\Pr[A\cap B]=1/8 \neq 1/4 = \Pr[A]\Pr[B]\) ✗ — so \(A\) and \(B\) are not independent.

Lesson: The product condition for the full intersection is not sufficient; all sub-intersections must satisfy the product rule.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Gib ein Beispiel, bei dem \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) gilt, die drei Ereignisse aber nicht (gegenseitig) unabhängig sind.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Gib ein Beispiel, bei dem \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) gilt, die drei Ereignisse aber nicht (gegenseitig) unabhängig sind.

Wähle eine Zahl gleichverteilt aus \(\{1,\ldots,8\}\). Sei:

\(A = \{1,2,3,4\}\), also \(\Pr[A]=1/2\)

\(B = \{1,5,6,7\}\), also \(\Pr[B]=1/2\)

\(C = B\) (gleiches Ereignis)

Dann gilt \(\Pr[A\cap B\cap C]=\Pr[A\cap B]=1/8=\Pr[A]\Pr[B]\Pr[C]\) ✓

Aber \(\Pr[A\cap B]=1/8 \neq 1/4 = \Pr[A]\Pr[B]\) ✗ - also sind \(A\) und \(B\) nicht unabhängig.

Lektion:

Die Produktbedingung für den vollen Durchschnitt allein reicht nicht aus; alle Teil-Durchschnitte müssen die Produktregel erfüllen.

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Give an example where \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) holds but the three events are <strong>not</strong> mutually independent. |

Gib ein Beispiel, bei dem \(\Pr[A\cap B\cap C]=\Pr[A]\Pr[B]\Pr[C]\) gilt, die drei Ereignisse aber <strong>nicht</strong> (gegenseitig) unabhängig sind. |

| Back |

Choose a random number in \(\{1,\ldots,8\}\). Let:<br>\(A = \{1,2,3,4\}\), so \(\Pr[A]=1/2\)<br>\(B = \{1,5,6,7\}\), so \(\Pr[B]=1/2\)<br>\(C = B\) (same event)<br><br>Then \(\Pr[A\cap B\cap C]=\Pr[A\cap B]=1/8=\Pr[A]\Pr[B]\Pr[C]\) ✓<br><br>But \(\Pr[A\cap B]=1/8 \neq 1/4 = \Pr[A]\Pr[B]\) ✗ — so \(A\) and \(B\) are not independent.<br><br><strong>Lesson:</strong> The product condition for the full intersection is not sufficient; <em>all</em> sub-intersections must satisfy the product rule. |

Wähle eine Zahl gleichverteilt aus \(\{1,\ldots,8\}\). Sei:<br>\(A = \{1,2,3,4\}\), also \(\Pr[A]=1/2\)<br>\(B = \{1,5,6,7\}\), also \(\Pr[B]=1/2\)<br>\(C = B\) (gleiches Ereignis)<br><br>Dann gilt \(\Pr[A\cap B\cap C]=\Pr[A\cap B]=1/8=\Pr[A]\Pr[B]\Pr[C]\) ✓<br><br>Aber \(\Pr[A\cap B]=1/8 \neq 1/4 = \Pr[A]\Pr[B]\) ✗ - also sind \(A\) und \(B\) nicht unabhängig.<br><br><strong>Lektion:</strong> <br>Die Produktbedingung für den vollen Durchschnitt allein reicht nicht aus; <em>alle</em> Teil-Durchschnitte müssen die Produktregel erfüllen. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 13: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_4064b971

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Independence Events \(A_1,\ldots,A_n\) are mutually independent iff for all \((s_1,\ldots,s_n)\in\{0,1\}^n\):

\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]

where \(A_i^1 = A_i\) and \(A_i^0 = \bar{A}_i\). Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Independence Events \(A_1,\ldots,A_n\) are mutually independent iff for all \((s_1,\ldots,s_n)\in\{0,1\}^n\):

\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]

where \(A_i^1 = A_i\) and \(A_i^0 = \bar{A}_i\). Proof Included

Proof sketch (⇒): Induction on the number of zeros in \((s_1,\ldots,s_n)\).

Base case (\(s_i=1\) for all \(i\)): direct from definition.

Inductive step (say \(s_1=0\)):

\(\Pr[\bar{A}_1\cap A_2^{s_2}\cap\cdots] = \Pr[A_2^{s_2}\cap\cdots]-\Pr[A_1\cap A_2^{s_2}\cap\cdots]\)

\(= \Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]-\Pr[A_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\)

\(= (1-\Pr[A_1])\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}] = \Pr[\bar{A}_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\). \(\square\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

\(A_1,\ldots,A_n\) sind gegenseitig unabhängig gdw. für alle \((s_1,\ldots,s_n)\in\{0,1\}^n\):\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]wobei \(A_i^1 = A_i\) und \(A_i^0 = \bar{A}_i\).

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

\(A_1,\ldots,A_n\) sind gegenseitig unabhängig gdw. für alle \((s_1,\ldots,s_n)\in\{0,1\}^n\):\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]wobei \(A_i^1 = A_i\) und \(A_i^0 = \bar{A}_i\).

Proof Included

Beweisskizze (⇒):

Induktion über die Anzahl Nullen in \((s_1,\ldots,s_n)\).

Basisfall (\(s_i=1\) für alle \(i\)): direkt aus der Definition.

Induktionsschritt (z.B. \(s_1=0\)):

\(\Pr[\bar{A}_1\cap A_2^{s_2}\cap\cdots] = \Pr[A_2^{s_2}\cap\cdots]-\Pr[A_1\cap A_2^{s_2}\cap\cdots]\)

\(= \Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]-\Pr[A_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\)

\(= (1-\Pr[A_1])\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}] = \Pr[\bar{A}_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\). \(\square\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<b>Independence</b> Events \(A_1,\ldots,A_n\) are <b>mutually</b> independent iff for <b>all</b> \((s_1,\ldots,s_n)\in\{0,1\}^n\):<br>\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]<br>where \(A_i^1 = A_i\) and \(A_i^0 = \bar{A}_i\). <em>Proof Included</em> |

\(A_1,\ldots,A_n\) sind <b>gegenseitig</b> unabhängig gdw. für <b>alle</b> \((s_1,\ldots,s_n)\in\{0,1\}^n\):\[ {{c1:: \Pr\!\left[A_1^{s_1}\cap\cdots\cap A_n^{s_n}\right] = \Pr[A_1^{s_1}]\cdots\Pr[A_n^{s_n}]}} \]wobei \(A_i^1 = A_i\) und \(A_i^0 = \bar{A}_i\). <br><em><br>Proof Included</em> |

| Extra |

<strong>Proof sketch (⇒):</strong> Induction on the number of zeros in \((s_1,\ldots,s_n)\).<br>Base case (\(s_i=1\) for all \(i\)): direct from definition.<br>Inductive step (say \(s_1=0\)):<br>\(\Pr[\bar{A}_1\cap A_2^{s_2}\cap\cdots] = \Pr[A_2^{s_2}\cap\cdots]-\Pr[A_1\cap A_2^{s_2}\cap\cdots]\)<br>\(= \Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]-\Pr[A_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\)<br>\(= (1-\Pr[A_1])\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}] = \Pr[\bar{A}_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\). \(\square\) |

<strong>Beweisskizze (⇒):</strong> <br>Induktion über die Anzahl Nullen in \((s_1,\ldots,s_n)\).<br>Basisfall (\(s_i=1\) für alle \(i\)): direkt aus der Definition.<br>Induktionsschritt (z.B. \(s_1=0\)):<br>\(\Pr[\bar{A}_1\cap A_2^{s_2}\cap\cdots] = \Pr[A_2^{s_2}\cap\cdots]-\Pr[A_1\cap A_2^{s_2}\cap\cdots]\)<br>\(= \Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]-\Pr[A_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\)<br>\(= (1-\Pr[A_1])\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}] = \Pr[\bar{A}_1]\Pr[A_2^{s_2}]\cdots\Pr[A_n^{s_n}]\). \(\square\) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 14: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_4701cdf5

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Give an intuitive description of what conditioning on event \(B\) (events \(\Pr[\cdot | B]\)) does to the probability space.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Give an intuitive description of what conditioning on event \(B\) (events \(\Pr[\cdot | B]\)) does to the probability space.

Conditioning on \(B\):

Zeros out all elementary events \(\omega\notin B\) (they are ruled out).

Rescales the remaining probabilities by \(1/\Pr[B]\) so they sum to 1.

Think of it as "zooming in" on the sub-universe \(B\): inside \(B\), relative probabilities remain unchanged; everything outside \(B\) is discarded.

Consequence: All probability rules hold within the conditional space (complement, disjoint union, Bayes, etc.).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Gib eine intuitive Beschreibung, was das Konditionieren auf ein Ereignis \(B\) (d.h. \(\Pr[\cdot | B]\)) mit dem Wahrscheinlichkeitsraum macht.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Gib eine intuitive Beschreibung, was das Konditionieren auf ein Ereignis \(B\) (d.h. \(\Pr[\cdot | B]\)) mit dem Wahrscheinlichkeitsraum macht.

Man "zoomt" in den Wahrscheinlichkeitsraum hinein und beschränkt sich auf die Ergebnisse in \(B\).

Alle Ergebnisse ausserhalb von \(B\) erhalten Wahrscheinlichkeit 0, und die verbleibenden Wahrscheinlichkeiten werden mit \(1/\Pr[B]\) reskaliert, damit sie sich wieder zu 1 summieren.

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Give an intuitive description of what conditioning on event \(B\) (events \(\Pr[\cdot | B]\)) does to the probability space. |

Gib eine intuitive Beschreibung, was das Konditionieren auf ein Ereignis \(B\) (d.h. \(\Pr[\cdot | B]\)) mit dem Wahrscheinlichkeitsraum macht. |

| Back |

Conditioning on \(B\):<br><strong>Zeros out</strong> all elementary events \(\omega\notin B\) (they are ruled out).<br><strong>Rescales</strong> the remaining probabilities by \(1/\Pr[B]\) so they sum to 1.<br><br>Think of it as "zooming in" on the sub-universe \(B\): inside \(B\), relative probabilities remain unchanged; everything outside \(B\) is discarded.<br><br><strong>Consequence:</strong> All probability rules hold within the conditional space (complement, disjoint union, Bayes, etc.). |

Man "zoomt" in den Wahrscheinlichkeitsraum hinein und beschränkt sich auf die Ergebnisse in \(B\). <br><br>Alle Ergebnisse ausserhalb von \(B\) erhalten Wahrscheinlichkeit 0, und die verbleibenden Wahrscheinlichkeiten werden mit \(1/\Pr[B]\) reskaliert, damit sie sich wieder zu 1 summieren. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 15: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_55f36256

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

The distribution function (Verteilungsfunktion) of \(X\) is:

\[ {{c1:: F_X : \mathbb{R}\to[0,1], x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

The distribution function (Verteilungsfunktion) of \(X\) is:

\[ {{c1:: F_X : \mathbb{R}\to[0,1], x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\]

It is non-decreasing, right-continuous, with \(F_X\to 0\) as \(x\to-\infty\) and \(F_X\to 1\) as \(x\to+\infty\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Die Verteilungsfunktion von \(X\) ist:

\[ {{c1:: F_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Die Verteilungsfunktion von \(X\) ist:

\[ {{c1:: F_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\]

Sie ist monoton wachsend, rechtsstetig, mit \(F_X\to 0\) für \(x\to-\infty\) und \(F_X\to 1\) für \(x\to+\infty\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

The <strong>distribution function</strong> (Verteilungsfunktion) of \(X\) is:<br>\[ {{c1:: F_X : \mathbb{R}\to[0,1], x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\] |

Die <strong>Verteilungsfunktion</strong> von \(X\) ist:<br>\[ {{c1:: F_X : \mathbb{R}\to[0,1], \quad x\mapsto \Pr[X\le x]}} = {{c2::\sum_{\substack{x'\in W_X\\x'\le x} } \Pr[X=x'] }}\] |

| Extra |

It is non-decreasing, right-continuous, with \(F_X\to 0\) as \(x\to-\infty\) and \(F_X\to 1\) as \(x\to+\infty\). |

Sie ist monoton wachsend, rechtsstetig, mit \(F_X\to 0\) für \(x\to-\infty\) und \(F_X\to 1\) für \(x\to+\infty\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Note 16: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: +!U{GV-1:X

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Eine Reihe \(\sum_{k=1}^\infty a_k\) ist definiert als die Folge der Partialsummen \(S_n\), wobei: \[S_n = {{c2::\sum_{k=1}^n a_k = a_1 + a_2 + \cdots + a_n}}\]

Back

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Eine Reihe \(\sum_{k=1}^\infty a_k\) ist definiert als die Folge der Partialsummen \(S_n\), wobei: \[S_n = {{c2::\sum_{k=1}^n a_k = a_1 + a_2 + \cdots + a_n}}\]

Eine Reihe ist ein Symbol für \(\lim_{n\to\infty} S_n\) — keine gewöhnliche Summe.

After

Front

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Eine Reihe \(\sum_{k=1}^\infty a_k\) ist definiert als die Folge der Partialsummen \(S_n\), wobei: \[S_n = {{c2::\sum_{k=1}^n a_k = a_1 + a_2 + \cdots + a_n}}\]

Back

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Eine Reihe \(\sum_{k=1}^\infty a_k\) ist definiert als die Folge der Partialsummen \(S_n\), wobei: \[S_n = {{c2::\sum_{k=1}^n a_k = a_1 + a_2 + \cdots + a_n}}\]

Eine Reihe ist ein Symbol für \(\lim_{n\to\infty} S_n\) - keine gewöhnliche Summe.

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

Eine Reihe ist ein <b>Symbol</b> für \(\lim_{n\to\infty} S_n\) — keine gewöhnliche Summe. |

Eine Reihe ist ein <b>Symbol</b> für \(\lim_{n\to\infty} S_n\) - keine gewöhnliche Summe. |

Tags:

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Note 17: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: +w)j=/t,NA

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::2._Standard_Reihen::1._Potenzreihe

Was gilt auf dem Rand des Konvergenzkreises \(|x - a| = R\) einer Potenzreihe?

Back

ETH::2._Semester::Analysis::3._Reihen::2._Standard_Reihen::1._Potenzreihe

Was gilt auf dem Rand des Konvergenzkreises \(|x - a| = R\) einer Potenzreihe?

Keine allgemeine Aussage — kommt auf den Einzelfall an:

- \(\sum \frac{x^n}{n}\): divergiert für \(x = 1\), konvergiert für \(x = -1\) (Leibniz)

- \(\sum \frac{x^n}{n^2}\): konvergiert für alle \(|x| = 1\) (absolut)

- \(\sum x^n\): divergiert für alle \(|x| = 1\)

After

Front

ETH::2._Semester::Analysis::3._Reihen::2._Standard_Reihen::1._Potenzreihe

Was gilt auf dem Rand des Konvergenzkreises \(|x - a| = R\) einer Potenzreihe?

Back

ETH::2._Semester::Analysis::3._Reihen::2._Standard_Reihen::1._Potenzreihe

Was gilt auf dem Rand des Konvergenzkreises \(|x - a| = R\) einer Potenzreihe?

Keine allgemeine Aussage - kommt auf den Einzelfall an:

- \(\sum \frac{x^n}{n}\): divergiert für \(x = 1\), konvergiert für \(x = -1\) (Leibniz)

- \(\sum \frac{x^n}{n^2}\): konvergiert für alle \(|x| = 1\) (absolut)

- \(\sum x^n\): divergiert für alle \(|x| = 1\)

Field-by-field Comparison

| Field |

Before |

After |

| Back |

Keine allgemeine Aussage — kommt auf den Einzelfall an:<br><ul><li>\(\sum \frac{x^n}{n}\): divergiert für \(x = 1\), konvergiert für \(x = -1\) (Leibniz)</li><li>\(\sum \frac{x^n}{n^2}\): konvergiert für alle \(|x| = 1\) (absolut)</li><li>\(\sum x^n\): divergiert für alle \(|x| = 1\)</li></ul> |

Keine allgemeine Aussage - kommt auf den Einzelfall an:<br><ul><li>\(\sum \frac{x^n}{n}\): divergiert für \(x = 1\), konvergiert für \(x = -1\) (Leibniz)</li><li>\(\sum \frac{x^n}{n^2}\): konvergiert für alle \(|x| = 1\) (absolut)</li><li>\(\sum x^n\): divergiert für alle \(|x| = 1\)</li></ul> |

Tags:

ETH::2._Semester::Analysis::3._Reihen::2._Standard_Reihen::1._Potenzreihe

Note 18: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: ,$5trcvO/g

modified

Before

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

(\(0\) und \(\infty\) sind hier Kurzschreibweisen für das Verhalten im Grenzwert: \(0\) steht für „geht gegen \(0\)" und \(\infty\) für „geht gegen \(\infty\)".)

After

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Strategie |

| \(\dfrac{0}{0}\) |

L'Hôpital, kürzen, Taylor |

| \(\dfrac{\infty}{\infty}\) |

L'Hôpital, führende Terme, Taylor |

| \(0 \cdot \infty\) |

{{c3::Als Bruch schreiben → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(\infty - \infty\) |

{{c4::Gemeinsamer Nenner, Konjugat oder Ausklammern → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0,\; \infty^0,\; 1^\infty\) |

{{c5::\(f^g = e^{g \ln f}\) → wird zu \(0 \cdot \infty\)}} |

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Strategie |

| \(\dfrac{0}{0}\) |

L'Hôpital, kürzen, Taylor |

| \(\dfrac{\infty}{\infty}\) |

L'Hôpital, führende Terme, Taylor |

| \(0 \cdot \infty\) |

{{c3::Als Bruch schreiben → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(\infty - \infty\) |

{{c4::Gemeinsamer Nenner, Konjugat oder Ausklammern → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0,\; \infty^0,\; 1^\infty\) |

{{c5::\(f^g = e^{g \ln f}\) → wird zu \(0 \cdot \infty\)}} |

(\(0\) und \(\infty\) sind hier Kurzschreibweisen für das Verhalten im Grenzwert: \(0\) steht für „geht gegen \(0\)" und \(\infty\) für „geht gegen \(\infty\)".)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<table style="border-collapse:collapse;width:100%;font-size:0.95em;">

<thead>

<tr>

<th style="padding:8px 12px;border:1px solid #555;">Form</th>

<th style="padding:8px 12px;border:1px solid #555;">Umformung</th>

<th style="padding:8px 12px;border:1px solid #555;">Methode</th>

</tr>

</thead>

<tbody>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c1::\(\dfrac{0}{0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1:: —}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1::L'Hôpital, kürzen, Taylor}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c2::\(\dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::—}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::L'Hôpital, führende Terme}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c3::\(0 \cdot \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::Umschreiben → L'Hôpital}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c4::\(\infty - \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::gemeinsamer Nenner, Konjugat, ausklammern}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c5::\(0^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c6::\(\infty^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c7::\(1^\infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

</tbody>

</table> |

<table style="border-collapse:collapse;width:100%;font-size:0.95em;">

<thead>

<tr>

<th style="padding:8px 12px;border:1px solid #555;">Form</th>

<th style="padding:8px 12px;border:1px solid #555;">Strategie</th>

</tr>

</thead>

<tbody><tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">\(\dfrac{0}{0}\)</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1::L'Hôpital, kürzen, Taylor}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">\(\dfrac{\infty}{\infty}\)</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::L'Hôpital, führende Terme, Taylor}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">\(0 \cdot \infty\)</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::Als Bruch schreiben → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">\(\infty - \infty\)</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::Gemeinsamer Nenner, Konjugat oder Ausklammern → \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">\(0^0,\; \infty^0,\; 1^\infty\)</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::\(f^g = e^{g \ln f}\) → wird zu \(0 \cdot \infty\)}}</td>

</tr>

</tbody>

</table> |

Tags:

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Note 19: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: 2cxt#6?hKc

modified

Before

Front

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::1._Ordnung

Cauchy-Schwarz Ungleichung (Euklidischer Raum)

Back

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::1._Ordnung

Cauchy-Schwarz Ungleichung (Euklidischer Raum)

Für alle \(x, y \in \mathbb{R}^n\) gilt:\[|x \cdot y| \leq \|x\| \cdot \|y\|\]

After

Front

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::1._Ordnung

Wie lautet die Cauchy-Schwarz Ungleichung im euklidischen Raum?

Back

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::1._Ordnung

Wie lautet die Cauchy-Schwarz Ungleichung im euklidischen Raum?

Für alle \(x, y \in \mathbb{R}^n\) gilt:\[|x \cdot y| \leq \|x\| \cdot \|y\|\]

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Cauchy-Schwarz Ungleichung (Euklidischer Raum) |

Wie lautet die Cauchy-Schwarz Ungleichung im euklidischen Raum? |

Tags:

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::1._Ordnung

Note 20: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: 9r2wQ@.hKx

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Das Wurzelkriterium ist stärker: Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

In der Praxis ist das Quotientenkriterium oft bequemer, besonders bei \(n!\) oder Potenzen.

Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen.

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Welches Konvergenzkriterium ist stärker: das Wurzel- oder das Quotientenkriterium?

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Welches Konvergenzkriterium ist stärker: das Wurzel- oder das Quotientenkriterium?

Das Wurzelkriterium. Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

In der Praxis ist das Quotientenkriterium oft bequemer, besonders bei \(n!\) oder Potenzen.

Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen.

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Unterschied Wurzel- vs. Quotientenkriterium? |

Welches Konvergenzkriterium ist stärker: das Wurzel- oder das Quotientenkriterium? |

| Back |

Das <b>Wurzelkriterium ist stärker</b>: Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

<br><br>In der Praxis ist das <b>Quotientenkriterium</b> oft bequemer, besonders bei \(n!\) oder Potenzen.

<br><br>Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen. |

Das <b>Wurzelkriterium.</b> Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

<br><br>In der Praxis ist das <b>Quotientenkriterium</b> oft bequemer, besonders bei \(n!\) oder Potenzen.

<br><br>Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen. |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 21: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: ==Fn-80|4a

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Wurzelkriterium: Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\). Dann:

- \(\rho < 1\) \(\implies\) \(\sum a_n\) konvergiert absolut

- \(\rho > 1\) \(\implies\) \(\sum a_n\) divergiert

- \(\rho = 1\) \(\implies\) keine Aussage möglich

Proof Included

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Wurzelkriterium: Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\). Dann:

- \(\rho < 1\) \(\implies\) \(\sum a_n\) konvergiert absolut

- \(\rho > 1\) \(\implies\) \(\sum a_n\) divergiert

- \(\rho = 1\) \(\implies\) keine Aussage möglich

Proof Included

Wenn Quotientenkriterium versagt (\(\rho=1\)), versagt auch das Wurzelkriterium — aber

nicht umgekehrt.

Proof:

- Convergence \(L < 1\)

-

- \(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right| < 1\).

- Choose \(q\) with \(L < q < 1\). Since \(\limsup \left| {a_n}^{1/n} \right| = L\), there exists \(N\) such that for all \(n \geq N: \left| {a_n}^{1/n} \right| \leq\) \(q \implies \left| a_n \right| \leq q^n\)

- So \(\sum_{n=N}^{\infty} \left| a_n \right| \leq\) \(\sum_{n=N}^{\infty} q^n < \infty\) (geometric series, \(q < 1\)).

- Hence \(\sum \left| a_n \right|\) converges. (Majorantenkriterium)

-

Divergence \(L > 1\)

- \(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right|\) \(> 1\).

- Since \(\limsup \left| {a_n}^{1/n} \right| > 1\), there exist infinitely many \(n\) such that: \(\left| {a_n}^{1/n} \right| >\) \(1 \implies |a_n| > 1\)

- So \(|a_n| \not\to 0\), hence \(\sum a_n\) diverges.Convergence

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\).

Dann:

- \(\rho < 1\) \(\implies\) \(\sum a_n\) konvergiert absolut

- \(\rho > 1\) \(\implies\) \(\sum a_n\) divergiert

- \(\rho = 1\) \(\implies\) keine Aussage möglich

Proof Included

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\).

Dann:

- \(\rho < 1\) \(\implies\) \(\sum a_n\) konvergiert absolut

- \(\rho > 1\) \(\implies\) \(\sum a_n\) divergiert

- \(\rho = 1\) \(\implies\) keine Aussage möglich

Proof Included

(Wurzelkriterium)

Wenn Quotientenkriterium versagt (\(\rho=1\)), versagt auch das Wurzelkriterium — aber

nicht umgekehrt.

Proof:

- Convergence \(L < 1\)

-

- \(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right| < 1\).

- Choose \(q\) with \(L < q < 1\). Since \(\limsup \left| {a_n}^{1/n} \right| = L\), there exists \(N\) such that for all \(n \geq N: \left| {a_n}^{1/n} \right| \leq\) \(q \implies \left| a_n \right| \leq q^n\)

- So \(\sum_{n=N}^{\infty} \left| a_n \right| \leq\) \(\sum_{n=N}^{\infty} q^n < \infty\) (geometric series, \(q < 1\)).

- Hence \(\sum \left| a_n \right|\) converges. (Majorantenkriterium)

-

Divergence \(L > 1\)

- \(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right|\) \(> 1\).

- Since \(\limsup \left| {a_n}^{1/n} \right| > 1\), there exist infinitely many \(n\) such that: \(\left| {a_n}^{1/n} \right| >\) \(1 \implies |a_n| > 1\)

- So \(|a_n| \not\to 0\), hence \(\sum a_n\) diverges.Convergence

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Wurzelkriterium: Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\). Dann:<br><ul><li>\(\rho {{c1::< 1}}\) \(\implies\) \(\sum a_n\) konvergiert <b>absolut</b></li><li>\(\rho {{c2::> 1}}\) \(\implies\) \(\sum a_n\) divergiert</li><li>\(\rho {{c3::= 1}}\) \(\implies\) <b>keine Aussage</b> möglich<br><br></li></ul><i>Proof Included</i> |

Sei \(\rho = {{c4:: \limsup_{n\to\infty} |a_n|^{1/n} }}\). <br>Dann:<br><ul><li>\(\rho < 1\) \(\implies\) {{c1::\(\sum a_n\) konvergiert <b>absolut</b>}}</li><li>\(\rho > 1\) \(\implies\) {{c1::\(\sum a_n\) divergiert}}</li><li>\(\rho = 1\) \(\implies\) {{c1::<b>keine Aussage</b> möglich}}<br></li></ul><i>Proof Included</i> |

| Extra |

Wenn Quotientenkriterium versagt (\(\rho=1\)), versagt auch das Wurzelkriterium — aber <b>nicht umgekehrt</b>.<br><div><div><br></div></div><div><div><strong>Proof:</strong> </div><ol>

<li>Convergence \(L < 1\)</li><li>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right| < 1\).</li>

<li>Choose \(q\) with \(L < q < 1\). Since \(\limsup \left| {a_n}^{1/n} \right| = L\), there exists \(N\) such that for all \(n \geq N: \left| {a_n}^{1/n} \right| \leq\) \(q \implies \left| a_n \right| \leq q^n\)</li>

<li>So \(\sum_{n=N}^{\infty} \left| a_n \right| \leq\) \(\sum_{n=N}^{\infty} q^n < \infty\) (geometric series, \(q < 1\)).</li>

<li>Hence \(\sum \left| a_n \right|\) converges. (Majorantenkriterium)</li>

</ol>

</li>

<li>

<div>Divergence \(L > 1\)</div>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right|\) \(> 1\).</li>

<li>Since \(\limsup \left| {a_n}^{1/n} \right| > 1\), there exist infinitely many \(n\) such that: \(\left| {a_n}^{1/n} \right| >\) \(1 \implies |a_n| > 1\)</li>

<li>So \(|a_n| \not\to 0\), hence \(\sum a_n\) diverges.Convergence </li></ol></li></ol></div> |

(Wurzelkriterium)<br><br>Wenn Quotientenkriterium versagt (\(\rho=1\)), versagt auch das Wurzelkriterium — aber <b>nicht umgekehrt</b>.<br><div><div><br></div></div><div><div><strong>Proof:</strong> </div><ol>

<li>Convergence \(L < 1\)</li><li>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right| < 1\).</li>

<li>Choose \(q\) with \(L < q < 1\). Since \(\limsup \left| {a_n}^{1/n} \right| = L\), there exists \(N\) such that for all \(n \geq N: \left| {a_n}^{1/n} \right| \leq\) \(q \implies \left| a_n \right| \leq q^n\)</li>

<li>So \(\sum_{n=N}^{\infty} \left| a_n \right| \leq\) \(\sum_{n=N}^{\infty} q^n < \infty\) (geometric series, \(q < 1\)).</li>

<li>Hence \(\sum \left| a_n \right|\) converges. (Majorantenkriterium)</li>

</ol>

</li>

<li>

<div>Divergence \(L > 1\)</div>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \limsup_{n\to\infty} \left| {a_n}^{1/n} \right|\) \(> 1\).</li>

<li>Since \(\limsup \left| {a_n}^{1/n} \right| > 1\), there exist infinitely many \(n\) such that: \(\left| {a_n}^{1/n} \right| >\) \(1 \implies |a_n| > 1\)</li>

<li>So \(|a_n| \not\to 0\), hence \(\sum a_n\) diverges.Convergence </li></ol></li></ol></div> |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 22: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: AO&PBz(QiL

modified

Before

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz

Eine Folge \((a_n)_{n \in \mathbb{N_0}}\) konvergiert, falls:

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz

Eine Folge \((a_n)_{n \in \mathbb{N_0}}\) konvergiert, falls:

\[\forall \varepsilon > 0 \; \exists N > 0 \text{ so dass } \forall n > N : |a_n - L| < \varepsilon\]

After

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz

Wann konvergiert eine Folge \((a_n)_{n \in \mathbb{N_0}}\)?

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz

Wann konvergiert eine Folge \((a_n)_{n \in \mathbb{N_0}}\)?

\[\text{Wenn }\forall \varepsilon > 0 \; \exists N > 0 \text{, so dass } \forall n > N : |a_n - L| < \varepsilon\]

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Eine Folge \((a_n)_{n \in \mathbb{N_0}}\) konvergiert, falls: |

Wann konvergiert eine Folge \((a_n)_{n \in \mathbb{N_0}}\)? |

| Back |

\[\forall \varepsilon > 0 \; \exists N > 0 \text{ so dass } \forall n > N : |a_n - L| < \varepsilon\]<br> |

\[\text{Wenn }\forall \varepsilon > 0 \; \exists N > 0 \text{, so dass } \forall n > N : |a_n - L| < \varepsilon\] |

Tags:

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz

Note 23: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: BYMIpKIF1M

modified

Before

Front

ETH::2._Semester::Analysis::4._Funktionen::1._Grundlagen

Eine Funktion \(f : \mathbb{R} \rightarrow \mathbb{R}\) ist ungerade falls gilt {{c2::\(\forall x \in \mathbb{R} \ \ f(-x) = -f(x)\) }}

Back

ETH::2._Semester::Analysis::4._Funktionen::1._Grundlagen

Eine Funktion \(f : \mathbb{R} \rightarrow \mathbb{R}\) ist ungerade falls gilt {{c2::\(\forall x \in \mathbb{R} \ \ f(-x) = -f(x)\) }}

\(x^3\) (ungerade Potenzen) sind zum Beispiel ungerade, oder \(\sin(x)\)

After

Front

ETH::2._Semester::Analysis::4._Funktionen::1._Grundlagen

Eine Funktion \(f : \mathbb{R} \rightarrow \mathbb{R}\) ist ungerade, falls gilt {{c2::\(\forall x \in \mathbb{R} \ \ f(-x) = -f(x)\).}}

Back

ETH::2._Semester::Analysis::4._Funktionen::1._Grundlagen

Eine Funktion \(f : \mathbb{R} \rightarrow \mathbb{R}\) ist ungerade, falls gilt {{c2::\(\forall x \in \mathbb{R} \ \ f(-x) = -f(x)\).}}

\(x^3\) (ungerade Potenzen) sind zum Beispiel ungerade, oder \(\sin(x)\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |