Note 1: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: 1V$+8N)nVy

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen

Die Indikator-Zufallsvariable (Bernoulli-Variable) für Ereignis \(A\) ist:

\[X_A(\omega) := {{c1:: \begin{cases} 1 & \omega \in A \\ 0 & \omega \notin A \end{cases} }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen

Die Indikator-Zufallsvariable (Bernoulli-Variable) für Ereignis \(A\) ist:

\[X_A(\omega) := {{c1:: \begin{cases} 1 & \omega \in A \\ 0 & \omega \notin A \end{cases} }}\]

Es gilt: \(\mathbb{E}[X_A] = \).

Beweis: \(\mathbb{E}[X_A] = 1 \cdot \Pr[A] + 0 \cdot \Pr[A^c] = \Pr[A]\).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen

Die Indikator-Zufallsvariable (Bernoulli-Variable) für Ereignis \(A\) ist:

\[X_A(\omega) := {{c1:: \begin{cases} 1 & \omega \in A \\ 0 & \omega \notin A \end{cases} }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen

Die Indikator-Zufallsvariable (Bernoulli-Variable) für Ereignis \(A\) ist:

\[X_A(\omega) := {{c1:: \begin{cases} 1 & \omega \in A \\ 0 & \omega \notin A \end{cases} }}\]

Es gilt: \(\mathbb{E}[X_A] = \Pr[A]\).

Beweis: \(\mathbb{E}[X_A] = 1 \cdot \Pr[A] + 0 \cdot \Pr[A^c] = \Pr[A]\).

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

Es gilt: \(\mathbb{E}[X_A] = {{c3::\Pr[A]}}\).<br><br>Beweis: \(\mathbb{E}[X_A] = 1 \cdot \Pr[A] + 0 \cdot \Pr[A^c] = \Pr[A]\). |

Es gilt: \(\mathbb{E}[X_A] = \Pr[A]\).<br><br>Beweis: \(\mathbb{E}[X_A] = 1 \cdot \Pr[A] + 0 \cdot \Pr[A^c] = \Pr[A]\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen

basic

Note 2: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: FY+KJ_cd2]

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Was besagt der Vierfarbensatz?

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Was besagt der Vierfarbensatz?

Jeder planare Graph (jede Landkarte) lässt sich mit \(\leq 4\) Farben färben.

Formal:

Für jeden planaren Graphen \(G\) gilt \(\chi(G) \leq 4\).

(Appel & Haken, 1976 — erster computergestützter Beweis)

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Was besagt der Vierfarbensatz?

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Was besagt der Vierfarbensatz?

Jeder planare Graph (jede Landkarte) lässt sich mit \(\leq 4\) Farben färben.

Formal:

Für jeden planaren Graphen \(G\) gilt \(\chi(G) \leq 4\).

(Appel & Haken, 1976 - erster computergestützter Beweis)

Field-by-field Comparison

| Field |

Before |

After |

| Back |

Jeder planare Graph (jede Landkarte) lässt sich mit \(\leq 4\) Farben färben.<br><br>Formal: <br>Für jeden planaren Graphen \(G\) gilt \(\chi(G) \leq 4\).<br>(Appel & Haken, 1976 — erster computergestützter Beweis) |

Jeder planare Graph (jede Landkarte) lässt sich mit \(\leq 4\) Farben färben.<br><br><b>Formal:</b> <br>Für jeden planaren Graphen \(G\) gilt \(\chi(G) \leq 4\).<br>(Appel & Haken, 1976 - erster computergestützter Beweis) |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Note 3: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: JF0l2bCbMG

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten mit Zurücklegen zu wählen (Reihenfolge egal) (Multiset) ist:

\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten mit Zurücklegen zu wählen (Reihenfolge egal) (Multiset) ist:

\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \]

Auch bekannt als „Sterne und Striche“ (Stars and Bars).

Beispiel:

Wie viele Möglichkeiten, 3 Kugeln aus {rot, blau, grün} mit Zurücklegen zu ziehen?

\(\binom{3+3-1}{3} = \binom{5}{3} = 10\).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten mit Zurücklegen zu wählen (Reihenfolge egal, Multiset) ist:

\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten mit Zurücklegen zu wählen (Reihenfolge egal, Multiset) ist:

\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \]

Auch bekannt als „Sterne und Striche“ (Stars and Bars).

Beispiel:

Wie viele Möglichkeiten, 3 Kugeln aus {rot, blau, grün} mit Zurücklegen zu ziehen?

\(\binom{3+3-1}{3} = \binom{5}{3} = 10\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten <strong>mit Zurücklegen</strong> zu wählen (Reihenfolge egal) (Multiset) ist:<br>\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \] |

Die Anzahl der Möglichkeiten, \(k\) Objekte aus \(n\) Sorten <strong>mit Zurücklegen</strong> zu wählen (Reihenfolge egal, Multiset) ist:<br>\[{{c2::\binom{n + k - 1}{k} }} = {{c1::\frac{(n+k-1)!}{k!\,(n-1)!} }} \] |

| Extra |

Auch bekannt als „Sterne und Striche“ (Stars and Bars).<br><br>Beispiel: <br>Wie viele Möglichkeiten, 3 Kugeln aus {rot, blau, grün} mit Zurücklegen zu ziehen?<br>\(\binom{3+3-1}{3} = \binom{5}{3} = 10\). |

Auch bekannt als „Sterne und Striche“ (Stars and Bars).<br><br><b>Beispiel:</b> <br>Wie viele Möglichkeiten, 3 Kugeln aus {rot, blau, grün} mit Zurücklegen zu ziehen?<br>\(\binom{3+3-1}{3} = \binom{5}{3} = 10\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 4: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: MrF3sR7oMk

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?

| Reihenfolge wichtig | Reihenfolge egal |

|---|

| Ohne Zurücklegen | {{c1::\(\dfrac{n!}{(n-k)!}\)}} | {{c2::\(\dbinom{n}{k}\)}} |

|---|

| Mit Zurücklegen | \(n^k\) | {{c4::\(\dbinom{n+k-1}{k}\)}} |

|---|

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?

| Reihenfolge wichtig | Reihenfolge egal |

|---|

| Ohne Zurücklegen | {{c1::\(\dfrac{n!}{(n-k)!}\)}} | {{c2::\(\dbinom{n}{k}\)}} |

|---|

| Mit Zurücklegen | \(n^k\) | {{c4::\(\dbinom{n+k-1}{k}\)}} |

|---|

Eselsbrücke: geordnet ohne = Permutation, ungeordnet ohne = Kombination,

geordnet mit = Wort über Alphabet, ungeordnet mit = Multiset (Sterne & Striche).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?

| Reihenfolge wichtig | Reihenfolge egal |

|---|

| Ohne Zurücklegen | {{c1:: \(\dfrac{n!}{(n-k)!}\)}} | {{c2:: \(\dbinom{n}{k}\)}} |

|---|

| Mit Zurücklegen |

\(n^k\) | {{c4:: \(\dbinom{n+k-1}{k}\)}} |

|---|

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?

| Reihenfolge wichtig | Reihenfolge egal |

|---|

| Ohne Zurücklegen | {{c1:: \(\dfrac{n!}{(n-k)!}\)}} | {{c2:: \(\dbinom{n}{k}\)}} |

|---|

| Mit Zurücklegen |

\(n^k\) | {{c4:: \(\dbinom{n+k-1}{k}\)}} |

|---|

Eselsbrücke: - Reihenfolge wichtig, ohne Zurücklegen → Permutation

- Reihenfolge egal, ohne Zurücklegen → Kombination

- Reihenfolge wichtig, mit Zurücklegen → Wort über Alphabet

- Reihenfolge egal, mit Zurücklegen → Multiset (Sterne & Striche)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?<br><br><table><tbody><tr><th></th><th>Reihenfolge wichtig</th><th>Reihenfolge egal</th></tr><tr><th>Ohne Zurücklegen</th><td>{{c1::\(\dfrac{n!}{(n-k)!}\)}}</td><td>{{c2::\(\dbinom{n}{k}\)}}</td></tr><tr><th>Mit Zurücklegen</th><td>{{c3::\(n^k\)}}</td><td>{{c4::\(\dbinom{n+k-1}{k}\)}}</td></tr></tbody></table> |

Wie viele Möglichkeiten gibt es, \(k\) Objekte aus \(n\) zu wählen?<br><br><table><tbody><tr><th></th><th>Reihenfolge wichtig </th><th> Reihenfolge egal</th></tr><tr><th>Ohne Zurücklegen</th><td style="text-align: center; "><div style="text-align: center;">{{c1::</div>\(\dfrac{n!}{(n-k)!}\)}}</td><td style="text-align: center; "><div style="text-align: center;">{{c2::</div>\(\dbinom{n}{k}\)}}</td></tr><tr><th>Mit Zurücklegen</th><td style="text-align: center; "><div style="text-align: center;">{{c3::</div>\(n^k\)}}</td><td style="text-align: center; "><div style="text-align: center;">{{c4::</div>\(\dbinom{n+k-1}{k}\)}}</td></tr></tbody></table> |

| Extra |

Eselsbrücke: geordnet ohne = Permutation, ungeordnet ohne = Kombination,<br>geordnet mit = Wort über Alphabet, ungeordnet mit = Multiset (Sterne & Striche). |

<b>Eselsbrücke:</b> <br><ul><li>Reihenfolge wichtig, ohne Zurücklegen → Permutation</li><li>Reihenfolge egal, ohne Zurücklegen → Kombination</li><li>Reihenfolge wichtig, mit Zurücklegen → Wort über Alphabet</li><li>Reihenfolge egal, mit Zurücklegen → Multiset (Sterne & Striche)</li></ul>

|

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 5: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: RxK1aiA$%s

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

ohne Zurüclegen (Reihenfolge wichtig) ist:

\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

ohne Zurüclegen (Reihenfolge wichtig) ist:

\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\]

Beispiel: Wie viele 3-stellige PINs aus den Ziffern 0–9 ohne Wiederholung?

\(P(10,3) = 10 \cdot 9 \cdot 8 = 720\).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

ohne Zurücklegen (Reihenfolge wichtig) ist:

\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

ohne Zurücklegen (Reihenfolge wichtig) ist:

\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\]

Beispiel:

Wie viele 3-stellige PINs aus den Ziffern 0–9 ohne Wiederholung?

\(P(10,3) = 10 \cdot 9 \cdot 8 = 720\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten<br><strong>ohne Zurüclegen</strong> (Reihenfolge wichtig) ist:<br><br>\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\]<br><br> |

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten<br><strong>ohne Zurücklegen</strong> (Reihenfolge wichtig) ist:<br>\[P(n, k) = {{c1::\frac{n!}{(n-k)!} = n \cdot (n-1) \cdots (n-k+1) }}\] |

| Extra |

Beispiel: Wie viele 3-stellige PINs aus den Ziffern 0–9 ohne Wiederholung?<br>\(P(10,3) = 10 \cdot 9 \cdot 8 = 720\). |

<b>Beispiel:</b> <br>Wie viele 3-stellige PINs aus den Ziffern 0–9 ohne Wiederholung?<br>\(P(10,3) = 10 \cdot 9 \cdot 8 = 720\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 6: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: X%!FejeNGl

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Der Satz von Bayes lässt sich als Update-Regel schreiben:

\[{{c1::\text{Posterior} }} \propto {{c2::\text{Likelihood} \times \text{Prior} }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Der Satz von Bayes lässt sich als Update-Regel schreiben:

\[{{c1::\text{Posterior} }} \propto {{c2::\text{Likelihood} \times \text{Prior} }}\]

\(\Pr[H \mid E] \propto \Pr[E \mid H] \cdot \Pr[H]\).

Das \(\propto\) (proportional zu) bedeutet: durch \(\Pr[E]\) normieren.

Intuition: Der Prior ist die Ausgangsmeinung; die Likelihood gewichtet, wie stark die

Evidenz diese Meinung in Richtung \(H\) verschiebt.

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Der Satz von Bayes lässt sich als Update-Regel schreiben:

\[{{c1::\text{Posterior} }} \propto {{c2::\text{Likelihood} \times \text{Prior} }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Der Satz von Bayes lässt sich als Update-Regel schreiben:

\[{{c1::\text{Posterior} }} \propto {{c2::\text{Likelihood} \times \text{Prior} }}\]

\(\Pr[H \mid E] \propto \Pr[E \mid H] \cdot \Pr[H]\).

Das \(\propto\) (proportional zu) bedeutet, dass die Normierungskonstante \(\Pr[E]\) im Nenner fehlt.

Intuition:

Der Prior \(\Pr[H]\) ist unsere Ausgangsmeinung über \(H\). Die Likelihood \(\Pr[E \mid H]\) gewichtet, wie stark die beobachtete Evidenz \(E\) diese Meinung in Richtung \(H\) verschiebt.

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

\(\Pr[H \mid E] \propto \Pr[E \mid H] \cdot \Pr[H]\).<br><br>Das \(\propto\) (proportional zu) bedeutet: durch \(\Pr[E]\) normieren.<br>Intuition: Der Prior ist die Ausgangsmeinung; die Likelihood gewichtet, wie stark die<br>Evidenz diese Meinung in Richtung \(H\) verschiebt. |

\(\Pr[H \mid E] \propto \Pr[E \mid H] \cdot \Pr[H]\).<br><br>Das \(\propto\) (proportional zu) bedeutet, dass die Normierungskonstante \(\Pr[E]\) im Nenner fehlt.

<br><br><b>Intuition:</b> <br>Der Prior \(\Pr[H]\) ist unsere Ausgangsmeinung über \(H\). Die Likelihood \(\Pr[E \mid H]\) gewichtet, wie stark die beobachtete Evidenz \(E\) diese Meinung in Richtung \(H\) verschiebt. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

basic

Note 7: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: [baaJj9miG

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Was ist der Unterschied zwischen paarweiser und stochastischer (gegenseitiger) Unabhängigkeit von \(n\) Ereignissen?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Was ist der Unterschied zwischen paarweiser und stochastischer (gegenseitiger) Unabhängigkeit von \(n\) Ereignissen?

Paarweise: \(\Pr[A_i \cap A_j] = \Pr[A_i]\Pr[A_j]\) für alle \(i \neq j\).

Stochastisch (mutual): Bedingung gilt für ALLE nichtleeren Teilmengen \(I \subseteq [n]\).

Paarweise Unabhängigkeit \(\not\Rightarrow\) stochastische Unabhängigkeit!

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Was ist der Unterschied zwischen paarweiser und stochastischer (gegenseitiger) Unabhängigkeit von \(n\) Ereignissen?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Was ist der Unterschied zwischen paarweiser und stochastischer (gegenseitiger) Unabhängigkeit von \(n\) Ereignissen?

Stochastische Unabhängigkeit ist die stärkere Forderung: Paarweise Unabhängigkeit allein reicht dafür nicht aus.

Paarweise Unabhängigkeit:

Für je zwei der \(n\) Ereignisse gilt, dass das eine keinen Einfluss auf die Wahrscheinlichkeit des anderen hat:

\[\Pr[A_i \cap A_j] = \Pr[A_i]\,\Pr[A_j] \quad \text{für alle } i \neq j.\]Stochastische (gegenseitige) Unabhängigkeit:

Egal welche Teilmenge der \(n\) Ereignisse man betrachtet – ob Paare, Tripel, oder alle gleichzeitig – die Ereignisse beeinflussen sich gegenseitig nicht. Das heisst, das Wissen über beliebig viele der Ereignisse ändert die Wahrscheinlichkeit der übrigen nicht:

\[\Pr\!\Big[\bigcap_{i \in I} A_i\Big] = \prod_{i \in I} \Pr[A_i] \quad \text{für alle } \emptyset \neq I \subseteq [n].\]

Field-by-field Comparison

| Field |

Before |

After |

| Back |

Paarweise: \(\Pr[A_i \cap A_j] = \Pr[A_i]\Pr[A_j]\) für alle \(i \neq j\).<br>Stochastisch (mutual): Bedingung gilt für ALLE nichtleeren Teilmengen \(I \subseteq [n]\).<br><br>Paarweise Unabhängigkeit \(\not\Rightarrow\) stochastische Unabhängigkeit! |

<b>Stochastische Unabhängigkeit ist die stärkere Forderung:</b> Paarweise Unabhängigkeit allein reicht dafür nicht aus.<br><br>Paarweise Unabhängigkeit: <br>Für je zwei der \(n\) Ereignisse gilt, dass das eine keinen Einfluss auf die Wahrscheinlichkeit des anderen hat:

\[\Pr[A_i \cap A_j] = \Pr[A_i]\,\Pr[A_j] \quad \text{für alle } i \neq j.\]Stochastische (gegenseitige) Unabhängigkeit: <br>Egal welche Teilmenge der \(n\) Ereignisse man betrachtet – ob Paare, Tripel, oder alle gleichzeitig – die Ereignisse beeinflussen sich gegenseitig nicht. Das heisst, das Wissen über beliebig viele der Ereignisse ändert die Wahrscheinlichkeit der übrigen nicht:

\[\Pr\!\Big[\bigcap_{i \in I} A_i\Big] = \prod_{i \in I} \Pr[A_i] \quad \text{für alle } \emptyset \neq I \subseteq [n].\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 8: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: _0Pe(qekc5

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Es gilt:

\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::binomial}} = 2^n\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Es gilt:

\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::binomial}} = 2^n\]

Beweis: Setze \(x = y = 1\) im Binomialsatz: \((1+1)^n = \sum_{k=0}^n \binom{n}{k}\).

Interpretation: Anzahl aller Teilmengen einer \(n\)-elementigen Menge ist \(2^n\).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Es gilt:

\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::\text{Binomialsatz} }} = 2^n\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Es gilt:

\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::\text{Binomialsatz} }} = 2^n\]

Beweis: Setze \(x = y = 1\) im Binomialsatz: \((1+1)^n = \sum_{k=0}^n \binom{n}{k}\).

Interpretation: Anzahl aller Teilmengen einer \(n\)-elementigen Menge ist \(2^n\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Es gilt:<br>\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::binomial}} = {{c1::2^n}}\] |

Es gilt:<br>\[{{c1::\sum_{k=0}^{n} \binom{n}{k}::\text{Binomialsatz} }} = {{c2::2^n}}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 9: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: h&$`q|@{5C

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Die Heuristik findet eine Färbung mit \(

\leq 6\) Farben für planare Graphen.

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Die Heuristik findet eine Färbung mit \(

\leq 6\) Farben für planare Graphen.

After

Front

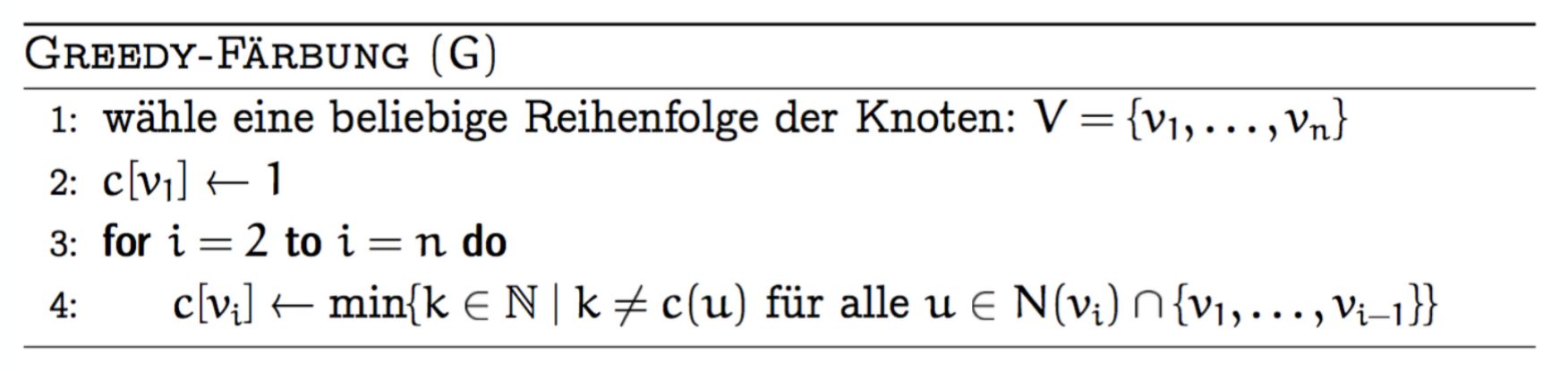

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

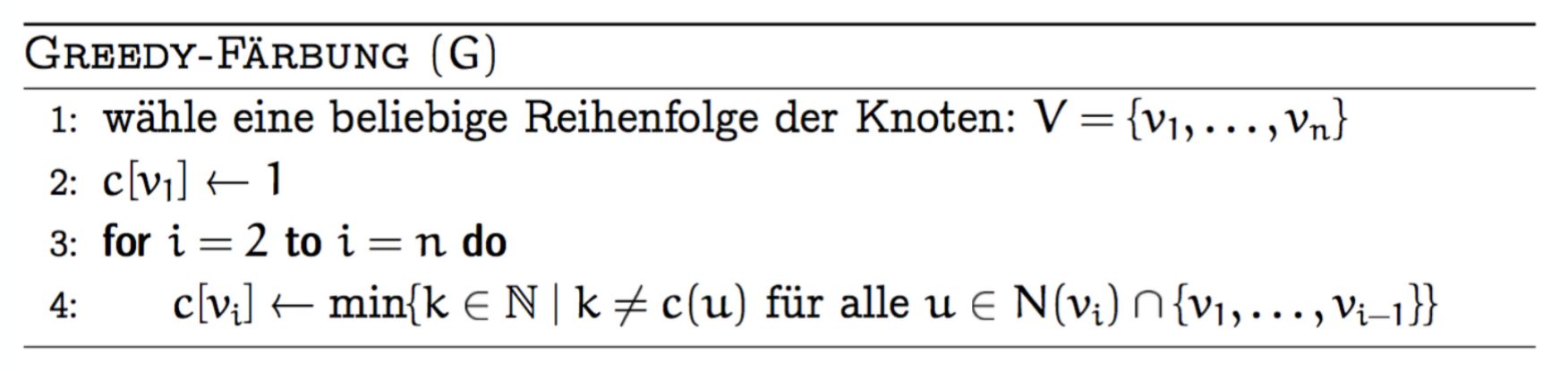

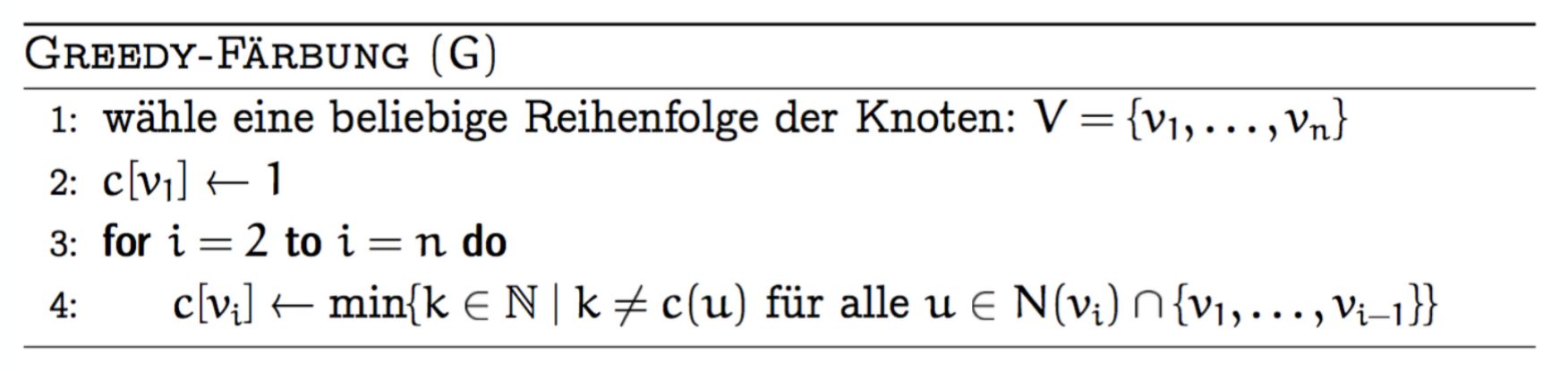

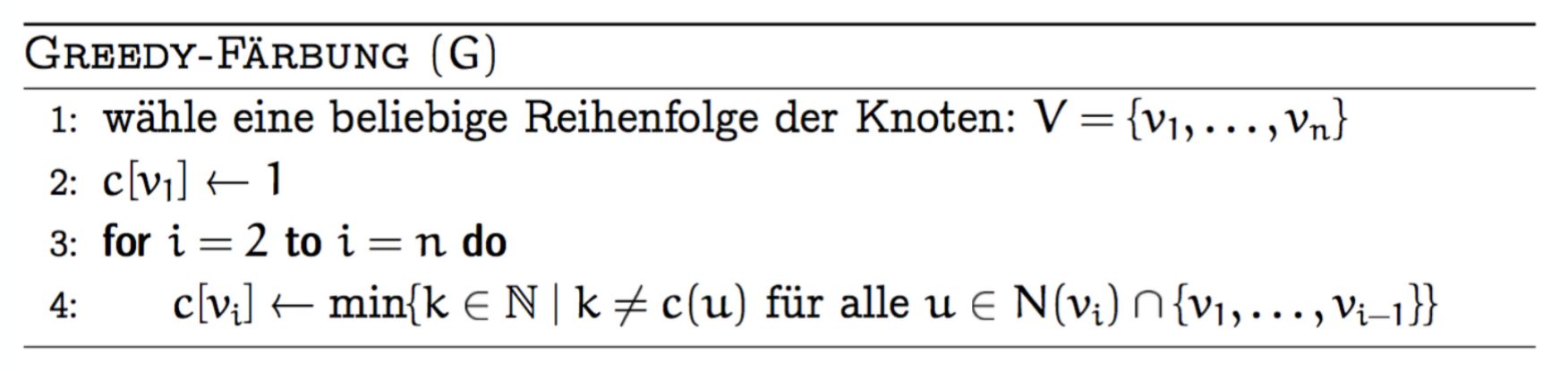

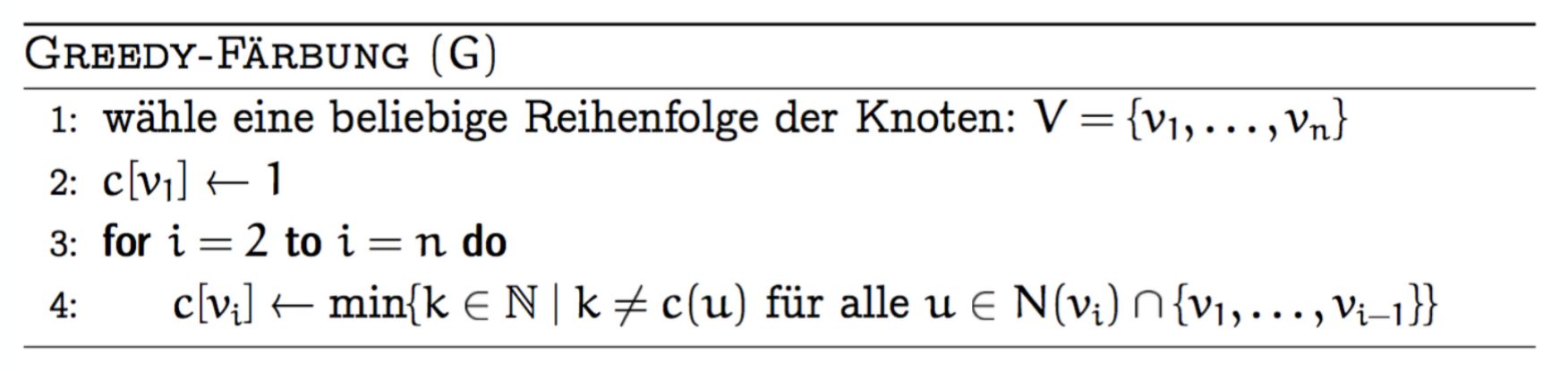

Heuristik:

\(v_n\) := Knoten vom kleinsten Grad. Lösche \(v_n\).

\(v_{n-1}\) := Knoten vom kleinsten Grad im Restgraph. Lösche \(v_{n-1}\). Iteriere.

Die Heuristik findet eine Färbung mit \(

\leq 6\) Farben für planare Graphen.

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Heuristik:

\(v_n\) := Knoten vom kleinsten Grad. Lösche \(v_n\).

\(v_{n-1}\) := Knoten vom kleinsten Grad im Restgraph. Lösche \(v_{n-1}\). Iteriere.

Die Heuristik findet eine Färbung mit \(

\leq 6\) Farben für planare Graphen.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<img src="paste-7df7c4f76513b8f48a5f5c4a0fbf613a27433cfe.jpg"><br><br>Die Heuristik findet eine Färbung mit \({{c1::\leq 6}}\) Farben für planare Graphen. |

<img src="paste-7df7c4f76513b8f48a5f5c4a0fbf613a27433cfe.jpg"><br><br>Heuristik:<br>\(v_n\) := Knoten vom kleinsten Grad. Lösche \(v_n\).<br>\(v_{n-1}\) := Knoten vom kleinsten Grad im Restgraph. Lösche \(v_{n-1}\). Iteriere.<br><br>Die Heuristik findet eine Färbung mit \({{c1::\leq 6}}\) Farben für planare Graphen. |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Note 10: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: hFx`}69EnK

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Der Algorithmus von Hopcroft-Karp (bipartiter Graph) verbessert den augmentierenden-Pfad-Algorithmus,

indem er pro Iteration nicht nur einen, sondern eine

inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade

findet und simultan augmentiert.

Die while-Schleife wird nur \(O(\sqrt{|V|})\) mal durchlaufen.

Proof Sketch Included

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Der Algorithmus von Hopcroft-Karp (bipartiter Graph) verbessert den augmentierenden-Pfad-Algorithmus,

indem er pro Iteration nicht nur einen, sondern eine

inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade

findet und simultan augmentiert.

Die while-Schleife wird nur \(O(\sqrt{|V|})\) mal durchlaufen.

Proof Sketch Included

Gesamtlaufzeit: \(O(\sqrt{|V|} \cdot (|V| + |E|))\).

Proof Sketch

Augmentieren mit kürzestem Pfad \(P\) erhöht die Länge des nächsten kürzesten Pfades um mindestens 2.

- Sei M ein Matching, für das der kürzeste augmentierende Pfad Länge k hat und M' ein anderes beliebiges Matching. Dann gilt \(|M'| \le |M| + \frac{|V|}{k + 1}\)

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Der Algorithmus von Hopcroft-Karp (bipartiter Graph) verbessert den augmentierenden-Pfad-Algorithmus, indem er pro Iteration nicht nur einen, sondern eine inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade findet und simultan augmentiert.

Die while-Schleife wird nur \(O({{c2::\sqrt{|V|} }})\) mal durchlaufen.

Proof Sketch Included

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Der Algorithmus von Hopcroft-Karp (bipartiter Graph) verbessert den augmentierenden-Pfad-Algorithmus, indem er pro Iteration nicht nur einen, sondern eine inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade findet und simultan augmentiert.

Die while-Schleife wird nur \(O({{c2::\sqrt{|V|} }})\) mal durchlaufen.

Proof Sketch Included

Gesamtlaufzeit: \(O(\sqrt{|V|} \cdot (|V| + |E|))\).

Proof Sketch

Augmentieren mit kürzestem Pfad \(P\) erhöht die Länge des nächsten kürzesten Pfades um mindestens 2.

- Sei M ein Matching, für das der kürzeste augmentierende Pfad Länge k hat und M' ein anderes beliebiges Matching. Dann gilt \(|M'| \le |M| + \frac{|V|}{k + 1}\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Der Algorithmus von Hopcroft-Karp (<b>bipartiter Graph</b>) verbessert den augmentierenden-Pfad-Algorithmus,<br>indem er pro Iteration nicht nur einen, sondern eine<br>{{c1::inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade}}<br>findet und simultan augmentiert.<br><br>Die while-Schleife wird nur \(O({{c2::\sqrt{|V|}}})\) mal durchlaufen.<br><i>Proof Sketch Included</i> |

Der Algorithmus von Hopcroft-Karp (<b>bipartiter Graph</b>) verbessert den augmentierenden-Pfad-Algorithmus, indem er pro Iteration nicht nur einen, sondern eine {{c1::inklusionsmaximale Menge paarweise disjunkter kürzester augmentierender Pfade}} findet und simultan augmentiert.<br><br>Die while-Schleife wird nur \(O({{c2::\sqrt{|V|} }})\) mal durchlaufen.<br><br><i>Proof Sketch Included</i> |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Note 11: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: hk@olmS7-#

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]\]

Umgestellt ergibt sich direkt der Satz von Bayes.

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]\]

Umgestellt ergibt sich direkt der Satz von Bayes.

Beide Seiten sind gleich, weil \(\Pr[A \cap B]\) symmetrisch in \(A\) und \(B\) ist.

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]\]

Umgestellt ergibt sich direkt der Satz von Bayes.

Beide Seiten sind gleich, weil \(\Pr[A \cap B]\) symmetrisch in \(A\) und \(B\) ist.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:<br>\[\Pr[A \cap B] = {{c1::\Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]}}\]<br>Umgestellt ergibt sich direkt der Satz von Bayes. |

Für Ereignisse \(A, B\) mit \(\Pr[A], \Pr[B] > 0\) gilt:<br>\[\Pr[A \cap B] = {{c1::\Pr[A] \cdot \Pr[B \mid A] = \Pr[B] \cdot \Pr[A \mid B]}}\] |

| Extra |

Beide Seiten sind gleich, weil \(\Pr[A \cap B]\) symmetrisch in \(A\) und \(B\) ist. |

Umgestellt ergibt sich direkt der Satz von Bayes.<br><br>Beide Seiten sind gleich, weil \(\Pr[A \cap B]\) symmetrisch in \(A\) und \(B\) ist. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

basic

Note 12: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: jc@5=H8@[9

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Satz von Bayes: Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). Dann gilt:

\[\Pr[A|B] = {{c1::\frac{\Pr[B|A] \cdot \Pr[A]}{\Pr[B]}}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Satz von Bayes: Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). Dann gilt:

\[\Pr[A|B] = {{c1::\frac{\Pr[B|A] \cdot \Pr[A]}{\Pr[B]}}}.\]

Folgt direkt: \(\Pr[A|B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B|A]\cdot\Pr[A]}{\Pr[B]}\).

Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):

\(\Pr[A_i|B] = \frac{\Pr[B|A_i]\Pr[A_i]}{\sum_j \Pr[B|A_j]\Pr[A_j]}\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\]

(Satz von Bayes)

Es folgt direkt: \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B\mid A]\cdot\Pr[A]}{\Pr[B]}\).

Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):

\(\Pr[A_i\mid B] = \frac{\Pr[B\mid A_i]\Pr[A_i]}{\sum_j \Pr[B\mid A_j]\Pr[A_j]}\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Satz von Bayes: Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). Dann gilt:<br>\[\Pr[A|B] = {{c1::\frac{\Pr[B|A] \cdot \Pr[A]}{\Pr[B]}}}.\] |

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). <br>Dann gilt:<br>\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\] |

| Extra |

Folgt direkt: \(\Pr[A|B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B|A]\cdot\Pr[A]}{\Pr[B]}\).<br>Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):<br><br>\(\Pr[A_i|B] = \frac{\Pr[B|A_i]\Pr[A_i]}{\sum_j \Pr[B|A_j]\Pr[A_j]}\). |

(Satz von Bayes)<br><br>Es folgt direkt: \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B\mid A]\cdot\Pr[A]}{\Pr[B]}\).<br>Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):<br><br>\(\Pr[A_i\mid B] = \frac{\Pr[B\mid A_i]\Pr[A_i]}{\sum_j \Pr[B\mid A_j]\Pr[A_j]}\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 13: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: mNSCrvA/%f

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\)von Elementarereignissen.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\)von Elementarereignissen.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\) von Elementarereignissen.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\) von Elementarereignissen.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\)von {{c1::Elementarereignissen}}. |

Ein diskreter Wahrscheinlichkeitsraum ist bestimmt durch eine Ergebnismenge \(\Omega = \{\omega_1, \omega_2, \ldots\}\) von {{c1::Elementarereignissen}}. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Note 14: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: ms@ofzVlpa

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Wie heißen die vier Terme im Satz von Bayes

\(\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\)?

- \(\Pr[H]\) Prior (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).

- \(\Pr[E \mid H]\) Likelihood: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?

- \(\Pr[H \mid E]\) Posterior: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)

- \(\Pr[E]\) Evidenz (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Wie heißen die vier Terme im Satz von Bayes

\(\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\)?

- \(\Pr[H]\) Prior (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).

- \(\Pr[E \mid H]\) Likelihood: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?

- \(\Pr[H \mid E]\) Posterior: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)

- \(\Pr[E]\) Evidenz (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Wie heißen die vier Terme im Satz von Bayes? \[\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\]

- \(\Pr[H]\) Prior (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).

- \(\Pr[E \mid H]\) Likelihood: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?

- \(\Pr[H \mid E]\) Posterior: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)

- \(\Pr[E]\) Evidenz (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Wie heißen die vier Terme im Satz von Bayes? \[\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\]

- \(\Pr[H]\) Prior (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).

- \(\Pr[E \mid H]\) Likelihood: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?

- \(\Pr[H \mid E]\) Posterior: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)

- \(\Pr[E]\) Evidenz (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Wie heißen die vier Terme im Satz von Bayes<br>\(\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\)?<br><br><ul><li>\(\Pr[H]\) {{c1::<strong>Prior</strong> (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).}}</li><li>\(\Pr[E \mid H]\) {{c22::<strong>Likelihood</strong>: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?}}</li><li>\(\Pr[H \mid E]\) {{c3::<strong>Posterior</strong>: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)}}</li><li>\(\Pr[E]\) {{c4::<strong>Evidenz</strong> (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung}}</li></ul> |

Wie heißen die vier Terme im Satz von Bayes? \[\Pr[H \mid E] = \dfrac{\Pr[E \mid H] \cdot \Pr[H]}{\Pr[E]}\]<ul><li>\(\Pr[H]\) {{c1::<strong>Prior</strong> (Vorab-Wahrscheinlichkeit): Glaube an \(H\) vor Beobachtung von \(E\).}}</li><li>\(\Pr[E \mid H]\) {{c2::<strong>Likelihood</strong>: Wie wahrscheinlich ist die Evidenz \(E\), wenn \(H\) gilt?}}</li><li>\(\Pr[H \mid E]\) {{c3::<strong>Posterior</strong>: Aktualisierter Glaube an \(H\) nach Beobachtung von \(E\)}}</li><li>\(\Pr[E]\) {{c4::<strong>Evidenz</strong> (Normierungskonstante): Gesamtwahrscheinlichkeit der Beobachtung}}</li></ul> |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

basic

Note 15: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: o78LP-Mw-W

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit

\(\chi(G_k) \geq k\).

(Mycielski-Konstruktion)

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit

\(\chi(G_k) \geq k\).

(Mycielski-Konstruktion)

Konstruktion: Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):

Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.

Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\).

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

(Mycielski-Konstruktion)

Konstruktion:

Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):

Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.

Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für alle \(k \geq 2\) gibt es einen {{c1::dreiecksfreien}} Graphen \(G_k\) mit<br>\(\chi(G_k) \geq {{c2::k}}\).<br><br>({{c3::Mycielski-Konstruktion}}) |

Für alle \(k \geq 2\) gibt es einen {{c1::dreiecksfreien}} Graphen \(G_k\) mit \(\chi(G_k) \geq {{c2::k}}\). |

| Extra |

Konstruktion: Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):<br>Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.<br>Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\). |

(Mycielski-Konstruktion)<b><br><br>Konstruktion:</b> <br>Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):<br>Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.<br>Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\). |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Note 16: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: tHY-Qji=0u

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Zwei Ereignisse \(A\) und \(B\) heißen stochastisch unabhängig, falls

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B] \]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Zwei Ereignisse \(A\) und \(B\) heißen stochastisch unabhängig, falls

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B] \]

Intuition: Das Eintreten von \(B\) gibt keine Information über \(A\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Zwei Ereignisse \(A\) und \(B\) heißen stochastisch unabhängig, falls

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B] \]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Zwei Ereignisse \(A\) und \(B\) heißen stochastisch unabhängig, falls

\[\Pr[A \cap B] = \Pr[A] \cdot \Pr[B] \]

Intuition:

Das Eintreten von \(B\) beeinflusst die Wahrscheinlichkeit von \(A\) nicht.

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

Intuition: Das Eintreten von \(B\) gibt keine Information über \(A\). |

<b>Intuition: <br></b>Das Eintreten von \(B\) beeinflusst die Wahrscheinlichkeit von \(A\) nicht. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 17: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: ,$5trcvO/g

modified

Before

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

After

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

| Form |

Umformung |

Methode |

| {{c1::\(\dfrac{0}{0}\)}} |

— |

L'Hôpital, kürzen, Taylor |

| {{c2::\(\dfrac{\infty}{\infty}\)}} |

— |

L'Hôpital, führende Terme |

| \(0 \cdot \infty\) |

{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}} |

Umschreiben → L'Hôpital |

| \(\infty - \infty\) |

gemeinsamer Nenner, Konjugat, ausklammern |

{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}} |

| \(0^0\) |

{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(\infty^0\) |

{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

| \(1^\infty\) |

{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}} |

Logarithmieren → \(0 \cdot \infty\) |

(\(0\) und \(\infty\) sind hier Kurzschreibweisen für das Verhalten im Grenzwert: \(0\) steht für „geht gegen \(0\)" und \(\infty\) für „geht gegen \(\infty\)".)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<table style="border-collapse:collapse;width:100%;font-size:0.95em;">

<thead>

<tr style="background:#2d2d2d;color:#fff;">

<th style="padding:8px 12px;border:1px solid #555;">Form</th>

<th style="padding:8px 12px;border:1px solid #555;">Umformung</th>

<th style="padding:8px 12px;border:1px solid #555;">Methode</th>

</tr>

</thead>

<tbody>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c1::\(\dfrac{0}{0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1:: —}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1::L'Hôpital, kürzen, Taylor}}</td>

</tr>

<tr style="background:#1a1a1a;">

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c2::\(\dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::—}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::L'Hôpital, führende Terme}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c3::\(0 \cdot \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::Umschreiben → L'Hôpital}}</td>

</tr>

<tr style="background:#1a1a1a;">

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c4::\(\infty - \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::gemeinsamer Nenner, Konjugat, ausklammern}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c5::\(0^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr style="background:#1a1a1a;">

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c6::\(\infty^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c7::\(1^\infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

</tbody>

</table> |

<table style="border-collapse:collapse;width:100%;font-size:0.95em;">

<thead>

<tr>

<th style="padding:8px 12px;border:1px solid #555;">Form</th>

<th style="padding:8px 12px;border:1px solid #555;">Umformung</th>

<th style="padding:8px 12px;border:1px solid #555;">Methode</th>

</tr>

</thead>

<tbody>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c1::\(\dfrac{0}{0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1:: —}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c1::L'Hôpital, kürzen, Taylor}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c2::\(\dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::—}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c2::L'Hôpital, führende Terme}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c3::\(0 \cdot \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::\(\dfrac{0}{1/\infty} = \dfrac{0}{0}\) oder \(\dfrac{\infty}{1/0} = \dfrac{\infty}{\infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c3::Umschreiben → L'Hôpital}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c4::\(\infty - \infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::gemeinsamer Nenner, Konjugat, ausklammern}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c4::→ \(\dfrac{0}{0}\) oder \(\dfrac{\infty}{\infty}\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c5::\(0^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::\(e^{0 \cdot \ln 0} = e^{0 \cdot (-\infty)}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c5::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c6::\(\infty^0\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::\(e^{0 \cdot \ln \infty} = e^{0 \cdot \infty}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c6::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

<tr>

<td style="padding:8px 12px;border:1px solid #555;text-align:center;">{{c7::\(1^\infty\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::\(e^{\infty \cdot \ln 1} = e^{\infty \cdot 0}\)}}</td>

<td style="padding:8px 12px;border:1px solid #555;">{{c7::Logarithmieren → \(0 \cdot \infty\)}}</td>

</tr>

</tbody>

</table> |

| Extra |

|

(\(0\) und \(\infty\) sind hier Kurzschreibweisen für das Verhalten im Grenzwert: \(0\) steht für „geht gegen \(0\)" und \(\infty\) für „geht gegen \(\infty\)".) |

Tags:

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Note 18: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: ,z5^ljjVx0

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotientenkriterium: Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).

- \(\rho < 1\) \(\implies\) absolut konvergent

- \(\rho > 1\) \(\implies\) divergent

- \(\rho = 1\) \(\implies\) keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotientenkriterium: Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).

- \(\rho < 1\) \(\implies\) absolut konvergent

- \(\rho > 1\) \(\implies\) divergent

- \(\rho = 1\) \(\implies\) keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))

Proof:

- \(\sum a_n \geq 0\), \(\displaystyle L = \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|< 1\)

- Choose \(q\) with \(L < q < 1\). Since \(\left| \frac{a_{n+1}}{a_n} \right| \to L\), there exists \(N\) such that for all \(n \geq N: \left|\frac{a_{n+1}}{a_n} \right| \leq q\) \(\implies\) \(\left|a_{N+k}\right|\leq \left|a_N \right|\cdot q^k\)

- So \(\sum_{k=0}^{\infty} \left| a_{N+k} \right|\) \(\leq \left| a_N \right| \sum_{k=0}^{\infty} q^k\)\(= \frac{\left| a_N \right|}{1-q}\)\(< \infty\) (geometric series, \(q < 1\) ).

- Hence \(\sum a_n\) converges.

-

\(\sum a_n \geq 0, \displaystyle L\) \(= \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|\) \(> 1\).

- Choose \(q\) with \(1 < q < L\). There exists \(N\) such that for all \(n \geq N: \left| \frac{a_{n+1}}{a_n} \right|\) \(\geq q > 1\) \(\implies \left| a_{N+k} \right|\) \(\geq \left| a_N \right| \cdot q^k \to \infty\)

- So \(\left| a_n\right| \not\to 0\), hence \(\sum a_n\) diverges.

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).

- \(\rho < 1\) \(\implies\) absolut konvergent

- \(\rho > 1\) \(\implies\) divergent

- \(\rho = 1\) \(\implies\) keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).

- \(\rho < 1\) \(\implies\) absolut konvergent

- \(\rho > 1\) \(\implies\) divergent

- \(\rho = 1\) \(\implies\) keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))

(Quotientenkriterium)

Proof:

- \(\sum a_n \geq 0\), \(\displaystyle L = \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|< 1\)

- Choose \(q\) with \(L < q < 1\). Since \(\left| \frac{a_{n+1}}{a_n} \right| \to L\), there exists \(N\) such that for all \(n \geq N: \left|\frac{a_{n+1}}{a_n} \right| \leq q\) \(\implies\) \(\left|a_{N+k}\right|\leq \left|a_N \right|\cdot q^k\)

- So \(\sum_{k=0}^{\infty} \left| a_{N+k} \right|\) \(\leq \left| a_N \right| \sum_{k=0}^{\infty} q^k\)\(= \frac{\left| a_N \right|}{1-q}\)\(< \infty\) (geometric series, \(q < 1\) ).

- Hence \(\sum a_n\) converges.

-

\(\sum a_n \geq 0, \displaystyle L\) \(= \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|\) \(> 1\).

- Choose \(q\) with \(1 < q < L\). There exists \(N\) such that for all \(n \geq N: \left| \frac{a_{n+1}}{a_n} \right|\) \(\geq q > 1\) \(\implies \left| a_{N+k} \right|\) \(\geq \left| a_N \right| \cdot q^k \to \infty\)

- So \(\left| a_n\right| \not\to 0\), hence \(\sum a_n\) diverges.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Quotientenkriterium: Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).<br><ul><li>\(\rho < 1\) \(\implies\) {{c1::absolut konvergent}}</li><li>\(\rho > 1\) \(\implies\) {{c1::divergent}}</li><li>\(\rho = 1\) \(\implies\) {{c1::keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))}}</li></ul> |

Sei \(a_n \neq 0\) und \(\rho = \lim_{n\to\infty} \left|\frac{a_{n+1}}{a_n}\right|\).<br><ul><li>\(\rho < 1\) \(\implies\) {{c1::absolut konvergent}}</li><li>\(\rho > 1\) \(\implies\) {{c1::divergent}}</li><li>\(\rho = 1\) \(\implies\) {{c1::keine Aussage (z.B. \(1/n\) und \(1/n^2\) liefern beide \(1\))}}</li></ul> |

| Extra |

<div><strong>Proof:</strong></div>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|< 1\)</li><ol><li>Choose \(q\) with \(L < q < 1\). Since \(\left| \frac{a_{n+1}}{a_n} \right| \to L\), there exists \(N\) such that for all \(n \geq N: \left|\frac{a_{n+1}}{a_n} \right| \leq q\) \(\implies\) \(\left|a_{N+k}\right|\leq \left|a_N \right|\cdot q^k\)</li><li>So \(\sum_{k=0}^{\infty} \left| a_{N+k} \right|\) \(\leq \left| a_N \right| \sum_{k=0}^{\infty} q^k\)\(= \frac{\left| a_N \right|}{1-q}\)\(< \infty\) (geometric series, \(q < 1\) ).</li>

<li>Hence \(\sum a_n\) converges. </li>

</ol>

<li>

<div>\(\sum a_n \geq 0, \displaystyle L\) \(= \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|\) \(> 1\).</div>

<ol>

<li>Choose \(q\) with \(1 < q < L\). There exists \(N\) such that for all \(n \geq N: \left| \frac{a_{n+1}}{a_n} \right|\) \(\geq q > 1\) \(\implies \left| a_{N+k} \right|\) \(\geq \left| a_N \right| \cdot q^k \to \infty\)</li>

<li>So \(\left| a_n\right| \not\to 0\), hence \(\sum a_n\) diverges.</li></ol></li></ol> |

<div>(Quotientenkriterium)<strong><br></strong></div><div><strong><br></strong></div><div><strong>Proof:</strong></div>

<ol>

<li>\(\sum a_n \geq 0\), \(\displaystyle L = \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|< 1\)</li><ol><li>Choose \(q\) with \(L < q < 1\). Since \(\left| \frac{a_{n+1}}{a_n} \right| \to L\), there exists \(N\) such that for all \(n \geq N: \left|\frac{a_{n+1}}{a_n} \right| \leq q\) \(\implies\) \(\left|a_{N+k}\right|\leq \left|a_N \right|\cdot q^k\)</li><li>So \(\sum_{k=0}^{\infty} \left| a_{N+k} \right|\) \(\leq \left| a_N \right| \sum_{k=0}^{\infty} q^k\)\(= \frac{\left| a_N \right|}{1-q}\)\(< \infty\) (geometric series, \(q < 1\) ).</li>

<li>Hence \(\sum a_n\) converges. </li>

</ol>

<li>

<div>\(\sum a_n \geq 0, \displaystyle L\) \(= \lim_{n\to\infty} \left| \frac{a_{n+1}}{a_n} \right|\) \(> 1\).</div>

<ol>

<li>Choose \(q\) with \(1 < q < L\). There exists \(N\) such that for all \(n \geq N: \left| \frac{a_{n+1}}{a_n} \right|\) \(\geq q > 1\) \(\implies \left| a_{N+k} \right|\) \(\geq \left| a_N \right| \cdot q^k \to \infty\)</li>

<li>So \(\left| a_n\right| \not\to 0\), hence \(\sum a_n\) diverges.</li></ol></li></ol> |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 19: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: 1cHWc3lNeG

modified

Before

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Eine divergente Folge kann trotzdem konvergente Teilfolgen besitzen.

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Eine divergente Folge kann trotzdem konvergente Teilfolgen besitzen.

Beispiel:

\(a_n = (-1)^n\) divergiert, aber \(a_{2n} = 1\) und \(a_{2n+1} = -1\) konvergieren.

Umkehrung:

Eine Folge konvergiert gegen \(L\) genau dann, wenn jede Teilfolge gegen \(L\) konvergiert.

After

Front

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Eine divergente Folge kann trotzdem konvergente Teilfolgen besitzen.

Back

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Eine divergente Folge kann trotzdem konvergente Teilfolgen besitzen.

Beispiel:

\(a_n = (-1)^n\) divergiert, aber \(a_{2n} = 1\) und \(a_{2n+1} = -1\) konvergieren.

Umkehrung:

Eine Folge konvergiert gegen \(L\) genau dann, wenn jede Teilfolge gegen \(L\) konvergiert.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Eine <b>divergente</b> Folge kann trotzdem {{c1::konvergente Teilfolgen besitzen}}. |

Eine <b>divergente</b> Folge kann trotzdem {{c1::konvergente Teilfolgen}} besitzen. |

Tags:

ETH::2._Semester::Analysis::2._Folgen::2._Konvergenz::2._Properties

Note 20: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: 9r2wQ@.hKx

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Wurzelkriterium ist stärker: wenn Quotient anwendbar, liefert Wurzel mindestens genauso gutes Ergebnis.

Quotientenkriterium einfacher bei Termen mit \(n!\) oder Potenzen.

Beide versagen für \(\rho = 1\) (z.B. \(p\)-Reihen).

Merke: Wenn Quotient versagt (\(\rho=1\)), versagt auch Wurzel.

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Unterschied Wurzel- vs. Quotientenkriterium?

Das Wurzelkriterium ist stärker: Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

In der Praxis ist das Quotientenkriterium oft bequemer, besonders bei \(n!\) oder Potenzen.

Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen.

Field-by-field Comparison

| Field |

Before |

After |

| Back |

<b>Wurzelkriterium</b> ist <b>stärker</b>: wenn Quotient anwendbar, liefert Wurzel mindestens genauso gutes Ergebnis.<br><br><b>Quotientenkriterium</b> einfacher bei Termen mit \(n!\) oder Potenzen.<br><br>Beide versagen für \(\rho = 1\) (z.B. \(p\)-Reihen).<br><br><b>Merke:</b> Wenn Quotient versagt (\(\rho=1\)), versagt auch Wurzel. |

Das <b>Wurzelkriterium ist stärker</b>: Liefert der Quotient ein Ergebnis, so auch die Wurzel - aber nicht umgekehrt.

<br><br>In der Praxis ist das <b>Quotientenkriterium</b> oft bequemer, besonders bei \(n!\) oder Potenzen.

<br><br>Beide versagen bei \(\rho = 1\), z.B. bei \(p\)-Reihen. |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 21: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: :{+=c#C^*:

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotient- und Wurzelkriterium versagen (\(\rho = 1\)) bei Reihen vom Typ p-Reihen \(\sum 1/n^s\).

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotient- und Wurzelkriterium versagen (\(\rho = 1\)) bei Reihen vom Typ p-Reihen \(\sum 1/n^s\).

In diesem Fall: Verdichtungssatz oder Grenzwertkriterium verwenden.

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotient- und Wurzelkriterium versagen bei Reihen vom Typ {{c1::\(\sum \frac{1}{n^s}\) (p-Reihen)}}, da aufeinanderfolgende Terme asymptotisch gleich schnell wachsen (\(\rho = 1\)).

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Quotient- und Wurzelkriterium versagen bei Reihen vom Typ {{c1::\(\sum \frac{1}{n^s}\) (p-Reihen)}}, da aufeinanderfolgende Terme asymptotisch gleich schnell wachsen (\(\rho = 1\)).

In diesem Fall: Verdichtungssatz oder Grenzwertkriterium verwenden.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Quotient- und Wurzelkriterium versagen (\(\rho = 1\)) bei Reihen vom Typ {{c1::p-Reihen \(\sum 1/n^s\)}}. |

Quotient- und Wurzelkriterium versagen bei Reihen vom Typ {{c1::\(\sum \frac{1}{n^s}\) (p-Reihen)}}, da aufeinanderfolgende Terme asymptotisch gleich schnell wachsen (\(\rho = 1\)). |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 22: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: =wRp[:z20n

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::4._Umordnung

Sei \(\sum a_n\) {{c1::bedingt konvergent und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.

Dann {{c2::gibt es eine Bijektion \(\phi\) so dass:

\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}}

Back

ETH::2._Semester::Analysis::3._Reihen::4._Umordnung

Sei \(\sum a_n\) {{c1::bedingt konvergent und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.

Dann {{c2::gibt es eine Bijektion \(\phi\) so dass:

\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}}

(Riemannscher Umordnungssatz für bedingt konvergente Reihen)

Merke: Bedingt konvergente Reihen können durch Umordnung jeden Grenzwert annehmen!

After

Front

ETH::2._Semester::Analysis::3._Reihen::4._Umordnung

Sei \(\sum a_n\) {{c1::bedingt konvergent und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.

Dann {{c2::gibt es eine Bijektion \(\phi\), so dass:

\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}}

Back

ETH::2._Semester::Analysis::3._Reihen::4._Umordnung

Sei \(\sum a_n\) {{c1::bedingt konvergent und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.

Dann {{c2::gibt es eine Bijektion \(\phi\), so dass:

\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}}

(Riemannscher Umordnungssatz für bedingt konvergente Reihen)

Merke: Bedingt konvergente Reihen können durch Umordnung jeden Grenzwert annehmen!

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Sei \(\sum a_n\) {{c1::<b>bedingt konvergent</b> und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.<br><br>Dann {{c2::gibt es eine Bijektion \(\phi\) so dass:<br>\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}} |

Sei \(\sum a_n\) {{c1::<b>bedingt konvergent</b> und \(L \in \mathbb{R} \cup \{+\infty, -\infty\}\)}}.<br><br>Dann {{c2::gibt es eine Bijektion \(\phi\), so dass:<br>\[\sum_{n=0}^\infty a_{\phi(n)} = L\]}} |

Tags:

ETH::2._Semester::Analysis::3._Reihen::4._Umordnung

Note 23: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Classic

GUID: @0zVayKX4N

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Kann eine Reihe konvergieren, ohne absolut zu konvergieren?

Back

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Kann eine Reihe konvergieren, ohne absolut zu konvergieren?

Ja — bedingte Konvergenz.

Beispiel: \(\sum \frac{(-1)^n}{n}\) konvergiert (Leibniz), aber \(\sum \frac{1}{n}\) divergiert.

Konsequenz: Bei bedingt konvergenten Reihen darf man nicht umordnen (Riemann'scher Umordnungssatz).

After

Front

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Kann eine Reihe konvergieren, ohne absolut zu konvergieren?

Back

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Kann eine Reihe konvergieren, ohne absolut zu konvergieren?

Ja, dies nennt man bedingte Konvergenz.

Beispiel: \(\sum \frac{(-1)^n}{n}\) konvergiert (Leibniz), aber \(\sum \frac{1}{n}\) divergiert.

Konsequenz: Bei bedingt konvergenten Reihen darf man nicht umordnen (Riemann'scher Umordnungssatz).

Field-by-field Comparison

| Field |

Before |

After |

| Back |

Ja — <b>bedingte Konvergenz</b>.<br><br>Beispiel: \(\sum \frac{(-1)^n}{n}\) konvergiert (Leibniz), aber \(\sum \frac{1}{n}\) divergiert.<br><br><b>Konsequenz:</b> Bei bedingt konvergenten Reihen darf man <b>nicht</b> umordnen (Riemann'scher Umordnungssatz). |

Ja, dies nennt man <b>bedingte Konvergenz</b>.<br><br>Beispiel: \(\sum \frac{(-1)^n}{n}\) konvergiert (Leibniz), aber \(\sum \frac{1}{n}\) divergiert.<br><br><b>Konsequenz:</b> Bei bedingt konvergenten Reihen darf man <b>nicht</b> umordnen (Riemann'scher Umordnungssatz). |

Tags:

ETH::2._Semester::Analysis::3._Reihen::1._Definitionen

Note 24: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: @U-YmkA@*:

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Verdichtungssatz: Sei \((a_n)\) monoton fallend, \(a_n \geq 0\):

\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]Proof Included

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Verdichtungssatz: Sei \((a_n)\) monoton fallend, \(a_n \geq 0\):

\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]Proof Included

Anwendung: \(\sum 1/n^s\) für \(s > 1\) konvergiert: \(\sum 2^n \cdot 2^{-ns} = \sum 2^{n(1-s)}\) geometrisch mit \(q = 2^{1-s} < 1\).

Proof

- Weil a_n monoton fällt gilt \(2^n a_{2^n} \ge a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}\).

- Wir benutzen das Majorantenkriterium mit\[\begin{align} \sum^n_{k = 0} 2^k a_{2^k} &\ge \sum_{k = 0}^n (a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}) \\ &= \sum^{2^n + 1}_{j = 1} a_j \\ &\ge \sum_{k = 0}^n 2^k a_{2^{k+1}} = \frac{1}{2} \sum_{k = 1}^{n + 1} 2^k a_{2^k} \end{align}\]

- Konvergiert \(\sum a_n\) konvergiert auch \((s_n)\) die Folge der Partialsummen und damit auch die Folge der Partialsummen \((s_{2^{n + 1} })\). Damit konvergiert auch die Folge der Partialsummen \((S_{n + 1})\), \(S_{n + 1} = \sum_{k = 1}^{n + 1} 2^k a_{2^k}\).

- Und dann konvergiert auch \(\sum^\infty 2^k a_{2^k}\) nach dem Majorantenkriterium.

After

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Verdichtungssatz:

Sei \((a_n)\) monoton fallend, \(a_n \geq 0\):

\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]Proof Included

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Verdichtungssatz:

Sei \((a_n)\) monoton fallend, \(a_n \geq 0\):

\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]Proof Included

Anwendung:

\(\sum 1/n^s\) für \(s > 1\) konvergiert: \(\sum 2^n \cdot 2^{-ns} = \sum 2^{n(1-s)}\) geometrisch mit \(q = 2^{1-s} < 1\).

Proof

- Weil \(a_n\) monoton fällt gilt \(2^n a_{2^n} \ge a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}\).

- Wir benutzen das Majorantenkriterium mit\[\begin{align} \sum^n_{k = 0} 2^k a_{2^k} &\ge \sum_{k = 0}^n (a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}) \\ &= \sum^{2^n + 1}_{j = 1} a_j \\ &\ge \sum_{k = 0}^n 2^k a_{2^{k+1}} = \frac{1}{2} \sum_{k = 1}^{n + 1} 2^k a_{2^k} \end{align}\]

- Konvergiert \(\sum a_n\) konvergiert auch \((s_n)\) die Folge der Partialsummen und damit auch die Folge der Partialsummen \((s_{2^{n + 1} })\). Damit konvergiert auch die Folge der Partialsummen \((S_{n + 1})\), \(S_{n + 1} = \sum_{k = 1}^{n + 1} 2^k a_{2^k}\).

- Und dann konvergiert auch \(\sum^\infty 2^k a_{2^k}\) nach dem Majorantenkriterium.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<b>Cauchy-Verdichtungssatz</b>: Sei \((a_n)\) <b>monoton fallend</b>, \(a_n \geq 0\):<br>\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]<i>Proof Included</i> |

<b>Cauchy-Verdichtungssatz</b>: <br>Sei \((a_n)\) <b>monoton fallend</b>, \(a_n \geq 0\):<br>\[\sum_{n=0}^\infty a_n \text{ conv.} \iff {{c1::\sum_{n=0}^\infty 2^n a_{2^n} \text{ conv.} }}\]<i>Proof Included</i> |

| Extra |

Anwendung: \(\sum 1/n^s\) für \(s > 1\) konvergiert: \(\sum 2^n \cdot 2^{-ns} = \sum 2^{n(1-s)}\) geometrisch mit \(q = 2^{1-s} < 1\).<br><br><div><strong>Proof</strong> </div>

<ul>

<li>Weil a_n monoton fällt gilt \(2^n a_{2^n} \ge a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}\).</li>

<li>Wir benutzen das Majorantenkriterium mit\[\begin{align} \sum^n_{k = 0} 2^k a_{2^k} &\ge \sum_{k = 0}^n (a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}) \\ &= \sum^{2^n + 1}_{j = 1} a_j \\ &\ge \sum_{k = 0}^n 2^k a_{2^{k+1}} = \frac{1}{2} \sum_{k = 1}^{n + 1} 2^k a_{2^k} \end{align}\]</li>

<li>Konvergiert \(\sum a_n\) konvergiert auch \((s_n)\) die Folge der Partialsummen und damit auch die Folge der Partialsummen \((s_{2^{n + 1} })\). Damit konvergiert auch die Folge der Partialsummen \((S_{n + 1})\), \(S_{n + 1} = \sum_{k = 1}^{n + 1} 2^k a_{2^k}\).</li>

<li>Und dann konvergiert auch \(\sum^\infty 2^k a_{2^k}\) nach dem Majorantenkriterium.</li></ul> |

Anwendung: <br>\(\sum 1/n^s\) für \(s > 1\) konvergiert: \(\sum 2^n \cdot 2^{-ns} = \sum 2^{n(1-s)}\) geometrisch mit \(q = 2^{1-s} < 1\).<br><br><div><strong>Proof</strong> </div>

<ul>

<li>Weil \(a_n\) monoton fällt gilt \(2^n a_{2^n} \ge a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}\).</li>

<li>Wir benutzen das Majorantenkriterium mit\[\begin{align} \sum^n_{k = 0} 2^k a_{2^k} &\ge \sum_{k = 0}^n (a_{2^k + 1} + a_{2^k + 2} + \dots + a_{2^{k + 1} - 1}) \\ &= \sum^{2^n + 1}_{j = 1} a_j \\ &\ge \sum_{k = 0}^n 2^k a_{2^{k+1}} = \frac{1}{2} \sum_{k = 1}^{n + 1} 2^k a_{2^k} \end{align}\]</li>

<li>Konvergiert \(\sum a_n\) konvergiert auch \((s_n)\) die Folge der Partialsummen und damit auch die Folge der Partialsummen \((s_{2^{n + 1} })\). Damit konvergiert auch die Folge der Partialsummen \((S_{n + 1})\), \(S_{n + 1} = \sum_{k = 1}^{n + 1} 2^k a_{2^k}\).</li>

<li>Und dann konvergiert auch \(\sum^\infty 2^k a_{2^k}\) nach dem Majorantenkriterium.</li></ul> |

Tags:

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Note 25: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: A5(n/HbG$,

modified

Before

Front

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::4._Komplexe_Zahlen::3._Eulersche_Formel

Argument ausrechnen:

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).

- \(\varphi = {{c3:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)

- \(\varphi = {{c2:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).

Back

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::4._Komplexe_Zahlen::3._Eulersche_Formel

Argument ausrechnen:

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).

- \(\varphi = {{c3:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)

- \(\varphi = {{c2:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).

Achtung: Bei der Umrechnung von Normal- in Polarform ist der Fall \(x=y=0\) ausgeschlossen.

After

Front

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::4._Komplexe_Zahlen::3._Eulersche_Formel

Argument ausrechnen:

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).

Back

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::4._Komplexe_Zahlen::3._Eulersche_Formel

Argument ausrechnen:

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)

- \(\varphi = {{c1:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).

Achtung: Bei der Umrechnung von Normal- in Polarform ist der Fall \(x=y=0\) ausgeschlossen.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<div>Argument ausrechnen:</div><ul>

<li>\(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).</li>

<li>\(\varphi = {{c3:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)</li>

<li>\(\varphi = {{c2:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).</li></ul> |

<div>Argument ausrechnen:</div><ul>

<li>\(\varphi = {{c1:: \arctan(\frac{y}{x}) }}\) falls \(x > 0\).</li>

<li>\(\varphi = {{c1:: \arctan(\frac{y}{x}) + \pi }}\) falls \(x < 0\) und \(y \ge 0\)</li>

<li>\(\varphi = {{c1:: \arctan(\frac{y}{x}) - \pi }}\) falls \(x < 0\) und \(y < 0\).</li></ul> |

Tags:

ETH::2._Semester::Analysis::1._Logik,_Mengen,_Zahlen::3._Zahlen::4._Komplexe_Zahlen::3._Eulersche_Formel

Note 26: ETH::2. Semester::Analysis

Deck: ETH::2. Semester::Analysis

Note Type: Horvath Cloze

GUID: B$gN}}gsw^

modified

Before

Front

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Kriterium:

\(\sum a_n\) konvergiert \(\iff\) für jedes \(\varepsilon > 0\) \(\exists N\) so dass für alle \(n > m > N\) gilt:

\[{{c1::\left|\sum_{k=m+1}^n a_k\right| = |S_n - S_m| < \varepsilon}}\]Proof Included

Back

ETH::2._Semester::Analysis::3._Reihen::3._Konvergenzkriterien

Cauchy-Kriterium:

\(\sum a_n\) konvergiert \(\iff\) für jedes \(\varepsilon > 0\) \(\exists N\) so dass für alle \(n > m > N\) gilt:

\[{{c1::\left|\sum_{k=m+1}^n a_k\right| = |S_n - S_m| < \varepsilon}}\]Proof Included

Direktes Cauchy-Kriterium auf die Partialsummenfolge.