Note 1: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: A-7$#*Ia_p

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch

\[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch

\[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\]

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch: \[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch: \[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\]

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

<br><br>

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch

\[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\] |

Seien \(A\) und \(B\) Ereignisse mit \(\Pr[B] > 0\).

<br><br>

Die bedingte Wahrscheinlichkeit \(\Pr[A|B]\) von \(A\) gegeben \(B\) ist definiert durch: \[\Pr[A|B] := {{c1::\frac{\Pr[A \cap B]}{\Pr[B]} }}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 2: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: B1cEOSgE

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):

- \(L_0 := \)unüberdeckte Knoten aus \(A\)

- Für ungerades \(i\): \(L_i := \){{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}

- Für gerades \(i\): \(L_i := \){{c3::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}

- Terminierung: sobald \(L_i\) einen unüberdeckten Knoten enthält → Pfad per Backtracking.

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):

- \(L_0 := \)unüberdeckte Knoten aus \(A\)

- Für ungerades \(i\): \(L_i := \){{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}

- Für gerades \(i\): \(L_i := \){{c3::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}

- Terminierung: sobald \(L_i\) einen unüberdeckten Knoten enthält → Pfad per Backtracking.

Laufzeit: \(O(|V| + |E|)\) für einen augmentierenden Pfad.

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):

- \(L_0 := \) unüberdeckte Knoten aus \(A\)

- Für ungerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}

- Für gerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}

- Terminierung: Sobald \(L_i\) einen unüberdeckten Knoten enthält → Pfad per Backtracking.

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):

- \(L_0 := \) unüberdeckte Knoten aus \(A\)

- Für ungerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}

- Für gerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}

- Terminierung: Sobald \(L_i\) einen unüberdeckten Knoten enthält → Pfad per Backtracking.

Laufzeit: \(O(|V| + |E|)\) für einen augmentierenden Pfad.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):<br><ol><li>\(L_0 := \){{c1::unüberdeckte Knoten aus \(A\)}}</li><li>Für ungerades \(i\): \(L_i := \){{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}</li><li>Für gerades \(i\): \(L_i := \){{c3::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}</li><li>Terminierung: {{c4::sobald \(L_i\) einen unüberdeckten Knoten enthält}} → Pfad per Backtracking.</li></ol> |

BFS für augmentierende Pfade in bipartiten Graphen \(G = (A \uplus B, E)\):<br><ol><li>\(L_0 := \) {{c1::unüberdeckte Knoten aus \(A\)}}</li><li>Für ungerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(E \setminus M\)}}</li><li>Für gerades \(i\): \(L_i := \) {{c2::unbesuchte Nachbarn von \(L_{i-1}\) via Kanten in \(M\)}}</li><li>Terminierung: {{c4::Sobald \(L_i\) einen unüberdeckten Knoten enthält}} → Pfad per Backtracking.</li></ol> |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Note 3: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: GDDu8@FRW=

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Die Grösse {{c1::\(\sigma := \sqrt{\operatorname{Var}[X]}\)}} heisst Standardabweichung von \(X\).

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Die Grösse {{c1::\(\sigma := \sqrt{\operatorname{Var}[X]}\)}} heisst Standardabweichung von \(X\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Die Grösse \(\sigma := {{c1::\sqrt{\operatorname{Var}[X]} }}\) heisst Standardabweichung von \(X\).

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Die Grösse \(\sigma := {{c1::\sqrt{\operatorname{Var}[X]} }}\) heisst Standardabweichung von \(X\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Die Grösse {{c1::\(\sigma := \sqrt{\operatorname{Var}[X]}\)}} heisst {{c2::Standardabweichung von \(X\)}}. |

Die Grösse \(\sigma := {{c1::\sqrt{\operatorname{Var}[X]} }}\) heisst {{c2::Standardabweichung von \(X\)}}. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Note 4: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: GTMcPtrK9g

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

mit Zurücklegen (Reihenfolge wichtig) ist:

\[n^k.\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

mit Zurücklegen (Reihenfolge wichtig) ist:

\[n^k.\]

Jede der \(k\) Positionen hat \(n\) Möglichkeiten.

Beispiel:

Wie viele 4-stellige PINs aus 0–9 (mit Wiederholung)?

\(10^4 = 10{,}000\).

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

mit Zurücklegen (Reihenfolge wichtig) ist:

\[n^k\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten

mit Zurücklegen (Reihenfolge wichtig) ist:

\[n^k\]

Jede der \(k\) Positionen hat \(n\) Möglichkeiten.

Beispiel:

Wie viele 4-stellige PINs aus 0–9 (mit Wiederholung)?

\(10^4 = 10{,}000\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten<br><strong>mit Zurücklegen</strong> (Reihenfolge wichtig) ist:<br>\[{{c1::n^k}}.\] |

Die Anzahl der geordneten Auswahlen von \(k\) aus \(n\) Objekten<br><strong>mit Zurücklegen</strong> (Reihenfolge wichtig) ist:<br>\[{{c1::n^k}}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 5: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: H#LoquJg]}

modified

Before

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gilt:

\(\binom{n}{k} = {{c1::\binom{n}{n-k} :: symmetrie }}\)

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gilt:

\(\binom{n}{k} = {{c1::\binom{n}{n-k} :: symmetrie }}\)

After

Front

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gilt:\[\binom{n}{k} = {{c1::\binom{n}{n-k} :: \text{Symmetrie} }}\]

Back

basic ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gilt:\[\binom{n}{k} = {{c1::\binom{n}{n-k} :: \text{Symmetrie} }}\]

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für den Binomialkoeffizienten gilt:<br>\(\binom{n}{k} = {{c1::\binom{n}{n-k} :: symmetrie }}\) |

Für den Binomialkoeffizienten gilt:\[\binom{n}{k} = {{c1::\binom{n}{n-k} :: \text{Symmetrie} }}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

basic

Note 6: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: HmM2`t+Bg|

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für Die Varianz gilt \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::summenform}}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für Die Varianz gilt \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::summenform}}\]

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für die Varianz gilt: \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::\text{Summe} }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für die Varianz gilt: \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::\text{Summe} }}\]

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für Die Varianz gilt \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::summenform}}\]<br> |

Für die Varianz gilt: \[\mathbb{E}[(X - \mu)^2] = {{c1::\sum_{x \in W_X} (x - \mu)^2 \cdot \Pr[X = x]::\text{Summe} }}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Note 7: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: Kxi,Zs1MD]

modified

Before

Front

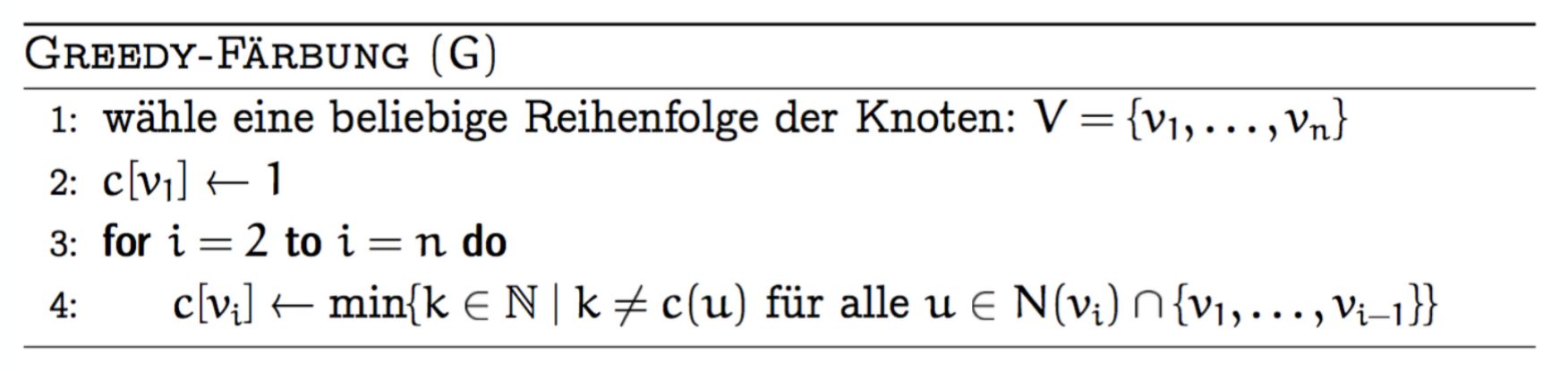

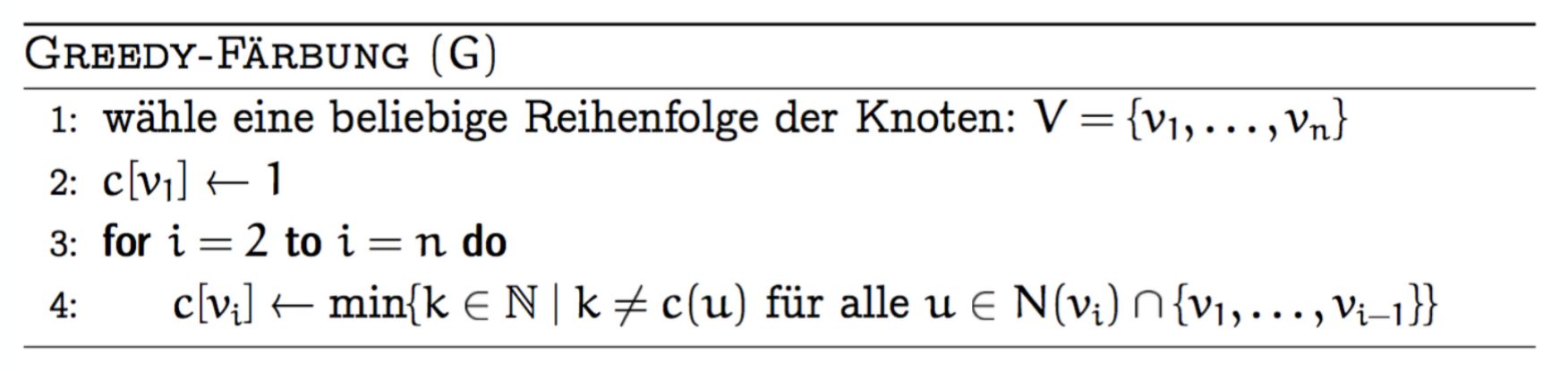

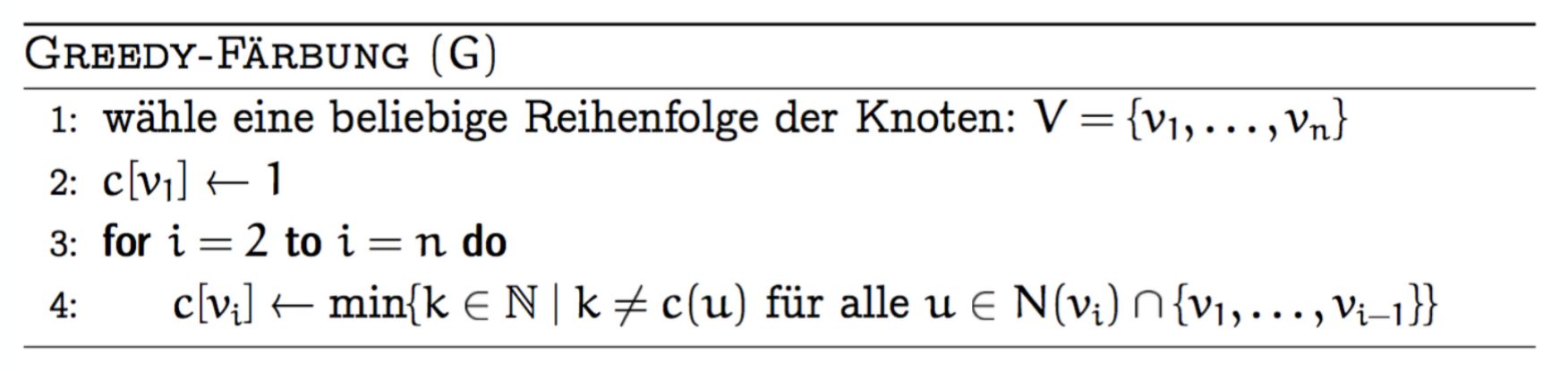

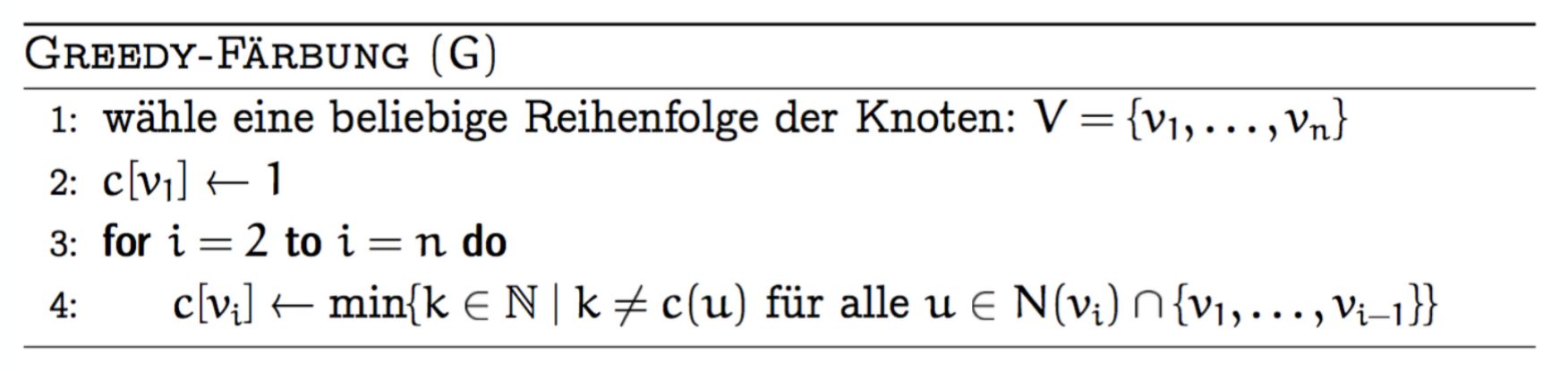

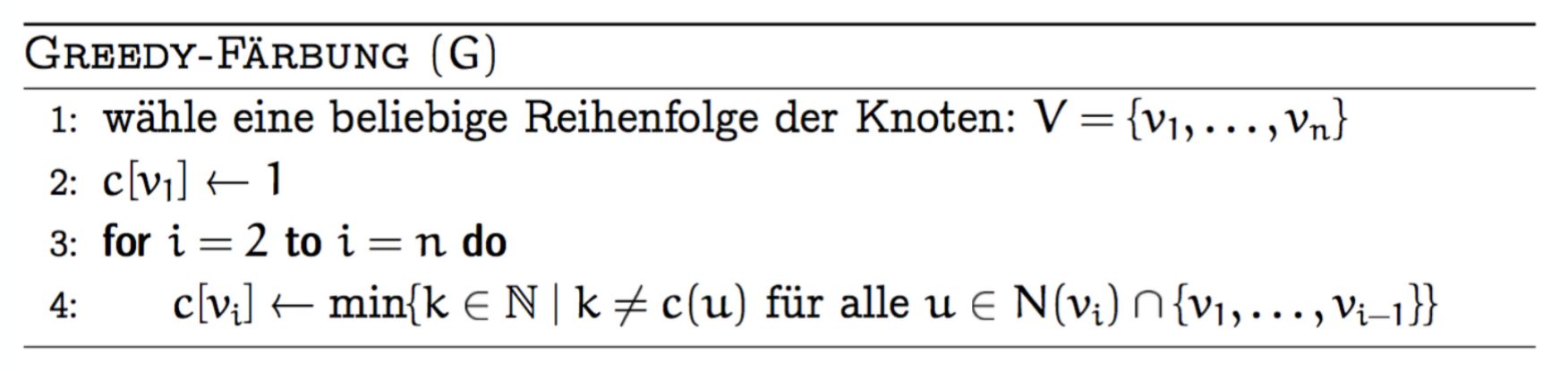

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

\(G \neq

K_n,\ G \neq {{c1::C_{2n+1} }},\ G\) zshgd.:

\(\Rightarrow\) \(G\) kann in Zeit \(O(|E|)\) mit \(\Delta(G)\) Farben gefärbt werden

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

\(G \neq

K_n,\ G \neq {{c1::C_{2n+1} }},\ G\) zshgd.:

\(\Rightarrow\) \(G\) kann in Zeit \(O(|E|)\) mit \(\Delta(G)\) Farben gefärbt werden

Satz von Brooks

\(K_n\) ist der vollständige Graph auf (n) Knoten - jeder Knoten ist mit jedem anderen verbunden. Er braucht \(n\) Farben.

\(C_{2n+1}\) ist ein Kreis mit einer ungeraden Anzahl von Knoten (z.B. Dreieck, Fünfeck, ...). Er braucht 3 Farben, obwohl \(\Delta = 2\).

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

\(G \neq

K_n,\ G \neq {{c1::C_{2n+1} }},\ G\) zshgd.:

\(\Rightarrow\) \(G\) kann in Zeit \(O(|E|)\) mit \(\Delta(G)\) Farben gefärbt werden

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

\(G \neq

K_n,\ G \neq {{c1::C_{2n+1} }},\ G\) zshgd.:

\(\Rightarrow\) \(G\) kann in Zeit \(O(|E|)\) mit \(\Delta(G)\) Farben gefärbt werden

Satz von Brooks

\(K_n\) ist der vollständige Graph auf \(n\) Knoten - jeder Knoten ist mit jedem anderen verbunden. Er braucht \(n\) Farben.

\(C_{2n+1}\) ist ein Kreis mit einer ungeraden Anzahl von Knoten (z.B. Dreieck, Fünfeck, ...). Er braucht 3 Farben, obwohl \(\Delta = 2\).

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

Satz von Brooks<br><br><div>\(K_n\) ist der vollständige Graph auf (n) Knoten - jeder Knoten ist mit jedem anderen verbunden. Er braucht \(n\) Farben.</div>

<div>\(C_{2n+1}\) ist ein Kreis mit einer ungeraden Anzahl von Knoten (z.B. Dreieck, Fünfeck, ...). Er braucht 3 Farben, obwohl \(\Delta = 2\).</div> |

Satz von Brooks<br><br><div>\(K_n\) ist der vollständige Graph auf \(n\) Knoten - jeder Knoten ist mit jedem anderen verbunden. Er braucht \(n\) Farben.</div>

<div>\(C_{2n+1}\) ist ein Kreis mit einer ungeraden Anzahl von Knoten (z.B. Dreieck, Fünfeck, ...). Er braucht 3 Farben, obwohl \(\Delta = 2\).</div> |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Note 8: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: LE!#OdHaHH

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Die Linearität der Erwartung hält wenn \(X_1,\ldots,X_n\) nicht unabhängig, du dummbatzi sind?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Die Linearität der Erwartung hält wenn \(X_1,\ldots,X_n\) nicht unabhängig, du dummbatzi sind?

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Die Linearität der Erwartung hält, wenn \(X_1,\ldots,X_n\) vollkommen wurscht ob unabhängig, du dummbatzi sind?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Die Linearität der Erwartung hält, wenn \(X_1,\ldots,X_n\) vollkommen wurscht ob unabhängig, du dummbatzi sind?

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Die Linearität der Erwartung hält wenn \(X_1,\ldots,X_n\) {{c1::nicht unabhängig, du dummbatzi}} sind? |

Die Linearität der Erwartung hält, wenn \(X_1,\ldots,X_n\) {{c1::vollkommen wurscht ob unabhängig, du dummbatzi}} sind? |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 9: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: P#e48Dok$?

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Paarweise Unabhängigkeit \(\not\Rightarrow\) aber \(\Leftarrow\) stochastische Unabhängigkeit!

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Paarweise Unabhängigkeit \(\not\Rightarrow\) aber \(\Leftarrow\) stochastische Unabhängigkeit!

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Paarweise Unabhängigkeit \(\Leftarrow\) Stochastische Unabhängigkeit

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Paarweise Unabhängigkeit \(\Leftarrow\) Stochastische Unabhängigkeit

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Paarweise Unabhängigkeit {{c1::\(\not\Rightarrow\) aber \(\Leftarrow\)}} stochastische Unabhängigkeit! |

Paarweise Unabhängigkeit {{c1::\(\Leftarrow\)::Implikationen in welche Richtungen?}} Stochastische Unabhängigkeit |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 10: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: P<77mx`t+b

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\]

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch: \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch: \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\]

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\] |

Für eine Zufallsvariable \(X\) mit \(\mu = \mathbb{E}[X]\) definieren wir die Varianz \(\operatorname{Var}[X]\) durch: \[\operatorname{Var}[X] := {{c1::\mathbb{E}[(X - \mu)^2]}}\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Note 11: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: PV7-/GzLwe

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Rekursion (Pascalsches Dreieck): \(\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\)

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Rekursion (Pascalsches Dreieck): \(\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Rekursionsformel des Pascalschen Dreiecks lautet: \[\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Die Rekursionsformel des Pascalschen Dreiecks lautet: \[\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\]

Intuition: Fixiere Element \(x\).

- \(x\) dabei → noch \(k-1\) aus \(n-1\) wählen

- \(x\) nicht dabei → alle \(k\) aus \(n-1\) wählen

Pascalsches Dreieck (Eintrag in Zeile \(n\)

, Position \(k\)

ist \(\binom{n}{k}\)

):\[\begin{array}{ccccccccc} & & & & 1 \\ & & & 1 & & 1 \\ & & 1 & & 2 & & 1 \\ & 1 & & 3 & & 3 & & 1 \\ 1 & & 4 & & 6 & & 4 & & 1 \end{array}\]Jeder Eintrag = Summe der zwei Einträge schräg darüber.

Z.B.: \(\binom{4}{2} = 6 = \underbrace{\binom{3}{1}}_{3} + \underbrace{\binom{3}{2}}_{3}\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Rekursion (Pascalsches Dreieck): \(\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\) |

Die Rekursionsformel des Pascalschen Dreiecks lautet: \[\binom{n}{k} = {{c3::\binom{n-1}{k-1} + \binom{n-1}{k} }}\] |

| Extra |

|

<b>Intuition:</b> <br>Fixiere Element \(x\).<br><ul><li>\(x\) dabei → noch \(k-1\) aus \(n-1\) wählen</li><li>\(x\) nicht dabei → alle \(k\) aus \(n-1\) wählen</li></ul><b>Pascalsches Dreieck (Eintrag in Zeile </b>\(n\)<b>, Position </b>\(k\)<b> ist </b>\(\binom{n}{k}\)<b>):</b><br>\[\begin{array}{ccccccccc} & & & & 1 \\ & & & 1 & & 1 \\ & & 1 & & 2 & & 1 \\ & 1 & & 3 & & 3 & & 1 \\ 1 & & 4 & & 6 & & 4 & & 1 \end{array}\]Jeder Eintrag = Summe der zwei Einträge schräg darüber.<br>Z.B.: \(\binom{4}{2} = 6 = \underbrace{\binom{3}{1}}_{3} + \underbrace{\binom{3}{2}}_{3}\) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Note 12: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: Pp@EGP+L[^

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Hopcroft-Karp findet in einem bipartiten Graphen in {{c1::\(O(\sqrt{|V|} \cdot |E|)\)}} ein maximales Matching.

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Hopcroft-Karp findet in einem bipartiten Graphen in {{c1::\(O(\sqrt{|V|} \cdot |E|)\)}} ein maximales Matching.

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Hopcroft-Karp findet in einem bipartiten Graphen in \(O({{c2::\sqrt{|V|} \cdot |E|}})\) ein maximales Matching.

Back

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Hopcroft-Karp findet in einem bipartiten Graphen in \(O({{c2::\sqrt{|V|} \cdot |E|}})\) ein maximales Matching.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Hopcroft-Karp findet in einem {{c1::<b>bipartiten Graphen</b>}} in {{c1::\(O(\sqrt{|V|} \cdot |E|)\)}} ein {{c1::maximales Matching}}. |

Hopcroft-Karp findet in einem {{c1::<b>bipartiten</b>}}<b> Graphen</b> in \(O({{c2::\sqrt{|V|} \cdot |E|}})\) ein {{c3::maximales Matching}}. |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::6._Matchings::1._Algorithmen

Note 13: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: Q@0nZt+]Z(

modified

Before

Front

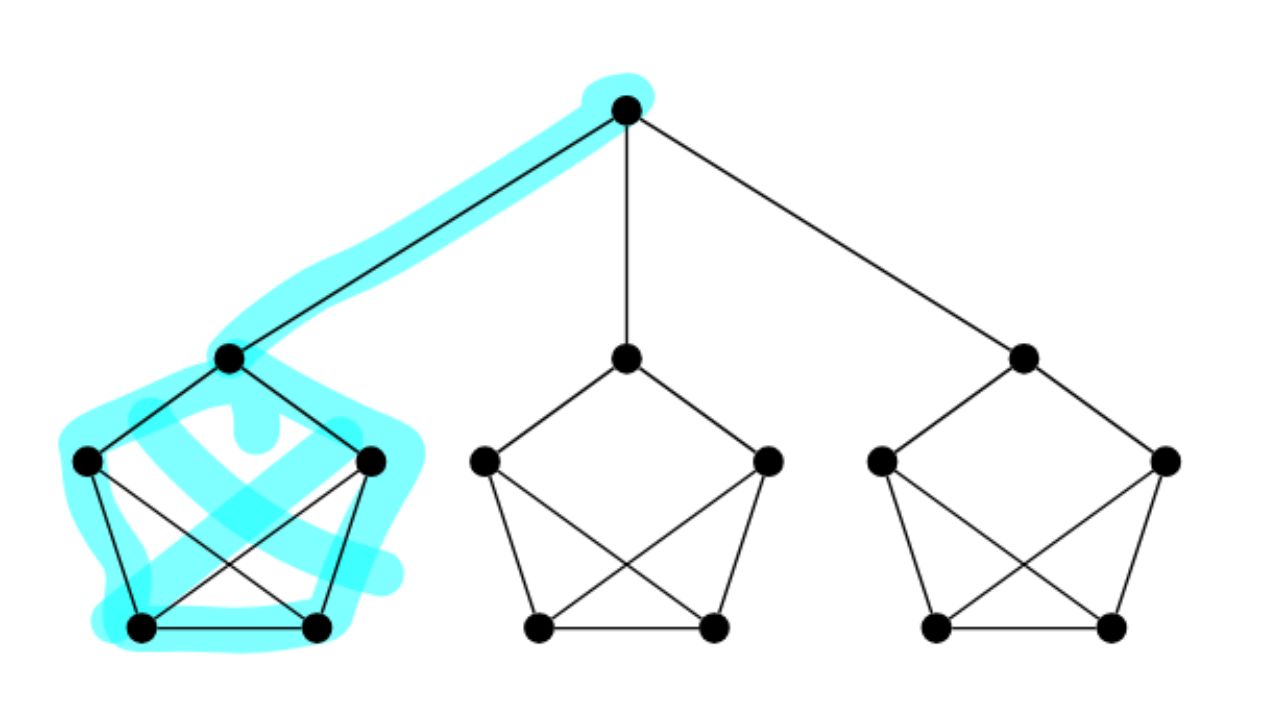

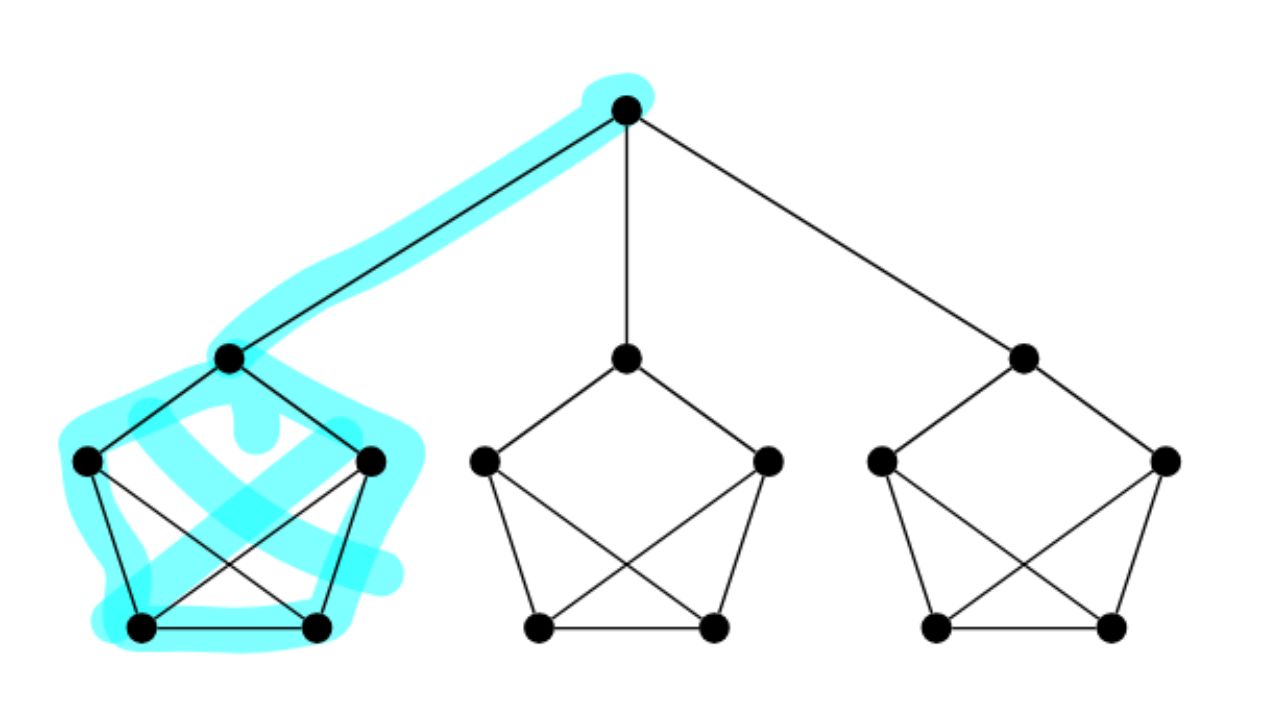

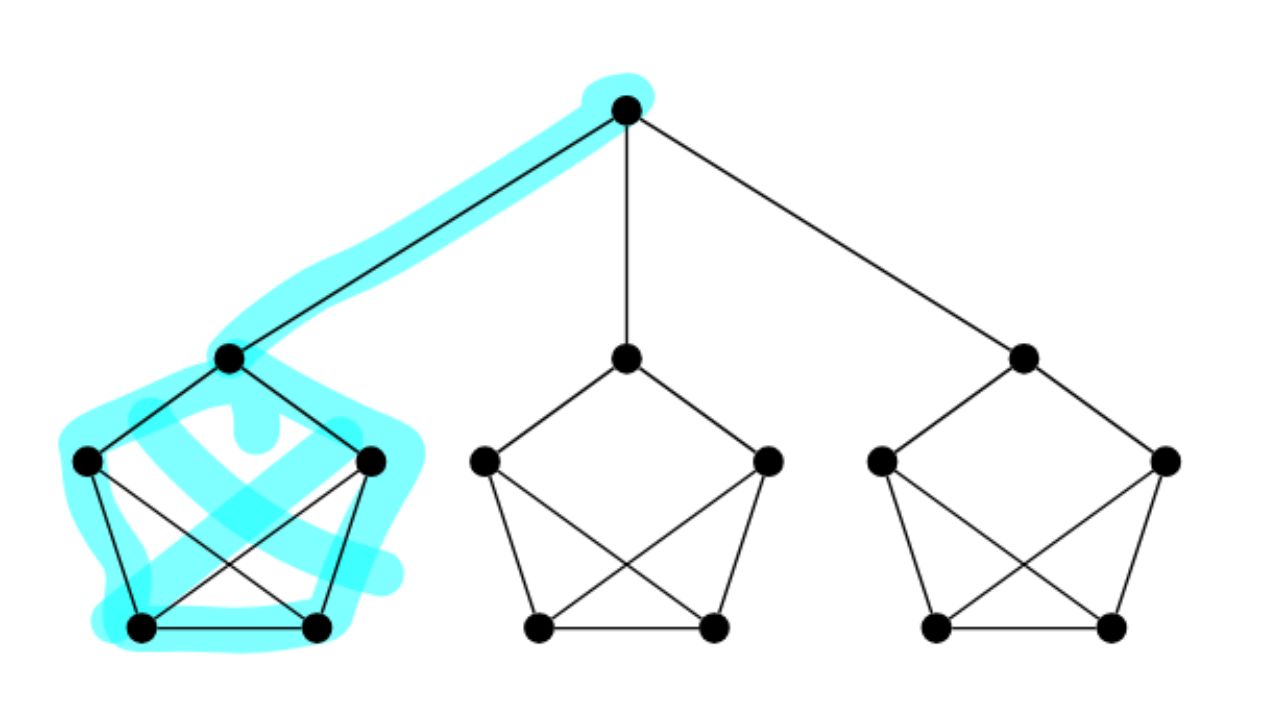

Für alle \( k \) gilt: jeder \( k \)-reguläre Graph enthält du dumme nuss, das gilt nur für bipartite.

Back

Für alle \( k \) gilt: jeder \( k \)-reguläre Graph enthält du dumme nuss, das gilt nur für bipartite.

Counterexample:

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::5._Kreise::3._Spezialfälle

Für alle \( k \) gilt: jeder \( k \)-reguläre Graph enthält du dumme nuss, das gilt nur für bipartite.

Back

ETH::2._Semester::A&W::1._Graphentheorie::5._Kreise::3._Spezialfälle

Für alle \( k \) gilt: jeder \( k \)-reguläre Graph enthält du dumme nuss, das gilt nur für bipartite.

(Kein perfektes Matching)

Counterexample:

Field-by-field Comparison

| Field |

Before |

After |

| Extra |

Counterexample:<br><img src="paste-193a551c914a2a5dbdcd979b38301cf09f2dbf89.jpg"> |

(Kein perfektes Matching)<br><br>Counterexample:<br><img src="paste-193a551c914a2a5dbdcd979b38301cf09f2dbf89.jpg"> |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::5._Kreise::3._Spezialfälle

Note 14: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: XQ3mqcUc7W

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.

\(\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\)

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.

\(\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\)

Zufallsvariablen abstrahieren Ergebnisse zu numerischen Werten.

Beispiel:

Bei 2 Würfelwürfen ist \(X =\) "Summe der Augenzahlen" eine Zufallsvariable.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.\[\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.\[\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\]

Zufallsvariablen abstrahieren Ergebnisse zu numerischen Werten.

Beispiel:

Bei 2 Würfelwürfen ist \(X =\) "Summe der Augenzahlen" eine Zufallsvariable.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.<br><br>\(\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\) |

Eine Zufallsvariable auf \(\Omega\) ist {{c1::eine Funktion \(X\colon \Omega \to \mathbb{R}\)}}.\[\Pr[X = x] := {{c2::\Pr[\{\omega \in \Omega : X(\omega) = x\}]}}.\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::1._Definitionen

Note 15: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: bn:Zftw53>

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Let \(X\) = number of flips until first heads with \(\Pr[\text{heads}] = p\). What method do we use in a memoryless problem like this?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Let \(X\) = number of flips until first heads with \(\Pr[\text{heads}] = p\). What method do we use in a memoryless problem like this?

Define \(K_1\) = "first flip is heads." Apply total expectation conditioned on \(K_1\): -

- \(\mathbb{E}[X \mid K_1] = 1\) (done immediately)

- \(\mathbb{E}[X \mid \bar{K}_1] = 1 + \mathbb{E}[X]\) (memoryless: after tails, the process restarts identically, plus the one spent flip)

Plugging into \(\mathbb{E}[X] = 1 \cdot p + (1 + \mathbb{E}[X])(1-p)\) and solving yields \(\mathbb{E}[X] = 1/p\). Avoids computing \(\sum k \cdot (1-p)^{k-1} p\) directly.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Sei \(X=\) Anzahl Würfe bis zum ersten Kopf mit \(\Pr[\text{Kopf}] = p\).

Welche Methode verwenden wir bei einem gedächtnislosen Problem wie diesem?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Sei \(X=\) Anzahl Würfe bis zum ersten Kopf mit \(\Pr[\text{Kopf}] = p\).

Welche Methode verwenden wir bei einem gedächtnislosen Problem wie diesem?

Definiere \(K_1\) = "erster Wurf ist Kopf." Wende totale Erwartung bedingt auf \(K_1\) an:

- \(\mathbb{E}[X \mid K_1] = 1\) (sofort fertig)

- \(\mathbb{E}[X \mid \overline{K}_1] = 1 + \mathbb{E}[X]\) (gedächtnislos: nach Zahl startet der Prozess identisch neu, plus der eine verbrauchte Wurf)

Einsetzen in \(\mathbb{E}[X] = 1 \cdot p + (1 + \mathbb{E}[X])(1-p)\) und Auflösen ergibt \(\mathbb{E}[X] = 1/p\). Vermeidet die direkte Berechnung von \(\sum k \cdot (1-p)^{k-1} p\).

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Let \(X\) = number of flips until first heads with \(\Pr[\text{heads}] = p\). What method do we use in a <i>memoryless</i> problem like this? |

Sei \(X=\) Anzahl Würfe bis zum ersten Kopf mit \(\Pr[\text{Kopf}] = p\). <br><br>Welche Methode verwenden wir bei einem <i>gedächtnislosen</i> Problem wie diesem? |

| Back |

Define \(K_1\) = "first flip is heads." Apply total expectation conditioned on \(K_1\): - <br><ul><li>\(\mathbb{E}[X \mid K_1] = 1\) (done immediately) </li><li>\(\mathbb{E}[X \mid \bar{K}_1] = 1 + \mathbb{E}[X]\) (memoryless: after tails, the process restarts identically, plus the one spent flip) </li></ul>Plugging into \(\mathbb{E}[X] = 1 \cdot p + (1 + \mathbb{E}[X])(1-p)\) and solving yields \(\mathbb{E}[X] = 1/p\). Avoids computing \(\sum k \cdot (1-p)^{k-1} p\) directly. |

Definiere \(K_1\) = "erster Wurf ist Kopf." Wende totale Erwartung bedingt auf \(K_1\) an:<br><ul><li>\(\mathbb{E}[X \mid K_1] = 1\) (sofort fertig)</li><li>\(\mathbb{E}[X \mid \overline{K}_1] = 1 + \mathbb{E}[X]\) (gedächtnislos: nach Zahl startet der Prozess identisch neu, plus der eine verbrauchte Wurf)</li></ul>Einsetzen in \(\mathbb{E}[X] = 1 \cdot p + (1 + \mathbb{E}[X])(1-p)\) und Auflösen ergibt \(\mathbb{E}[X] = 1/p\). Vermeidet die direkte Berechnung von \(\sum k \cdot (1-p)^{k-1} p\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 16: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: gUmycq$(t=

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Boolsche Ungleichung: Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Boolsche Ungleichung: Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\]

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\]

(Boolsche Ungleichung)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

<b>Boolsche Ungleichung: </b>Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\] |

Für Ereignisse \(A_1, \ldots, A_n\) gilt\[\Pr\left[\bigcup_{i=1}^{n} A_i\right] \leq {{c1::\sum_{i=1}^{n} \Pr[A_i]}}.\] |

| Extra |

|

(Boolsche Ungleichung) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::1._Grundbegriffe_und_Notationen

Note 17: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: gY|BFj@/!$

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]Proof Included

Beweis- \(\operatorname{Var}[X + b] = \mathbb{E}[(X + b - \mathbb{E}[X + b])^2]\) \(= \mathbb{E}[(X - \mathbb{E}[X])^2]\) \(= \operatorname{Var}[X]\)

- Mit Hilfe von \(\text{Var}[X] = \mathbb{E}[X^2] - \mathbb{E}[X]^2\) erhalten wir \(\operatorname{Var}[a \cdot X] = \mathbb{E}[(aX)^2] - \mathbb{E}[aX]^2\) \(= a^2 \mathbb{E}[X^2] - (a\mathbb{E}[X])^2 = a^2 \cdot \operatorname{Var}[X]\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt: \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt: \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]Proof Included

Beweis:

\(\operatorname{Var}[X + b] = \mathbb{E}[(X + b - \mathbb{E}[X + b])^2]\) \(= \mathbb{E}[(X - \mathbb{E}[X])^2]\) \(= \operatorname{Var}[X]\)

Mit Hilfe von \(\text{Var}[X] = \mathbb{E}[X^2] - \mathbb{E}[X]^2\) erhalten wir \(\operatorname{Var}[a \cdot X] = \mathbb{E}[(aX)^2] - \mathbb{E}[aX]^2\) \(= a^2 \mathbb{E}[X^2] - (a\mathbb{E}[X])^2 = a^2 \cdot \operatorname{Var}[X]\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]<i>Proof Included</i> |

Für eine beliebige Zufallsvariable \(X\) und \(a, b \in \mathbb{R}\) gilt: \[\operatorname{Var}[a \cdot X + b] = {{c1::a^2 \cdot \operatorname{Var}[X]}}\]<i>Proof Included</i> |

| Extra |

<b>Beweis</b><br><ul><li>\(\operatorname{Var}[X + b] = \mathbb{E}[(X + b - \mathbb{E}[X + b])^2]\) \(= \mathbb{E}[(X - \mathbb{E}[X])^2]\) \(= \operatorname{Var}[X]\) </li><li>Mit Hilfe von \(\text{Var}[X] = \mathbb{E}[X^2] - \mathbb{E}[X]^2\) erhalten wir \(\operatorname{Var}[a \cdot X] = \mathbb{E}[(aX)^2] - \mathbb{E}[aX]^2\) \(= a^2 \mathbb{E}[X^2] - (a\mathbb{E}[X])^2 = a^2 \cdot \operatorname{Var}[X]\)</li></ul> |

<b>Beweis:</b><br>\(\operatorname{Var}[X + b] = \mathbb{E}[(X + b - \mathbb{E}[X + b])^2]\) \(= \mathbb{E}[(X - \mathbb{E}[X])^2]\) \(= \operatorname{Var}[X]\) <br>Mit Hilfe von \(\text{Var}[X] = \mathbb{E}[X^2] - \mathbb{E}[X]^2\) erhalten wir \(\operatorname{Var}[a \cdot X] = \mathbb{E}[(aX)^2] - \mathbb{E}[aX]^2\) \(= a^2 \mathbb{E}[X^2] - (a\mathbb{E}[X])^2 = a^2 \cdot \operatorname{Var}[X]\) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::3._Varianz

Note 18: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: jc@5=H8@[9

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\]

(Satz von Bayes)

Es folgt direkt: \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B\mid A]\cdot\Pr[A]}{\Pr[B]}\).

Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):

\(\Pr[A_i\mid B] = \frac{\Pr[B\mid A_i]\Pr[A_i]}{\sum_j \Pr[B\mid A_j]\Pr[A_j]}\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]}::\text{Bayes} }}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\).

Dann gilt:

\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]}::\text{Bayes} }}.\]

(Satz von Bayes)

Es folgt direkt: \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]} = \frac{\Pr[B\mid A]\cdot\Pr[A]}{\Pr[B]}\).

Verallgemeinerung (Partition \(A_1,\ldots,A_n\)):

\(\Pr[A_i\mid B] = \frac{\Pr[B\mid A_i]\Pr[A_i]}{\sum_j \Pr[B\mid A_j]\Pr[A_j]}\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). <br>Dann gilt:<br>\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]} }}.\] |

Seien \(A, B\) Ereignisse mit \(\Pr[B] > 0\). <br>Dann gilt:<br>\[\Pr[A\mid B] = {{c1::\frac{\Pr[B\mid A] \cdot \Pr[A]}{\Pr[B]}::\text{Bayes} }}.\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 19: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: n.e@Tr+tLx

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Falls \(\Pr[B] > 0\) ist stochastische Unabhängigkeit \(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\) ident mit \(\Pr[A|B] = \Pr[A]\) (Bayes).

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Falls \(\Pr[B] > 0\) ist stochastische Unabhängigkeit \(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\) ident mit \(\Pr[A|B] = \Pr[A]\) (Bayes).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Stochastische Unabhängigkeit hat zwei äquivalente Formulierungen (falls \(\Pr[B] > 0\)):

- \(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\)

- \(\Pr[A\mid B] = \Pr[A]\)

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Stochastische Unabhängigkeit hat zwei äquivalente Formulierungen (falls \(\Pr[B] > 0\)):

- \(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\)

- \(\Pr[A\mid B] = \Pr[A]\)

Beweis:

Setze 1. in \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]}\) ein, dann kürzt sich \(\Pr[B]\) weg.

Intuition:

Das Eintreten von \(B\) beeinflusst die Wahrscheinlichkeit von \(A\) nicht.

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Falls \(\Pr[B] > 0\) ist stochastische Unabhängigkeit \(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\) ident mit {{c1:: \(\Pr[A|B] = \Pr[A]\) (Bayes)}}. |

Stochastische Unabhängigkeit hat zwei äquivalente Formulierungen (falls \(\Pr[B] > 0\)):<br><ol><li>\(\Pr[A \cap B] = \Pr[A] \cdot \Pr[B]\)</li><li>{{c1::\(\Pr[A\mid B] = \Pr[A]\)}}</li></ol> |

| Extra |

|

<b>Beweis:</b> <br>Setze 1. in \(\Pr[A\mid B] = \frac{\Pr[A \cap B]}{\Pr[B]}\) ein, dann kürzt sich \(\Pr[B]\) weg.<br><br>Intuition: <br>Das Eintreten von \(B\) beeinflusst die Wahrscheinlichkeit von \(A\) nicht. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 20: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: o78LP-Mw-W

modified

Before

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

(Mycielski-Konstruktion)

Konstruktion:

Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):

Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.

Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\).

After

Front

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

Back

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Für alle \(k \geq 2\) gibt es einen dreiecksfreien Graphen \(G_k\) mit \(\chi(G_k) \geq k\).

(Mycielski-Konstruktion)

Konstruktion:

Aus \(G_k = (V_k, E_k)\) mit \(V_k = \{v_1,\ldots,v_n\}\) bilde \(G_{k+1}\):

Füge Knoten \(w_1,\ldots,w_n, z\) hinzu. \(w_i\) ist mit allen Nachbarn von \(v_i\) verbunden (aber nicht mit \(v_i\) selbst). \(z\) ist mit allen \(w_i\) verbunden.

Der neue Graph ist dreiecksfrei und braucht eine Farbe mehr als \(G_k\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für alle \(k \geq 2\) gibt es einen {{c1::dreiecksfreien}} Graphen \(G_k\) mit \(\chi(G_k) \geq {{c2::k}}\). |

Für alle \(k \geq 2\) gibt es einen {{c1::dreiecksfreien}} Graphen \(G_k\) mit \(\chi(G_k) \geq k\). |

Tags:

ETH::2._Semester::A&W::1._Graphentheorie::7._Färbungen

Note 21: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: qsXztu}x3_

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1, \ldots, A_n\) heißen stochastisch unabhängig,

falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:

\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1, \ldots, A_n\) heißen stochastisch unabhängig,

falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:

\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\]

Achtung:

Paarweise Unabhängigkeit (\(\Pr[A_i \cap A_j] = \Pr[A_i]\Pr[A_j]\) für alle \(i \neq j\)) impliziert NICHT stochastische Unabhängigkeit!

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1, \ldots, A_n\) heissen stochastisch unabhängig, falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:

\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\]

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Ereignisse \(A_1, \ldots, A_n\) heissen stochastisch unabhängig, falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:

\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\]

Achtung:

Paarweise Unabhängigkeit (\(\Pr[A_i \cap A_j] = \Pr[A_i]\Pr[A_j]\) für alle \(i \neq j\)) impliziert NICHT stochastische Unabhängigkeit!

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Ereignisse \(A_1, \ldots, A_n\) heißen stochastisch unabhängig,<br>falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:<br>\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\] |

Ereignisse \(A_1, \ldots, A_n\) heissen stochastisch unabhängig, falls für alle nichtleeren \(I \subseteq \{1,\ldots,n\}\) gilt:<br>\[{{c2::\Pr\!\left[\bigcap_{i \in I} A_i\right] = \prod_{i \in I} \Pr[A_i]}}.\] |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 22: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: s7OsezhA)h

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gelten:

Randfälle: \(\binom{n}{0} = 1\), \(\binom{n}{n} = 1\), \(\binom{n}{1} = n\)

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gelten:

Randfälle: \(\binom{n}{0} = 1\), \(\binom{n}{n} = 1\), \(\binom{n}{1} = n\)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gelten:

- \(\binom{n}{0} = 1\)

- \(\binom{n}{n} = 1\)

- \(\binom{n}{1} = n\)

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Für den Binomialkoeffizienten gelten:

- \(\binom{n}{0} = 1\)

- \(\binom{n}{n} = 1\)

- \(\binom{n}{1} = n\)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für den Binomialkoeffizienten gelten:<br>Randfälle: \(\binom{n}{0} = {{c2::1}}\), \(\binom{n}{n} = {{c2::1}}\), \(\binom{n}{1} = {{c2::n}}\) |

Für den Binomialkoeffizienten gelten:<br><ol><li>\(\binom{n}{0} = {{c1::1}}\)</li><li>\(\binom{n}{n} = {{c2::1}}\)</li><li>\(\binom{n}{1} = {{c3::n}}\)</li></ol> |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::0._Kombinatorik

Note 23: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_35dcd411

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]Proof Included

(Erwartungswert als Summe)

Proof:

\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]

(Summationsreihenfolge vertauschen: nach \(\omega\) gruppieren statt nach Wert \(x\).)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{Summe} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für jede Zufallsvariable \(X\):

\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{Summe} }} \]Proof Included

(Erwartungswert als Summe)

Proof:

\[\begin{align} \mathbb{E}[X] &= \sum_{x\in W_X}x\cdot\Pr[X=x] \\ &=\sum_{x\in W_X}x\cdot\sum_{\omega: X(\omega)=x}\Pr[\omega] \\&=\sum_{\omega\in\Omega}X(\omega)\cdot\Pr[\omega].\quad \end{align}\]

(Summationsreihenfolge vertauschen: nach \(\omega\) gruppieren statt nach Wert \(x\).)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für jede Zufallsvariable \(X\):<br>\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{gewichtete Summe} }} \]<em>Proof Included</em> |

Für jede Zufallsvariable \(X\):<br>\[ \mathbb{E}[X] = {{c1::\sum_{\omega\in\Omega} X(\omega)\cdot\Pr[\omega]::\text{Summe} }} \]<em>Proof Included</em> |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 24: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_38dbfe49

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

(Erwartungswert)

Proof:\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\) gilt:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\) gilt:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]Proof Included

Proof:\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.)

Field-by-field Comparison

| Field |

Before |

After |

| Text |

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\):\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]<em>Proof Included</em> |

Für eine Zufallsvariable \(X\) mit \(W_X\subseteq\mathbb{N}_0\) gilt:\[ \mathbb{E}[X] = {{c1::\sum_{i=1}^{\infty}\Pr[X\ge i] :: \text{Schrankenform} }} \]<em>Proof Included</em> |

| Extra |

(Erwartungswert)<br><br><b>Proof:</b>\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.) |

<b>Proof:</b>\[ \mathbb{E}[X]=\sum_{i=0}^{\infty}i\cdot\Pr[X=i]=\sum_{i=0}^{\infty}\sum_{j=1}^{i}\Pr[X=i]=\sum_{j=1}^{\infty}\sum_{i=j}^{\infty}\Pr[X=i]=\sum_{j=1}^{\infty}\Pr[X\ge j].\quad\square \](Der Schlüsselschritt ist das Vertauschen der Summationsreihenfolge: Statt über \(i\) zu summieren und für jedes \(j\le i\) eine 1 zu zählen, wird über \(j\) summiert und alle \(i\ge j\) gezählt.) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 25: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_59b0d013

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Give an example of three events that are pairwise independent but not mutually independent.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Give an example of three events that are pairwise independent but not mutually independent.

Flip two fair coins \(M_1, M_2\). Define:

\(A\) = "\(M_1\) shows heads"

\(B\) = "\(M_2\) shows heads"

\(C\) = "the results differ" = \(\{(K,Z),(Z,K)\}\)

Then \(A\) and \(B\), \(B\) and \(C\), \(A\) and \(C\) are pairwise independent (each pair: \(\Pr[X\cap Y]=1/4=1/2\cdot1/2\)).

But:

\[ \Pr[A\cap B\cap C] = 0 \neq \tfrac{1}{8} = \Pr[A]\Pr[B]\Pr[C]. \]

Because if both \(A\) and \(B\) occur (both heads), then \(C\) (results differ) cannot occur.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Gib ein Beispiel für drei Ereignisse, die paarweise unabhängig, aber nicht gemeinsam unabhängig sind.

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Gib ein Beispiel für drei Ereignisse, die paarweise unabhängig, aber nicht gemeinsam unabhängig sind.

Wirf zwei faire Münzen \(M_1, M_2\).

Definiere:

\(A\) = "\(M_1\) zeigt Kopf"

\(B\) = "\(M_2\) zeigt Kopf"

\(C\) = "die Ergebnisse unterscheiden sich" = \(\{(K,Z),(Z,K)\}\)

Dann sind \(A\) und \(B\), \(B\) und \(C\), \(A\) und \(C\) paarweise unabhängig (jedes Paar: \(\Pr[X\cap Y]=1/4=1/2\cdot1/2\)).

Aber:\[\Pr[A\cap B\cap C] = 0 \neq \tfrac{1}{8} = \Pr[A]\Pr[B]\Pr[C].\]Denn falls sowohl \(A\) als auch \(B\) eintreten (beide Kopf), kann \(C\) (Ergebnisse unterscheiden sich) nicht eintreten.

Field-by-field Comparison

| Field |

Before |

After |

| Front |

Give an example of three events that are <strong>pairwise independent</strong> but <strong>not mutually independent</strong>. |

Gib ein Beispiel für drei Ereignisse, die paarweise unabhängig, aber nicht gemeinsam unabhängig sind. |

| Back |

Flip two fair coins \(M_1, M_2\). Define:<br>\(A\) = "\(M_1\) shows heads"<br>\(B\) = "\(M_2\) shows heads"<br>\(C\) = "the results differ" = \(\{(K,Z),(Z,K)\}\)<br><br>Then \(A\) and \(B\), \(B\) and \(C\), \(A\) and \(C\) are pairwise independent (each pair: \(\Pr[X\cap Y]=1/4=1/2\cdot1/2\)).<br><br>But:<br>\[ \Pr[A\cap B\cap C] = 0 \neq \tfrac{1}{8} = \Pr[A]\Pr[B]\Pr[C]. \]<br><br>Because if both \(A\) and \(B\) occur (both heads), then \(C\) (results differ) cannot occur. |

Wirf zwei faire Münzen \(M_1, M_2\). <br><br>Definiere:<br>\(A\) = "\(M_1\) zeigt Kopf"<br>\(B\) = "\(M_2\) zeigt Kopf"<br>\(C\) = "die Ergebnisse unterscheiden sich" = \(\{(K,Z),(Z,K)\}\)<br><br>Dann sind \(A\) und \(B\), \(B\) und \(C\), \(A\) und \(C\) paarweise unabhängig (jedes Paar: \(\Pr[X\cap Y]=1/4=1/2\cdot1/2\)).<br><br>Aber:\[\Pr[A\cap B\cap C] = 0 \neq \tfrac{1}{8} = \Pr[A]\Pr[B]\Pr[C].\]Denn falls sowohl \(A\) als auch \(B\) eintreten (beide Kopf), kann \(C\) (Ergebnisse unterscheiden sich) nicht eintreten. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Note 26: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_59ff89ba

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

When is the expected value \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) undefined ?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

When is the expected value \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) undefined ?

The expected value is only defined if the sum converges absolutely, i.e., \(\sum_{x\in W_X}|x|\cdot\Pr[X=x]<\infty\).

If the sum does not converge absolutely (e.g., the positive and negative parts both diverge), \(\mathbb{E}[X]\) is undefined.

For finite probability spaces this is always satisfied (finitely many terms). For infinite spaces, care is needed.

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Wann ist der Erwartungswert \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) undefiniert?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Wann ist der Erwartungswert \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) undefiniert?

Falls die Summe nicht absolut konvergiert (z.B. positiver und negativer Anteil beide divergieren).

Der Erwartungswert ist nur definiert, wenn die Summe absolut konvergiert, d.h. \(\sum_{x\in W_X}|x|\cdot\Pr[X=x]<\infty\).

In endlichen Wahrscheinlichkeitsräumen ist dies immer erfüllt (endlich viele Terme). Bei unendlichen Räumen muss man aufpassen.

Field-by-field Comparison

| Field |

Before |

After |

| Front |

When is the expected value \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) <strong>undefined</strong> ? |

Wann ist der Erwartungswert \(\mathbb{E}[X] = \sum_{x\in W_X} x\cdot\Pr[X=x]\) undefiniert? |

| Back |

The expected value is only defined if the sum <strong>converges absolutely</strong>, i.e., \(\sum_{x\in W_X}|x|\cdot\Pr[X=x]<\infty\).<br><br>If the sum does not converge absolutely (e.g., the positive and negative parts both diverge), \(\mathbb{E}[X]\) is <strong>undefined</strong>.<br><br>For <strong>finite</strong> probability spaces this is always satisfied (finitely many terms). For infinite spaces, care is needed. |

Falls <b>die Summe nicht absolut konvergiert</b> (z.B. positiver und negativer Anteil beide divergieren).<br><br>Der Erwartungswert ist nur definiert, wenn die Summe <b>absolut konvergiert</b>, d.h. \(\sum_{x\in W_X}|x|\cdot\Pr[X=x]<\infty\).<br><br>In <b>endlichen</b> Wahrscheinlichkeitsräumen ist dies immer erfüllt (endlich viele Terme). Bei unendlichen Räumen muss man aufpassen. |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 27: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_5d4b53d1

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

In Bayesian terms, what does it mean to "update" a belief using new evidence?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

In Bayesian terms, what does it mean to "update" a belief using new evidence?

Before observation: We have a prior \(\Pr[H]\) — our initial belief in hypothesis \(H\).

After observing evidence \(E\): We compute the posterior \(\Pr[H|E]\propto\Pr[E|H]\cdot\Pr[H]\).

If \(\Pr[E|H]\gg\Pr[E|\bar{H}]\): the evidence strongly supports \(H\) → posterior \(\gg\) prior.

If \(\Pr[E|H]\approx\Pr[E|\bar{H}]\): the evidence is neutral → posterior \(\approx\) prior.

The likelihood ratio \(\Pr[E|H]/\Pr[E|\bar{H}]\) quantifies the strength of evidence for \(H\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Was bedeutet es in der Bayes'schen Statistik, eine Überzeugung anhand neuer Evidenz zu "aktualisieren"?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Was bedeutet es in der Bayes'schen Statistik, eine Überzeugung anhand neuer Evidenz zu "aktualisieren"?

Man passt die Wahrscheinlichkeit einer Hypothese an, indem man die Prior-Wahrscheinlichkeit mit der Likelihood der beobachteten Evidenz kombiniert, um eine Posterior-Wahrscheinlichkeit zu erhalten.

Vor der Beobachtung: Wir haben einen Prior \(\Pr[H]\), unsere anfängliche Überzeugung in Hypothese \(H\).

Nach Beobachtung der Evidenz \(E\): Wir berechnen den Posterior \(\Pr[H|E]\propto\Pr[E|H]\cdot\Pr[H]\).

Falls \(\Pr[E|H]\gg\Pr[E|\bar{H}]\): Die Evidenz unterstützt \(H\) stark, Posterior \(\gg\) Prior.

Falls \(\Pr[E|H]\approx\Pr[E|\bar{H}]\): Die Evidenz ist neutral, Posterior \(\approx\) Prior.

Das Likelihood-Verhältnis \(\Pr[E|H]/\Pr[E|\bar{H}]\) quantifiziert die Stärke der Evidenz für \(H\).

Field-by-field Comparison

| Field |

Before |

After |

| Front |

In Bayesian terms, what does it mean to "update" a belief using new evidence? |

Was bedeutet es in der Bayes'schen Statistik, eine Überzeugung anhand neuer Evidenz zu "aktualisieren"? |

| Back |

<strong>Before observation:</strong> We have a <strong>prior</strong> \(\Pr[H]\) — our initial belief in hypothesis \(H\).<br><br><strong>After observing evidence \(E\):</strong> We compute the <strong>posterior</strong> \(\Pr[H|E]\propto\Pr[E|H]\cdot\Pr[H]\).<br><br>If \(\Pr[E|H]\gg\Pr[E|\bar{H}]\): the evidence strongly supports \(H\) → posterior \(\gg\) prior.<br>If \(\Pr[E|H]\approx\Pr[E|\bar{H}]\): the evidence is neutral → posterior \(\approx\) prior.<br><br>The <strong>likelihood ratio</strong> \(\Pr[E|H]/\Pr[E|\bar{H}]\) quantifies the strength of evidence for \(H\). |

Man passt die Wahrscheinlichkeit einer Hypothese an, indem man die Prior-Wahrscheinlichkeit mit der Likelihood der beobachteten Evidenz kombiniert, um eine Posterior-Wahrscheinlichkeit zu erhalten.<br><br>Vor der Beobachtung: Wir haben einen Prior \(\Pr[H]\), unsere anfängliche Überzeugung in Hypothese \(H\).<br><br>Nach Beobachtung der Evidenz \(E\): Wir berechnen den Posterior \(\Pr[H|E]\propto\Pr[E|H]\cdot\Pr[H]\).<br><br>Falls \(\Pr[E|H]\gg\Pr[E|\bar{H}]\): Die Evidenz unterstützt \(H\) stark, Posterior \(\gg\) Prior.<br>Falls \(\Pr[E|H]\approx\Pr[E|\bar{H}]\): Die Evidenz ist neutral, Posterior \(\approx\) Prior.<br><br>Das Likelihood-Verhältnis \(\Pr[E|H]/\Pr[E|\bar{H}]\) quantifiziert die Stärke der Evidenz für \(H\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

Note 28: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_65e8ec7d

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

In the casino game: flip a coin until the first heads after \(k\) flips. Bank gains \(2^k\) if \(k\) is odd, loses \(2^k\) if \(k\) is even. What is \(\mathbb{E}[G]\)?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

In the casino game: flip a coin until the first heads after \(k\) flips. Bank gains \(2^k\) if \(k\) is odd, loses \(2^k\) if \(k\) is even. What is \(\mathbb{E}[G]\)?

\(\Pr[\text{first heads at flip }k] = (1/2)^k\).

The sum in Definition 2.27:

\[ \sum_{k=1}^{\infty}(-1)^{k-1}\cdot 2^k\cdot (1/2)^k = \sum_{k=1}^{\infty}(-1)^{k-1} = +1-1+1-1+\cdots \]

This series does not converge (it oscillates), so \(\mathbb{E}[G]\) is undefined.

Similarly: if the bank always pays \(2^k\), each term equals 1 and the sum diverges to \(+\infty\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Im Kasinospiel:

Man wirft eine Münze, bis zum ersten Kopf nach \(k\) Würfen. Die Bank gewinnt \(2^k\) falls \(k\) ungerade, verliert \(2^k\) falls \(k\) gerade.

Was ist \(\mathbb{E}[G]\)?

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Im Kasinospiel:

Man wirft eine Münze, bis zum ersten Kopf nach \(k\) Würfen. Die Bank gewinnt \(2^k\) falls \(k\) ungerade, verliert \(2^k\) falls \(k\) gerade.

Was ist \(\mathbb{E}[G]\)?

\(\Pr[\text{first heads at flip }k] = (1/2)^k\).

Die Summe gemäss Definition 2.27:\[\sum_{k=1}^{\infty}(-1)^{k-1}\cdot 2^k\cdot (1/2)^k = \sum_{k=1}^{\infty}(-1)^{k-1} = +1-1+1-1+\cdots\]Diese Reihe konvergiert nicht (sie oszilliert), also ist \(\mathbb{E}[G]\) undefiniert.

Analog: Falls die Bank immer \(2^k\) zahlt, ist jeder Term gleich 1 und die Summe divergiert gegen \(+\infty\).

Field-by-field Comparison

| Field |

Before |

After |

| Front |

In the casino game: flip a coin until the first heads after \(k\) flips. Bank gains \(2^k\) if \(k\) is odd, loses \(2^k\) if \(k\) is even. What is \(\mathbb{E}[G]\)? |

Im Kasinospiel: <br>Man wirft eine Münze, bis zum ersten Kopf nach \(k\) Würfen. Die Bank gewinnt \(2^k\) falls \(k\) ungerade, verliert \(2^k\) falls \(k\) gerade. <br><br>Was ist \(\mathbb{E}[G]\)? |

| Back |

\(\Pr[\text{first heads at flip }k] = (1/2)^k\).<br><br>The sum in Definition 2.27:<br>\[ \sum_{k=1}^{\infty}(-1)^{k-1}\cdot 2^k\cdot (1/2)^k = \sum_{k=1}^{\infty}(-1)^{k-1} = +1-1+1-1+\cdots \]<br>This series does not converge (it oscillates), so \(\mathbb{E}[G]\) is <strong>undefined</strong>.<br><br><strong>Similarly:</strong> if the bank always pays \(2^k\), each term equals 1 and the sum diverges to \(+\infty\). |

\(\Pr[\text{first heads at flip }k] = (1/2)^k\).<br><br>Die Summe gemäss Definition 2.27:\[\sum_{k=1}^{\infty}(-1)^{k-1}\cdot 2^k\cdot (1/2)^k = \sum_{k=1}^{\infty}(-1)^{k-1} = +1-1+1-1+\cdots\]Diese Reihe konvergiert nicht (sie oszilliert), also ist \(\mathbb{E}[G]\) undefiniert.<br><br>Analog: Falls die Bank immer \(2^k\) zahlt, ist jeder Term gleich 1 und die Summe divergiert gegen \(+\infty\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 29: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Cloze

GUID: sc_76f11552

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten PlsFix::DUPLICATE

(Multiplikationssatz, Satz 2.10) For events \(A_1,\ldots,A_n\) with \(\Pr[A_1\cap\cdots\cap A_n]>0\):

\[ \Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}. \]

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten PlsFix::DUPLICATE

(Multiplikationssatz, Satz 2.10) For events \(A_1,\ldots,A_n\) with \(\Pr[A_1\cap\cdots\cap A_n]>0\):

\[ \Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}. \]

Proof Included

Proof: Expand each conditional probability by definition:

\[ \Pr[A_1]\cdot\frac{\Pr[A_1\cap A_2]}{\Pr[A_1]}\cdot\frac{\Pr[A_1\cap A_2\cap A_3]}{\Pr[A_1\cap A_2]}\cdots\frac{\Pr[A_1\cap\cdots\cap A_n]}{\Pr[A_1\cap\cdots\cap A_{n-1}]}. \]

All intermediate terms cancel (telescoping product), leaving \(\Pr[A_1\cap\cdots\cap A_n]\). \(\square\)

Note: All conditional probabilities are well-defined because \(\Pr[A_1]\ge\Pr[A_1\cap A_2]\ge\cdots>0\).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten PlsFix::DUPLICATE

Für Ereignisse \(A_1,\ldots,A_n\) mit \(\Pr[A_1\cap\cdots\cap A_n]>0\):

\[\Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}.\]

Proof included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten PlsFix::DUPLICATE

Für Ereignisse \(A_1,\ldots,A_n\) mit \(\Pr[A_1\cap\cdots\cap A_n]>0\):

\[\Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}.\]

Proof included

(Multiplikationssatz, Satz 2.10)

Beweis: Jede bedingte Wahrscheinlichkeit gemäss Definition einsetzen:

\[\Pr[A_1]\cdot\frac{\Pr[A_1\cap A_2]}{\Pr[A_1]}\cdot\frac{\Pr[A_1\cap A_2\cap A_3]}{\Pr[A_1\cap A_2]}\cdots\frac{\Pr[A_1\cap\cdots\cap A_n]}{\Pr[A_1\cap\cdots\cap A_{n-1}]}.\]

Alle Zwischenterme kürzen sich (Teleskopprodukt), es bleibt \(\Pr[A_1\cap\cdots\cap A_n]\). \(\square\)

Bemerkung: Alle bedingten Wahrscheinlichkeiten sind wohldefiniert, da \(\Pr[A_1]\ge\Pr[A_1\cap A_2]\ge\cdots>0\).

Field-by-field Comparison

| Field |

Before |

After |

| Text |

(Multiplikationssatz, Satz 2.10) For events \(A_1,\ldots,A_n\) with \(\Pr[A_1\cap\cdots\cap A_n]>0\):<br>\[ \Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}. \]<br><em>Proof Included</em> |

Für Ereignisse \(A_1,\ldots,A_n\) mit \(\Pr[A_1\cap\cdots\cap A_n]>0\):<br>\[\Pr[A_1\cap\cdots\cap A_n] = {{c1::\Pr[A_1]\cdot\Pr[A_2|A_1]\cdot\Pr[A_3|A_1\cap A_2]\cdots\Pr[A_n|A_1\cap\cdots\cap A_{n-1}]}}.\]<br><em>Proof included</em> |

| Extra |

<strong>Proof:</strong> Expand each conditional probability by definition:<br>\[ \Pr[A_1]\cdot\frac{\Pr[A_1\cap A_2]}{\Pr[A_1]}\cdot\frac{\Pr[A_1\cap A_2\cap A_3]}{\Pr[A_1\cap A_2]}\cdots\frac{\Pr[A_1\cap\cdots\cap A_n]}{\Pr[A_1\cap\cdots\cap A_{n-1}]}. \]<br>All intermediate terms cancel (telescoping product), leaving \(\Pr[A_1\cap\cdots\cap A_n]\). \(\square\)<br><br>Note: All conditional probabilities are well-defined because \(\Pr[A_1]\ge\Pr[A_1\cap A_2]\ge\cdots>0\). |

(Multiplikationssatz, Satz 2.10)<br><br>Beweis: Jede bedingte Wahrscheinlichkeit gemäss Definition einsetzen:<br>\[\Pr[A_1]\cdot\frac{\Pr[A_1\cap A_2]}{\Pr[A_1]}\cdot\frac{\Pr[A_1\cap A_2\cap A_3]}{\Pr[A_1\cap A_2]}\cdots\frac{\Pr[A_1\cap\cdots\cap A_n]}{\Pr[A_1\cap\cdots\cap A_{n-1}]}.\]<br>Alle Zwischenterme kürzen sich (Teleskopprodukt), es bleibt \(\Pr[A_1\cap\cdots\cap A_n]\). \(\square\)<br><br>Bemerkung: Alle bedingten Wahrscheinlichkeiten sind wohldefiniert, da \(\Pr[A_1]\ge\Pr[A_1\cap A_2]\ge\cdots>0\). |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::2._Bedingte_Wahrscheinlichkeiten

PlsFix::DUPLICATE

Note 30: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_7999a9b2

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

In \(m\) fair coin flips, let \(X\) = number of (possibly overlapping) occurrences of "KKK" (three consecutive heads). Find \(\mathbb{E}[X]\).

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

In \(m\) fair coin flips, let \(X\) = number of (possibly overlapping) occurrences of "KKK" (three consecutive heads). Find \(\mathbb{E}[X]\).

Setup: "KKK" can start at positions \(i=1,\ldots,m-2\). Define:

\[ X_i = \begin{cases}1 & \text{flips } i,i+1,i+2 \text{ are all heads}\\ 0 & \text{otherwise}\end{cases}. \]

Then \(X=X_1+\cdots+X_{m-2}\).

Each term: \(\mathbb{E}[X_i]=\Pr[X_i=1]=(1/2)^3=1/8\).

Result: \(\mathbb{E}[X]=(m-2)\cdot\tfrac{1}{8}=\dfrac{m-2}{8}\).

(The overlapping nature does not matter — linearity handles it automatically.)

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Bei \(m\) fairen Münzwürfen sei \(X\) = Anzahl (möglicherweise überlappender) Vorkommen von "KKK" (drei aufeinanderfolgende Köpfe).

Bestimme \(\mathbb{E}[X]\).

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Bei \(m\) fairen Münzwürfen sei \(X\) = Anzahl (möglicherweise überlappender) Vorkommen von "KKK" (drei aufeinanderfolgende Köpfe).

Bestimme \(\mathbb{E}[X]\).

Ansatz: "KKK" kann an Positionen \(i=1,\ldots,m-2\) beginnen. Definiere:\[X_i = \begin{cases}1 & \text{Würfe } i,i+1,i+2 \text{ sind alle Kopf}\\ 0 & \text{sonst}\end{cases}.\]Dann ist \(X=X_1+\cdots+X_{m-2}\).

Jeder Term: \(\mathbb{E}[X_i]=\Pr[X_i=1]=(1/2)^3=1/8\).

Ergebnis: \(\mathbb{E}[X]=(m-2)\cdot\tfrac{1}{8}=\dfrac{m-2}{8}\).

(Die Überlappungen spielen keine Rolle, Linearität des Erwartungswerts erledigt das automatisch.)

Field-by-field Comparison

| Field |

Before |

After |

| Front |

In \(m\) fair coin flips, let \(X\) = number of (possibly overlapping) occurrences of "KKK" (three consecutive heads). Find \(\mathbb{E}[X]\). |

Bei \(m\) fairen Münzwürfen sei \(X\) = Anzahl (möglicherweise überlappender) Vorkommen von "KKK" (drei aufeinanderfolgende Köpfe). <br><br>Bestimme \(\mathbb{E}[X]\). |

| Back |

<strong>Setup:</strong> "KKK" can start at positions \(i=1,\ldots,m-2\). Define:<br>\[ X_i = \begin{cases}1 & \text{flips } i,i+1,i+2 \text{ are all heads}\\ 0 & \text{otherwise}\end{cases}. \]<br>Then \(X=X_1+\cdots+X_{m-2}\).<br><br><strong>Each term:</strong> \(\mathbb{E}[X_i]=\Pr[X_i=1]=(1/2)^3=1/8\).<br><br><strong>Result:</strong> \(\mathbb{E}[X]=(m-2)\cdot\tfrac{1}{8}=\dfrac{m-2}{8}\).<br><br>(The overlapping nature does not matter — linearity handles it automatically.) |

Ansatz: "KKK" kann an Positionen \(i=1,\ldots,m-2\) beginnen. Definiere:\[X_i = \begin{cases}1 & \text{Würfe } i,i+1,i+2 \text{ sind alle Kopf}\\ 0 & \text{sonst}\end{cases}.\]Dann ist \(X=X_1+\cdots+X_{m-2}\).<br><br>Jeder Term: \(\mathbb{E}[X_i]=\Pr[X_i=1]=(1/2)^3=1/8\).<br><br>Ergebnis: \(\mathbb{E}[X]=(m-2)\cdot\tfrac{1}{8}=\dfrac{m-2}{8}\).<br><br>(Die Überlappungen spielen keine Rolle, Linearität des Erwartungswerts erledigt das automatisch.) |

Tags:

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::4._Zufallsvariablen::2._Erwartungswert

Note 31: ETH::2. Semester::A&W

Deck: ETH::2. Semester::A&W

Note Type: Horvath Classic

GUID: sc_79bd603a

modified

Before

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

If \(A\) and \(B\) are independent, prove that {{c1:: \(\bar{A}\) and \(B\)::complement}} are also independent. Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

If \(A\) and \(B\) are independent, prove that {{c1:: \(\bar{A}\) and \(B\)::complement}} are also independent. Proof Included

Need: \(\Pr[\bar{A}\cap B]=\Pr[\bar{A}]\cdot\Pr[B]\).

\[ \Pr[\bar{A}\cap B] = \Pr[B] - \Pr[A\cap B] = \Pr[B] - \Pr[A]\Pr[B] = (1-\Pr[A])\Pr[B] = \Pr[\bar{A}]\Pr[B]. \quad\square \]

Consequence: If \(A_1,\ldots,A_n\) are mutually independent, so is any family obtained by replacing some \(A_i\) with \(\bar{A}_i\) (Lemma 2.23).

After

Front

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Falls \(A\) und \(B\) unabhängig sind, beweise, dass \(\bar{A}\) und \(B\) ebenfalls unabhängig sind.

Proof Included

Back

ETH::2._Semester::A&W::2._Wahrscheinlichkeitstheorie_und_randomisierte_Algorithmen::3._Unabhängigkeit

Falls \(A\) und \(B\) unabhängig sind, beweise, dass \(\bar{A}\) und \(B\) ebenfalls unabhängig sind.

Proof Included

Zu zeigen: \(\Pr[\bar{A}\cap B]=\Pr[\bar{A}]\cdot\Pr[B]\).\[\begin{gathered}\Pr[\bar{A}\cap B] = \Pr[B] - \Pr[A\cap B] \\ = \Pr[B] - \Pr[A]\Pr[B] \\ = (1-\Pr[A])\Pr[B] = \Pr[\bar{A}]\Pr[B]. \quad\square\end{gathered}\]Folgerung: Falls \(A_1,\ldots,A_n\) gemeinsam unabhängig sind, so auch jede Familie, die durch Ersetzen einiger \(A_i\) durch \(\bar{A}_i\) entsteht (Lemma 2.23).

Field-by-field Comparison

| Field |

Before |

After |

| Front |

If \(A\) and \(B\) are independent, prove that {{c1:: \(\bar{A}\) and \(B\)::complement}} are also independent. <em>Proof Included</em> |

Falls \(A\) und \(B\) unabhängig sind, beweise, dass \(\bar{A}\) und \(B\) ebenfalls unabhängig sind. <br><em><br>Proof Included</em> |

| Back |